Jeszcze niedawno wykorzystanie AI w bezpieczeństwie było traktowane jako ciekawostka albo eksperyment dla najbardziej zaawansowanych zespołów. Dziś coraz trudniej mówić o tym zjawisku w ten sposób – AI staje się integralną częścią procesu znajdowania podatności.

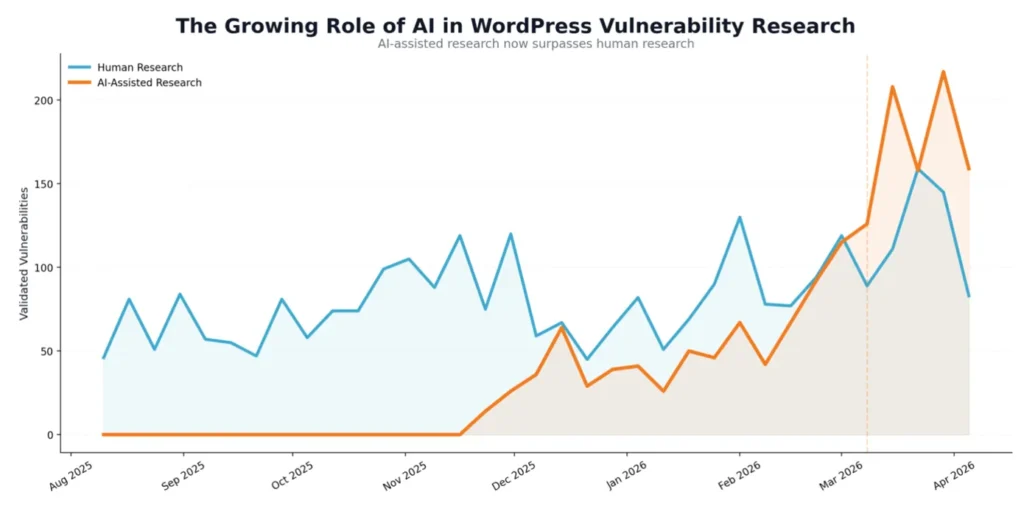

Dane Wordfence dobrze pokazują, jak gwałtownie to się zmienia. Pod koniec 2025 roku tylko część zgłoszeń była tworzona przy wsparciu modeli AI. Kilka miesięcy później mówimy już o większości. To nie jest powolna adopcja – to gwałtowny skok, który zmienia sposób działania całej branży.

Co ważne, zmiana dzieje się „po cichu”. Bez wielkich nagłówków, ale z bardzo realnym wpływem na codzienną pracę researcherów.

Źródło: wordfence.com

Źródło: wordfence.comAI zmienia sposób myślenia o podatnościach

Największa różnica nie polega na tym, iż AI przyspiesza analizę. Ono zmienia sposób, w jaki researcher podchodzi do problemu. Zamiast przeglądać kod linijka po linijce, coraz częściej zaczyna od zadania pytania modelowi. AI potrafi wskazać potencjalnie ryzykowne fragmenty, zasugerować możliwe scenariusze exploitacji albo pomóc w zrozumieniu mniej oczywistych zależności w aplikacji.

Sprawia to, iż proces staje się bardziej iteracyjny. Researcher nie działa już tylko jako analizator, ale bardziej jako ktoś, kto prowadzi dialog z narzędziem i na bieżąco weryfikuje jego sugestie.

Efektem jest znacznie większa liczba znalezionych podatności – i to w krótszym czasie. Wzrost liczby zgłoszeń o setki procent nie jest przypadkiem, tylko bezpośrednim skutkiem tej zmiany.

Problem zaczyna się w momencie, gdy ten wzrost trafia do zespołów odpowiedzialnych za triage. Więcej zgłoszeń oznacza więcej pracy, ale niekoniecznie większą wartość. Część raportów jest niepełna, część dotyczy niskiego ryzyka, a część wymaga dokładnej weryfikacji, zanim w ogóle można podjąć decyzję. W efekcie wiele zespołów zaczęło doświadczać przeciążenia. Procesy, które działały przy mniejszej skali, przestają być wydajne. I tutaj pojawia się kolejna warstwa wykorzystania AI.

Zamiast analizować każde zgłoszenie manualnie, organizacje zaczynają wykorzystywać modele do filtrowania i priorytetyzacji. AI pomaga ocenić, które podatności są rzeczywiście istotne, a które można odłożyć na później. To nie eliminuje pracy człowieka, ale pozwala skupić się na tym, co naprawdę ważne. Powstaje więc interesujący ekosystem, w którym AI napędza zarówno problem (więcej zgłoszeń), jak i jego rozwiązanie (lepsza selekcja).

Kolejna zmiana, która często umyka naszej uwadze, dotyczy architektury samych rozwiązań. To już nie jest jeden model, który „robi wszystko”. Coraz częściej mamy do czynienia z podejściem, w którym różne modele odpowiadają za różne zadania. Jeden analizuje kod, inny próbuje zbudować scenariusz ataku, jeszcze inny ocenia ryzyko. Całość jest połączona w pipeline, który przypomina pracę zespołu analityków. Do tego dochodzą techniki optymalizacji, takie jak trenowanie mniejszych, wyspecjalizowanych modeli czy przekazywanie kontekstu między nimi. Dzięki temu systemy stają się szybsze, tańsze i bardziej precyzyjne.

Z perspektywy użytkownika wygląda to jak jedno narzędzie, ale w praktyce jest to złożony mechanizm, który działa warstwowo. I właśnie to sprawia, iż AI zaczyna być naprawdę użyteczne w codziennej pracy.

Czy to oznacza mniej podatności?

Intuicyjnie można by założyć, iż lepsze narzędzia doprowadzą do zmniejszenia liczby błędów. W praktyce sytuacja jest bardziej skomplikowana.

Z jednej strony AI pomaga tworzyć lepszy kod i szybciej wykrywać problemy. Z drugiej zwiększa tempo tworzenia systemu i wprowadza nowe klasy podatności, szczególnie w systemach opartych o modele. Do tego dochodzi klasyczna asymetria: atakujący potrzebuje jednej skutecznej luki, podczas gdy obrońca musi zabezpieczyć cały system. Ta zasada nie zmienia się wraz z włączeniem do pracy AI.

Co więcej, narzędzia wykorzystywane przez researcherów są dostępne również dla atakujących. Oznacza to, iż obie strony rozwijają się równolegle, a przewaga zależy głównie od tego, kto szybciej adaptuje nowe podejścia.

Największa zmiana – dostępność

Jeszcze kilka lat temu praca z zaawansowanymi modelami wymagała dużych zasobów i specjalistycznej wiedzy. Dziś bariera wejścia jest znacznie niższa.

Open source, gotowe API i coraz lepsze modele sprawiają, iż praktycznie każdy może zacząć eksperymentować z AI w kontekście bezpieczeństwa. Prowadzi to do eksplozji pomysłów i nowych technik, które nie zawsze powstają w dużych firmach czy laboratoriach. Ponadto sprawia, iż granica między researcherem a atakującym zaczyna się zacierać. Obie strony mają dostęp do tych samych narzędzi, co zwiększa dynamikę całego ekosystemu.

Słowo na koniec

Dla zespołów bezpieczeństwa oznacza to konieczność dostosowania się do nowej rzeczywistości. Klasyczne podejście, oparte na manualnej analizie i ograniczonej liczbie zgłoszeń, przestaje być wystarczające.

Coraz większego znaczenia nabiera umiejętność pracy z AI – nie tylko jako narzędziem do znajdowania podatności, ale wsparciem w analizie i podejmowaniu decyzji. Równocześnie rośnie znaczenie automatyzacji i dobrze zaprojektowanych procesów, które pozwalają utrzymać kontrolę nad rosnącą liczbą zgłoszeń. AI nie tyle zaczyna być wykorzystywane do vulnerability research, ono już tam jest i zmienia zasady gry.

Researcherzy działają szybciej, znajdują więcej podatności i pracują w zupełnie innym modelu niż jeszcze rok temu. Jednocześnie rośnie presja na zespoły, które muszą te podatności analizować i obsługiwać. Najważniejsze pytanie nie brzmi więc, czy AI zastąpi ludzi w tym zakresie. Brzmi raczej: kto szybciej nauczy się efektywnie korzystać z narzędzia, jakim jest AI. Bo w tej chwili to właśnie tam buduje się realna przewaga.