Bielik AI, który jeszcze niedawno mógł być uważany za niszowy projekt budowany przez społeczność, dziś wyrasta na najpoważniejszą polską inicjatywę w obszarze modeli językowych. Jego rozwój może gwałtownie przyspieszyć po dołączeniu InPostu jako strategicznego partnera. To nadało projektowi realną skalę i biznesową wagę.

Pojawienie się Bielika AI otworzyło w Polsce dyskusję o tym, czy lokalny model może realnie konkurować z globalnymi rozwiązaniami. Odpowiedź przestaje być abstrakcyjna, bo projekt zdobył właśnie poważne zaplecze technologiczne i finansowe, a do jego rozwoju właśnie dołączył InPost. Pytanie, czy Bielik może wyprzeć inne modele, dotyczy dziś już nie możliwości, ale kierunku, w którym zmierza polski ekosystem AI.

Bielik AI wchodzi w nową fazę rozwoju. Polski model, który zaczął się od rozmów, zyskuje biznesowe zaplecze

Pojawienie się Bielika AI na polskiej scenie technologicznej jest rzadkim przykładem projektu, który wyrósł nie z grantów, strategii ministerstw czy modnych hasztagów, ale z realnej potrzeby i bardzo prozaicznych ograniczeń. Model powstał dlatego, iż jego inicjatorzy — twórcy Fundacji SpeakLeash — potrzebowali polskojęzykowego systemu. Chcieli systemu, który da się postawić we własnym środowisku i który nie będzie zależny od komercyjnych platform z zagranicy. To był punkt wyjścia: nie ambicja konkurowania z OpenAI, tylko chęć zbudowania narzędzia, które realnie da się wykorzystać w codziennej pracy.

Wbrew pozorom, początki projektu były zaskakująco chaotyczne i ludzkie. Zaczęło się dosłownie od rozmowy kilku osób, potem od spotkania przy okazji eventów technologicznych. Następnie od rosnącej grupy wolontariuszy, którzy na własną rękę zaczęli kompletować zbiory danych i tworzyć pierwsze szkice architektury modelu. Charakterystyczne jest to, iż nazwa Bielik nie została narzucona odgórnie, tylko wybrana przez społeczność. To w praktyce spowodowało, iż projekt od początku nie był czyjąś własnością, ale wspólną inicjatywą.

Pierwszym poważnym kryzysem okazał się brak mocy obliczeniowej. Choć organizatorzy wykorzystali grant Compute i mieli otrzymać dostęp do infrastruktury GPU w ramach deklarowanego partnerstwa, kooperacja ostatecznie nie doszła do skutku. To był moment, w którym projekt mógł się po prostu rozpaść — dane były zebrane, model gotowy do startu, ale nie było gdzie go trenować. Dopiero Akademickie Centrum Komputerowe Cyfronet AGH zdecydowało się udostępnić potencjał dwóch najszybszych wtedy superkomputerów w Polsce. Ta decyzja w praktyce uratowała cały projekt i umożliwiła przejście od romantycznej wizji do realnej pracy badawczej.

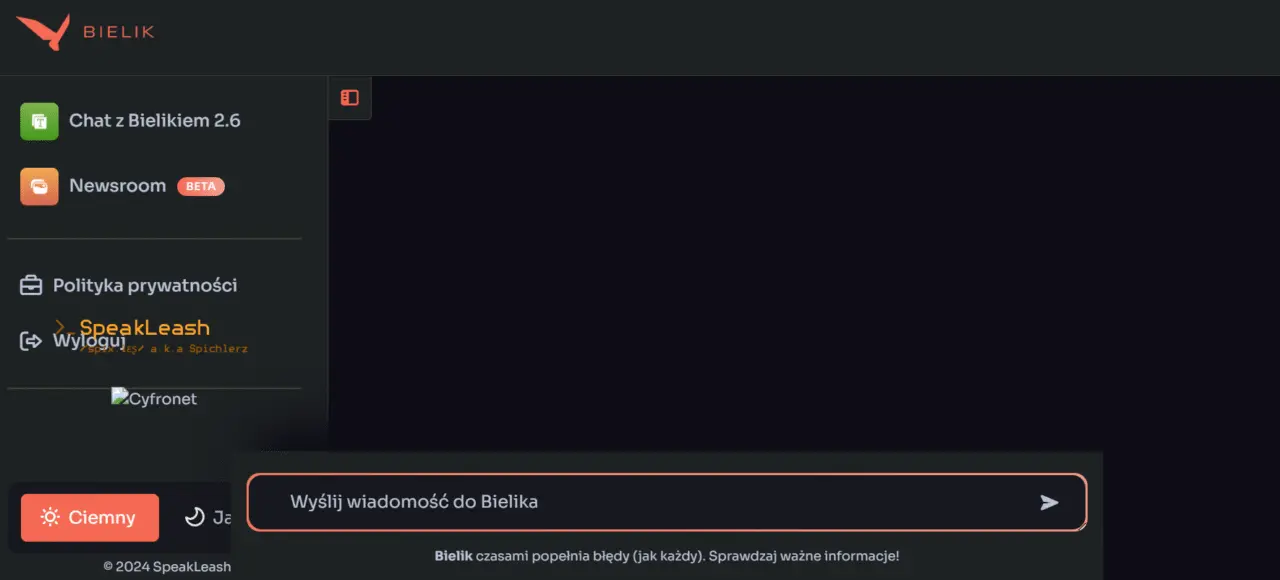

Interfejs Bielika wydaje się dość prosty. Źródło: Bielik.ai.

Interfejs Bielika wydaje się dość prosty. Źródło: Bielik.ai.Bielik zaczął rozwijać się szybko, ale bez rozgłosu

To przez cały czas była inicjatywa środowiskowa, bez wielkiej kampanii medialnej i bez spektakularnych obietnic. Kolejni specjaliści dołączali, bo projekt był otwarty i dawał możliwość wpływania na jego kierunek. Na tym etapie powstał również SpeakLeash — ogromny projekt gromadzenia polskich danych tekstowych, który stał się fundamentem pod szkolenie modeli. To właśnie ta baza, a nie sam algorytm, została uznana przez ekspertów za najbardziej strategiczny element przedsięwzięcia.

Przez długi czas Bielik funkcjonował jako projekt ambitny, ale niszowy. Znany ludziom związanym z technologią, niezauważalny dla szerokiej opinii publicznej. To może się zmienić wraz z decyzją InPostu o wejściu do projektu jako jego mecenas strategiczny. Informacja, ogłoszona 27 listopada tego roku, może okazać się momentem przełomowym. Duża, prywatna grupa logistyczna zdecydowała się nie tylko wesprzeć lokalny model językowy, ale wejść w niego z pełnym zaangażowaniem biznesowym.

W praktyce oznacza to, iż InPost nie jest tu sponsorem z logo, ale realnym uczestnikiem budowania infrastruktury i strategii. Rafał Brzoska objął przewodnictwo nad Business Advisory Board. W jej skład weszli także przedstawiciele Google Cloud Poland, Cyfronetu, Deviniti oraz organizacji branżowych. Sam Brzoska w swoim wystąpieniu podkreślał, iż polski rynek nie może sobie pozwolić na pełne uzależnienie od zagranicznych dostawców AI. Lokalne modele są elementem bezpieczeństwa technologicznego. Cytaty, które padły podczas ogłoszenia współpracy, podkreślały nie tyle patriotyczną symbolikę, ile pragmatyczny wymiar projektu. Możliwość wdrażania rozwiązań szytych na miarę. Rozwiązań zgodnych z polskimi regulacjami i dopasowanych do krajowego otoczenia prawnego.

– Cieszymy się, iż możemy wspierać Fundację Speakleash i projekt Bielik.ai. To wspaniałe widzieć, iż takie nowoczesne technologie rozwijają się właśnie tutaj, w Polsce. Wierzymy, iż połączenie naszych sił i doświadczeń przyniesie korzyści nie tylko nam, ale całej branży. To synergia, z której wszyscy skorzystamy – jesteśmy dumni, iż możemy być jej częścią – powiedział Rafał Brzoska, Prezes Zarządu InPost.

Pierwsze uruchomienie Bielika w wersji lokalnej zajmuje trochę czasu. Źródło: LM Studio.

Pierwsze uruchomienie Bielika w wersji lokalnej zajmuje trochę czasu. Źródło: LM Studio.Dla Bielika oznacza to wzmocnienie na wszystkich poziomach: organizacyjnym, finansowym i mediowym

Nagle projekt, który przez lata rozwijał się niemal po cichu, znalazł się w centrum zainteresowania rynku. Dlaczego? Bo InPost zaczął mówić o nim jako o potencjalnym przyszłym elemencie własnej infrastruktury logistycznej i automatyzacyjnej. To pierwszy tak duży sygnał ze strony prywatnej firmy, iż polski model językowy może być używany nie jako ciekawostka, ale jako element działalności operacyjnej.

Warto też zwrócić uwagę na to, jak ta kooperacja może zmienić sam wizerunek Bielika. Do tej pory kojarzył się z projektem społecznościowym, tworzonym przez pasjonatów, cennym, ale lokalnym. Teraz zaczyna być postrzegany jako przedsięwzięcie, które może stać się polskim standardem AI. Nie w znaczeniu rywalizacji z największymi globalnymi modelami, ale w sensie zbudowania silnego, niezależnego rozwiązania, gotowego do wdrożeń instytucjonalnych.

Sam model przez cały czas jest stosunkowo kompaktowy i daleki od skali konstrukcji typu GPT-4, ale to nie przeszkadza w jego rosnącej atrakcyjności. Bielika można uruchomić lokalnie, dostroić do własnych danych, wykorzystać bez przesyłania informacji na zewnętrzne serwery. Dla wielu sektorów, w tym prawnego, medycznego czy finansowego, to argument kluczowy.

Niestety w wersji lokalnej pojawiały się błędy, które uniemożliwiały generowanie odpowiedzi. Źródło: LM Studio.

Niestety w wersji lokalnej pojawiały się błędy, które uniemożliwiały generowanie odpowiedzi. Źródło: LM Studio.Co potrafi Bielik?

Bielik AI został zaprojektowany tak, aby realnie wspierać pracę w języku polskim. Dlatego dobrze radzi sobie zarówno z analizą tekstu, jak i generowaniem treści w naturalnym, nienadmuchanym stylu. Potrafi streszczać dokumenty, porządkować informacje, odpowiadać na pytania dotyczące polskich realiów oraz pracować na materiałach specjalistycznych. To jest możliwe, jeżeli otrzyma odpowiednio precyzyjne instrukcje. Dzięki temu znajduje zastosowanie w firmach, które potrzebują modelu zdolnego do działania w środowisku zamkniętym, gdzie dane nie mogą opuszczać organizacji.

Aby z niego korzystać, najprościej wejść na stronę bielik.ai. Tam uruchamia się w przeglądarce i pozwala gwałtownie sprawdzić jego możliwości. Użytkownicy, którzy potrzebują pełnej prywatności lub chcą mieć wpływ na sposób generowania odpowiedzi, mogą uruchomić model lokalnie. Wymaga to pobrania programu LM Studio, w którym wyszukuje się Bielika w sekcji Discover. Następnie wybiera się odpowiednią wersję oraz – jeżeli sprzęt jest słabszy – wariant skwantyzowany, zajmujący mniej pamięci. Po pobraniu model można uruchomić w zakładce Chat i korzystać z niego bez połączenia z zewnętrznymi serwerami.

W praktyce Bielik działa tak, jak większość zaawansowanych modeli językowych, ale różni się tym, iż można go dostroić do konkretnych zadań. W ustawieniach LM Studio dostępny jest system prompt. Pozwala on zdefiniować stałe instrukcje dotyczące stylu lub zakresu odpowiedzi. Oraz parametr temperatura, wpływający na kreatywność wypowiedzi. To sprawia, iż model może być bardziej precyzyjny, bardziej zachowawczy lub bardziej twórczy, w zależności od potrzeby.

Szybkość generowania odpowiedzi zależy od naszego sprzętu, w szczególności karty graficznej oraz pamięci RAM.

Źródło: Bielik.AI, Inpost.