Film, na którym Elizabeth Warren mówi, iż Republikanie nie powinni głosować stał się wirusowy w 2023 roku. Ale to nie był Warren. To wideo Rona DeSantisa nie był też gubernatorem Florydy. I nie, Papież Franciszek nie miała na sobie białego płaszcza Balenciagi.

Generatywna sztuczna inteligencja ułatwiła tworzenie deepfakes i rozpowszechnianie ich w Internecie. Jednym z najczęściej proponowanych rozwiązań jest pomysł znaku wodnego, który identyfikowałby treści generowane przez sztuczną inteligencję. Administracja Bidena zrobiła wiele ze znaków wodnych jako rozwiązania politycznego, choćby w szczególności zlecając firmom technologicznym znalezienie sposobów identyfikowania treści generowanych przez sztuczną inteligencję. Prezydenta zarządzenie wykonawcze w sprawie sztucznej inteligencji, wydany w listopadzie, powstał w oparciu o zobowiązania twórców sztucznej inteligencji do znalezienia sposobu na oznaczanie treści generowanych przez sztuczną inteligencję. I nie pochodzi to tylko z Białego Domu — legislatorzy teżrozważają wprowadzenie wymagań dotyczących znaków wodnych jako prawa.

Znak wodny nie może być panaceum — po pierwsze, większość systemów po prostu nie ma możliwości oznaczania tekstu w taki sam sposób, w jaki można oznaczać media wizualne. Mimo to ludzie są na tyle zaznajomieni ze znakami wodnymi, iż pomysł dodania znaku wodnego do obrazu wygenerowanego przez sztuczną inteligencję wydaje się naturalny.

Prawie każdy widział obraz ze znakiem wodnym. Getty Images, która zajmuje się dystrybucją licencjonowanych zdjęć zrobionych podczas wydarzeń, używa znaku wodnego tak wszechobecnego i rozpoznawalnego, iż jego

. (W rzeczywistości znak wodny to teraz na podstawie pozwu Getty’ego przeciwko platformie generującej sztuczną inteligencję Midjourney, przy czym Getty utrzymuje, iż Midjourney musiał przejąć treści chronione prawem autorskim, ponieważ generuje znak wodny Getty w swoich wynikach). Oczywiście artyści podpisali swoje prace na długo przed pojawieniem się mediów cyfrowych, a choćby pojawieniem się fotografii, w aby ludzie wiedzieli, kto jest autorem obrazu. Ale sam znak wodny — wg Historia projektowania graficznego — zaczęło się w średniowieczu, kiedy mnisi zmieniali grubość mokrego papieru drukarskiego i dodawali własne znaki. Cyfrowe znaki wodne zyskały na popularności w latach 90. wraz ze wzrostem popularności treści cyfrowych. Firmy i rządy zaczęły umieszczać znaczniki (ukryte lub inne), aby ułatwić śledzenie własności, praw autorskich i autentyczności.

Znaki wodne, tak jak poprzednio, przez cały czas będą określać, kto jest właścicielem i twórcą mediów, na które ludzie patrzą. Jednak jako rozwiązanie polityczne problemu deepfake’ów ta nowa fala znaków wodnych zasadniczo oznaczałaby treści jako stworzone przez sztuczną inteligencję lub człowieka. Odpowiednie tagowanie od twórców sztucznej inteligencji teoretycznie wskazywałoby również pochodzenie treści generowanych przez sztuczną inteligencję, co dodatkowo rozwiązałoby kwestię, czy przy jej tworzeniu wykorzystano materiały chronione prawem autorskim.

Firmy technologiczne przyjęły dyrektywę Bidena i powoli wypuszczają swoje rozwiązania w zakresie znaków wodnych AI. Znak wodny może wydawać się prosty, ale ma jedną istotną wadę: znak wodny wklejony na obraz lub film można łatwo usunąć dzięki edycji zdjęć lub wideo. Wyzwaniem staje się zatem utworzenie znaku wodnego, którego Photoshop nie będzie w stanie usunąć.

Wyzwaniem staje się zatem utworzenie znaku wodnego, którego Photoshop nie będzie w stanie usunąć.

Firmy takie jak Adobe i Microsoft — członkowie grupy branżowej Coalition for Content Provenance and Authenticity (C2PA) — przyjęły Content Credentials, standard, który dodaje funkcje do obrazów i filmów pochodzenia. Adobe ma stworzył symbol poświadczeń treści to zostaje osadzone w mediach; Microsoft ma również własną wersję. Dane uwierzytelniające treści osadzają w mediach pewne metadane — np. kto stworzył obraz i jaki program został użyty do jego utworzenia. w idealnym przypadku użytkownicy będą mogli kliknąć lub dotknąć symbolu, aby samodzielnie wyświetlić metadane. (Nie zostało jeszcze udowodnione, czy ten symbol może przetrwać obróbkę zdjęć.)

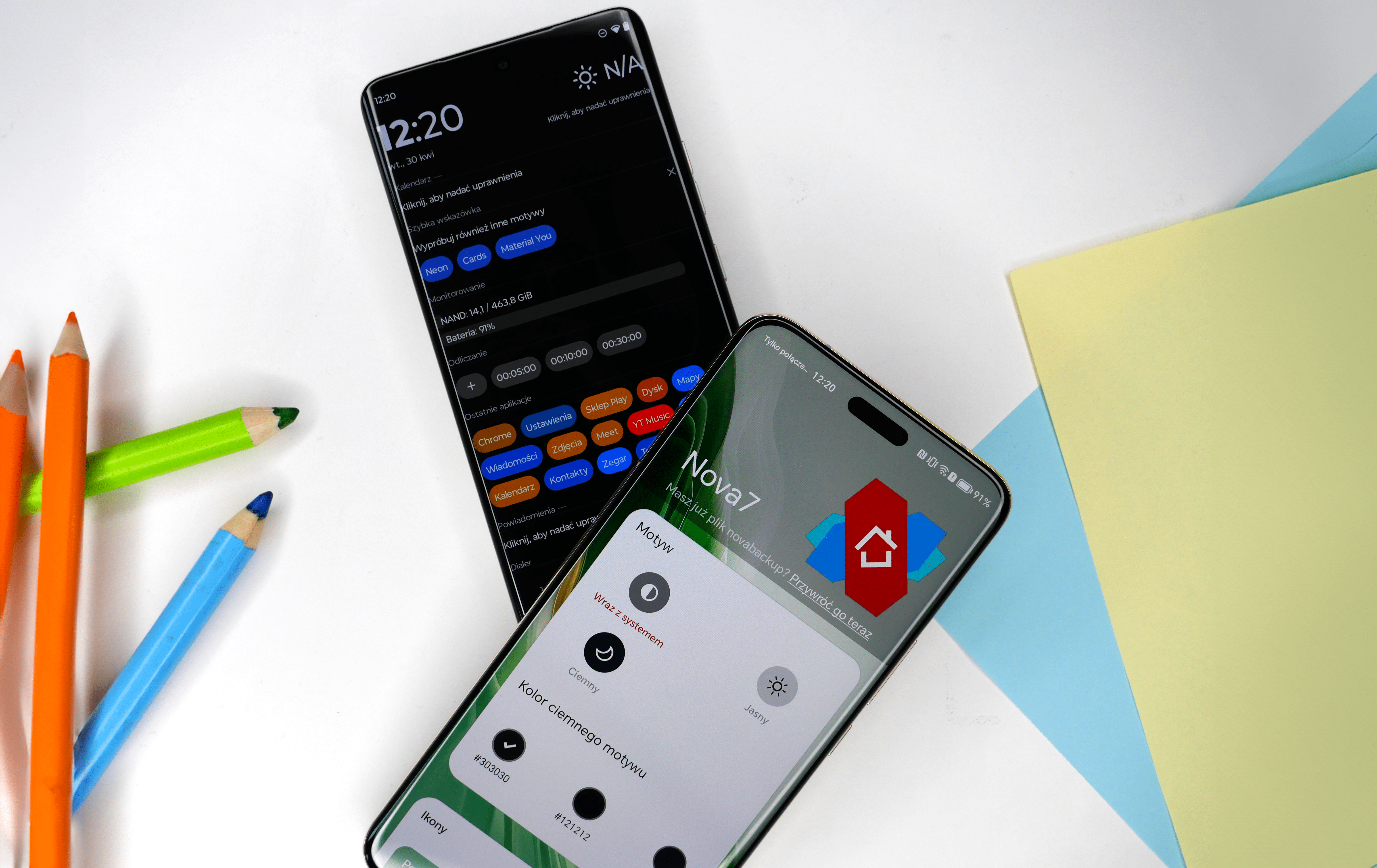

Tymczasem Google twierdzi, iż w tej chwili nad tym pracuje co nazywa SynthID, znak wodny osadzany w pikselach obrazu. SynthID jest niewidoczny dla ludzkiego oka, ale przez cały czas wykrywalny dzięki narzędzia. Digimarc, producent systemu specjalizujący się w cyfrowych znakach wodnych, ma również własną funkcję znakowania wodnego AI; dodaje do obrazu symbol czytelny dla maszyny przechowujący informacje o prawach autorskich i własności w jego metadanych.

Wszystkie te próby znakowania wodnego mają na celu albo uczynienie znaku wodnego niezauważalnym dla ludzkiego oka, albo przeniesienie ciężkiej pracy na metadane nadające się do odczytu maszynowego. Nic dziwnego: takie podejście jest najpewniejszym sposobem przechowywania informacji bez ich usuwania i zachęca ludzi do bliższego przyjrzenia się pochodzeniu obrazu.

Wszystko w porządku, jeżeli próbujesz zbudować system wykrywania praw autorskich, ale co to oznacza w przypadku deepfake’ów, w przypadku których problemem jest to, iż oszukuje się omylne ludzkie oczy? Znak wodny obciąża konsumenta, opierając się na indywidualnym wyczuciu, iż coś jest nie tak z informacją. Jednak ludzie na ogół nie mają zwyczaju sprawdzania pochodzenia wszystkiego, co widzą w Internecie. choćby jeżeli deepfake zostanie oznaczony charakterystycznymi metadanymi, ludzie i tak dadzą się nabrać — niezliczoną ilość razy widzieliśmy, iż gdy informacje zostaną zweryfikowane w Internecie, wiele osób nadal nie chce wierzyć informacje sprawdzone pod kątem faktów.

Eksperci uważają tag treści nie wystarczy aby zapobiec dotarciu dezinformacji do konsumentów, więc dlaczego znak wodny miałby działać przeciwko deepfakes?

Wydaje się, iż najlepszą rzeczą, jaką można powiedzieć o znakach wodnych, jest to, iż w ogóle są czymkolwiek. A ze względu na ogromną skalę możliwości szybkiego i łatwego wytworzenia treści generowanych przez sztuczną inteligencję, niewielkie tarcia mogą mieć duże znaczenie.

W końcu nie ma nic złego w podstawowej idei znaku wodnego. Widoczne znaki wodne sygnalizują autentyczność i mogą zachęcać ludzi do większego sceptycyzmu wobec mediów bez nich. A jeżeli widza rzeczywiście zaciekawi autentyczność, znaki wodne bezpośrednio dostarczają tej informacji.

Wydaje się, iż najlepszą rzeczą, jaką można powiedzieć o znakach wodnych, jest to, iż w ogóle są czymkolwiek.

Znak wodny nie może być idealnym rozwiązaniem z powodów, które wymieniłem (a poza tym badaczom udało się złamać wiele systemów znaków wodnych tam). Działa to jednak w połączeniu z rosnącą falą sceptycyzmu wobec tego, co ludzie widzą w Internecie. Muszę przyznać, iż kiedy zaczynałem to pisać, myślałem, iż łatwo jest oszukać ludzi, wierząc, iż naprawdę dobre zdjęcia DALL-E 3 lub Midjourney zostały wykonane przez ludzi. Zdałem sobie jednak sprawę, iż dyskurs na temat sztuki sztucznej inteligencji i deepfake’ów przeniknął do świadomości wielu osób chronicznie online. Zamiast akceptować okładki magazynów lub posty na Instagramie jako autentyczne, pojawia się teraz cień wątpliwości. Użytkownicy mediów społecznościowych regularnie badają i zwracają uwagę na marki, które korzystają ze sztucznej inteligencji. Zobacz, jak gwałtownie internetowi detektywi zadzwonili do napisy początkowe Tajna inwazja i Plakaty generowane przez sztuczną inteligencję Prawdziwy detektyw.

Opieranie się na sceptycyzmie, ciekawości lub chęci sprawdzenia, czy coś jest generowane przez sztuczną inteligencję, przez cały czas nie jest doskonałą strategią. Znaki wodne mogą być dobre, ale musi być coś lepszego. Ludzie mają większe wątpliwości co do treści, ale to jeszcze nie wszystko. Któregoś dnia możemy znaleźć rozwiązanie, które będzie pokazywać, iż coś zostało stworzone przez sztuczną inteligencję, bez nadziei, iż widz będzie chciał się dowiedzieć, czy tak jest.

Na razie najlepiej nauczyć się rozpoznawać, czy film tak naprawdę nie przedstawia polityka.