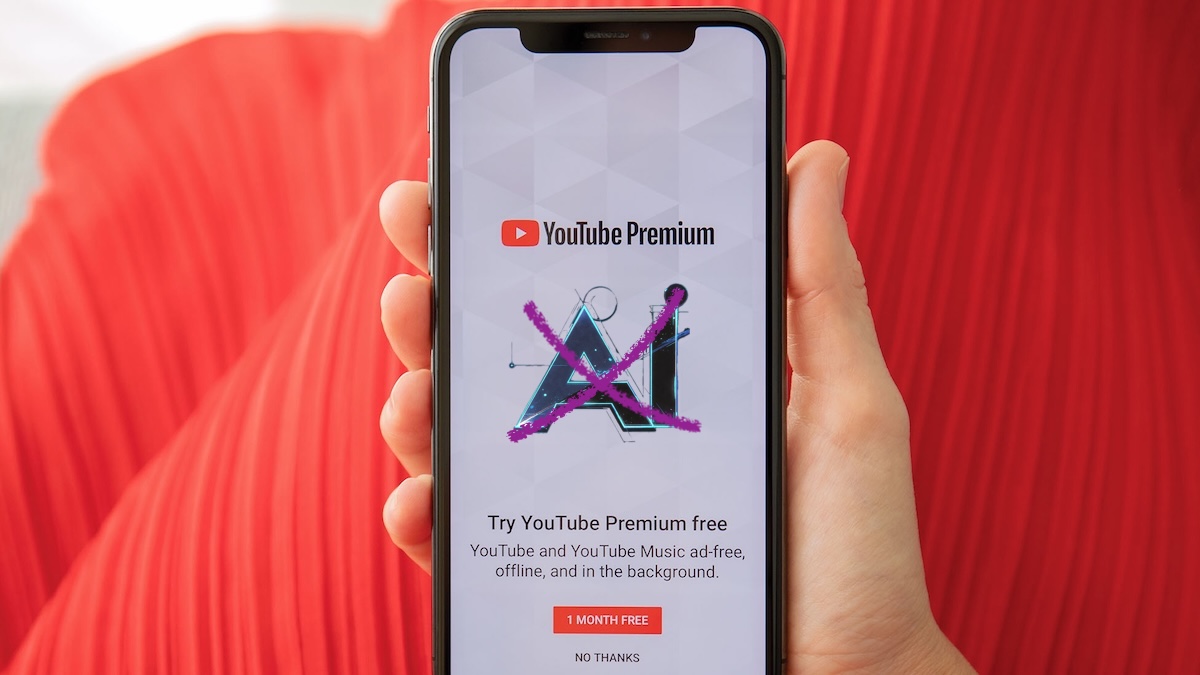

Ale może tylko tak nam się wydaje? Pojawia się też bardzo ważne pytanie: czy sztuczna inteligencja zabierze nam pracę? Prawdę mówiąc, już zabrała!

Na stronie portalu internetowego posługującego się sztuczną inteligencją czytam, iż odbiorcy mediów nie chcą newsów tworzonych przez SI. Może i nie chcą, ale często nie wiedzą, iż niektóre wiadomości zostały stworzone przez boty. Czy zostali o tym poinformowani? Dlaczego firmy medialne nie przyznają się do korzystania z botów? Niektóre redakcje ukrywają ten fakt, bo „chcą zachować obraz zespołów dziennikarskich, które są odpowiedzialne za tworzenie i weryfikację informacji. Informacja o używaniu botów może sugerować, iż redakcje delegują tę odpowiedzialność na algorytmy”. To wypowiedź ChataGPT w odpowiedzi na moje pytanie o rolę SI w redakcjach. Brzmi przekonująco i wiarygodnie…

Reuters Institute opublikował raport medioznawców R. Fletchera i R.K. Niel sena, co o udziale sztucznej inteligencji w tworzeniu newsów myślą respondenci w sześciu krajach – Argentynie, Danii, Francji, Japonii, Wielkiej Brytanii i USA. Okazuje się, iż według nich newsy tak generowane będą mniej godne zaufania i mniej przejrzyste, ale za to bardziej aktualne i tańsze w produkcji. Ten ostatni argument wiele znaczy, bo na przykład aktorzy zastępowani są sztucznymi tworami, albowiem przynosi to znaczne oszczędności w produkcji filmowej. Według raportu 27 procent badanych sądzi, iż SI jest używana do pisania artykułów przez dziennikarzy. Badani w większym stopniu akceptują tzw. soft newsy (np. o modzie czy sportowe) tworzone przez sztuczną inteligencję niż o polityce czy sprawach międzynarodowych. Prawie połowa chciałaby, żeby „autor” był w takich przypadkach ujawniony odbiorcy.

Wśród dziennikarzy i odbiorców mediów stale rosną obawy przed tworzeniem przez sztuczną inteligencję fejkowych, zmyślonych informacji. Ale nie tylko to zagraża przyszłości „ludzkiego” dziennikarstwa. Boty jako tania i bezkonfliktowa siła robocza mogą zdominować w przyszłości rynek informacji. Jednak tylko 8 procent ankietowanych w raporcie Reutersa sądzi, iż wyprodukowane w ten sposób wiadomości będą bardziej wartościowe niż te wytworzone przez ludzi. w tej chwili aż 43 proc. respondentów uważa, iż dziennikarze korzystają z pomocy generatywnej sztucznej inteligencji do poprawiania pisowni i gramatyki, a prawie jedna trzecia myśli, iż również do pisania tytułów i tekstów artykułów.

Sztuczna inteligencja staje się coraz bardziej istotnym narzędziem w dziennikarstwie, przekształcając tradycyjny proces pisania artykułów. SI pomaga dziennikarzom na różnych etapach pracy – od zbierania informacji po tworzenie tekstów. Jednym z głównych zastosowań SI jest analiza i przetwarzanie dużych ilości danych. Algorytmy mogą gwałtownie przeszukiwać ogromne zasoby informacji, wyodrębniając istotne fakty, co znacznie przyspiesza pracę dziennikarzy. Dzięki temu mogą oni się skupić na bardziej złożonych zadaniach, takich jak interpretacja danych czy pisanie pogłębionych analiz.

Powyższy akapit napisał ChatGPT. Czym on się różni od „ludzkiego”? Niczym. Kto więc od kogo uczy się dziś pisania tekstów? Czy pisząc artykuły podobne do generowanych przez SI, nie staję się tym samym sztuczną inteligencją?