Już w kwietniu firma Meta zapowiadała, iż pracuje nad czymś nowym w branży sztucznej inteligencji: modelem typu open source, którego wydajność dorównuje najlepszym prywatnym modelom oferowanym przez takie firmy jak OpenAI.

Dziś ten model nadszedł. Meta wypuszcza Llama 3.1, największy w historii model AI typu open source, który według firmy przewyższa GPT-4o I Sonet Claude 3.5 wydawnictwa Anthropic w kilku testach porównawczych. Udostępnia również asystenta Meta AI opartego na Llama w większej liczbie państw i języków, a także dodaje funkcję, która może generować obrazy na podstawie czyjegoś konkretnego podobieństwa. CEO Mark Zuckerberg

iż do końca tego roku Meta AI będzie najpopularniejszym asystentem, wyprzedzając ChatGPT.

Llama 3.1 jest znacznie bardziej złożona niż mniejsze modele Llama 3 to wyszło kilka miesięcy temuNajwiększa wersja ma 405 miliardów parametrów i została wytrenowana przy użyciu ponad 16 000 parametrów firmy Nvidia. ultra drogie procesory graficzne H100Meta nie ujawnia kosztów opracowania Llama 3.1, ale biorąc pod uwagę sam koszt układów Nvidia, można śmiało wnioskować, iż były to setki milionów dolarów.

Więc biorąc pod uwagę koszty, dlaczego Meta przez cały czas rozdaje Llamę z licencją, która wymaga jedynie zatwierdzenia przez firmy z setkami milionów użytkowników? list opublikowany na firmowym blogu MetaZuckerberg twierdzi, iż modele sztucznej inteligencji oparte na otwartym kodzie źródłowym prześcigną modele zastrzeżone i będą się od nich rozwijać szybciej, podobnie jak Linux stał się systemem operacyjnym o otwartym kodzie źródłowym, na którym opiera się większość dzisiejszych telefonów, serwerów i gadżetów.

„Punkt zwrotny w branży, w którym większość programistów zaczyna korzystać przede wszystkim z systemu typu open source”

Porównuje inwestycję Meta w AI typu open source do wcześniejszego Open Compute Project, który, jak twierdzi, zaoszczędził firmie „miliardy” dzięki pomocy zewnętrznych firm, takich jak HP, w ulepszaniu i standaryzacji projektów centrów danych Meta, podczas gdy firma budowała własne możliwości. Patrząc w przyszłość, spodziewa się, iż ta sama dynamika będzie miała miejsce w przypadku AI, pisząc: „Uważam, iż wydanie Llama 3.1 będzie punktem zwrotnym w branży, w której większość programistów zacznie korzystać przede wszystkim z systemu typu open source”.

Aby pomóc w wypuszczeniu Llama 3.1 na świat, Meta współpracuje z ponad dwoma tuzinami firm, w tym Microsoft, Amazon, Google, Nvidia i Databricks, aby pomóc deweloperom wdrożyć ich własne wersje. Meta twierdzi, iż uruchomienie Llama 3.1 w środowisku produkcyjnym kosztuje około połowę GPT-4o OpenAI. Udostępnia wagi modelu, aby firmy mogły trenować go na niestandardowych danych i dostrajać według własnych upodobań.

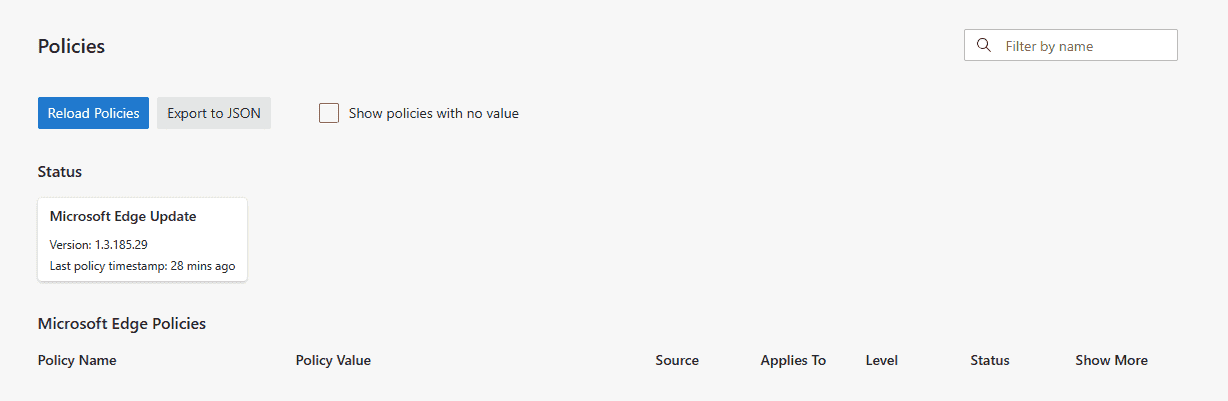

Według rzecznika Meta Jona Carvilla, Gemini nie zostało uwzględnione w tych testach porównawczych, ponieważ Meta miała trudności z powtórzeniem wcześniej ogłoszonych wyników dzięki interfejsów API Google’a.Wykres: Meta

Lista najważniejszych partnerów Meta i oferowanych przez nich możliwości wdrożenia Llama 3.1.Wykres: Meta

Nic dziwnego, iż Meta nie mówi zbyt wiele o danych, których użyła do wytrenowania Llamy 3.1. Ludzie pracujący w firmach zajmujących się sztuczną inteligencją twierdzą, iż nie ujawniają tych informacji, ponieważ stanowią tajemnicę handlową, natomiast krytycy twierdzą, iż jest to taktyka mająca na celu opóźnienie nieuniknionej fali pozwów o naruszenie praw autorskich.

Meta powie, iż wykorzystała dane syntetyczne, czyli dane wygenerowane przez model, a nie przez ludzi, aby 405-miliardowa wersja parametrów Llama 3.1 ulepszyła mniejsze wersje 70-miliardowe i 8-miliardowe. Ahmad Al-Dahle, wiceprezes ds. generatywnej AI w Meta, przewiduje, iż Llama 3.1 będzie popularna wśród programistów jako „nauczyciel dla mniejszych modeli, które są następnie wdrażane” w „bardziej opłacalny sposób”.

Kiedy pytam, czy Meta zgadza się z rosnący konsensus iż branża kończy wysokiej jakości dane szkoleniowe dla modeli, Al-Dahle sugeruje, iż zbliża się pułap, choć może być on dalej, niż niektórzy myślą. „Zdecydowanie uważamy, iż mamy jeszcze kilka [training] „biega”, mówi. „Ale trudno powiedzieć”.

Po raz pierwszy red teaming (lub testowanie antagonistyczne) Llama 3.1 przez Meta obejmowało poszukiwanie potencjalnych przypadków użycia cyberbezpieczeństwa i biochemii. Innym powodem, aby testować model bardziej intensywnie, jest to, co Meta opisuje jako pojawiające się zachowania „agentowe”.

Na przykład Al-Dahle mówi mi, iż Llama 3.1 jest w stanie zintegrować się z API wyszukiwarki, aby „pobrać informacje z Internetu na podstawie złożonego zapytania i wywołać wiele narzędzi po kolei, aby wykonać zadania”. Innym przykładem, który podaje, jest poproszenie modelu o wykreślenie liczby domów sprzedanych w Stanach Zjednoczonych w ciągu ostatnich pięciu lat. „Może pobrać [web] wyszukać dla Ciebie, wygenerować kod Pythona i go wykonać.”

Własną implementacją Llama przez Meta jest jej asystent AI, który jest pozycjonowany jako ogólny chatbot, taki jak ChatGPT i można go znaleźć w niemal każdej części Instagrama, Facebooka i WhatsApp. Od tego tygodnia Llama 3.1 będzie najpierw dostępna za pośrednictwem WhatsApp i witryny Meta AI w USA, a następnie w nadchodzących tygodniach na Instagramie i Facebooku. Jest aktualizowana, aby obsługiwać również nowe języki, w tym francuski, niemiecki, hindi, włoski i hiszpański.

Podczas gdy najbardziej zaawansowany model parametrów Llama 3.1 o 405 miliardach jest darmowy w Meta AI, asystent przełączy Cię na bardziej ograniczony model o 70 miliardach po przekroczeniu nieokreślonej liczby monitów w danym tygodniu. Sugeruje to, iż model o 405 miliardach jest zbyt drogi, aby Meta mogła działać na pełną skalę. Rzecznik Jon Carvill powiedział mi, iż firma poda więcej informacji na temat progu monitów po ocenie wczesnego wykorzystania.

Nowa funkcja „Imagine Me” w Meta AI skanuje twoją twarz dzięki aparatu w telefonie, aby następnie umożliwić ci wstawienie twojego wizerunku do generowanych przez niego obrazów. Dzięki przechwytywaniu twojego wizerunku w ten sposób, a nie dzięki zdjęć w twoim profilu, Meta ma nadzieję uniknąć stworzenia maszyny deepfake. Firma widzi zapotrzebowanie na ludzi, którzy chcą tworzyć więcej rodzajów mediów AI i udostępniać je w swoich kanałach, choćby jeżeli oznacza to zatarcie granicy między tym, co jest dostrzegalnie prawdziwe, a tym, co nie.

Meta AI pojawi się również w zestawie słuchawkowym Quest w nadchodzących tygodniach, zastępując interfejs poleceń głosowych. Podobnie jak jego implementacja w okularach Meta Ray-Banbędziesz mógł używać Meta AI w Quest, aby identyfikować i poznawać to, co oglądasz, będąc w tryb przejścia zestawu słuchawkowego który pokazuje prawdziwy świat poprzez wyświetlacz.

„Myślę, iż cała branża pozostało na wczesnym etapie drogi do dopasowania produktu do rynku”

Oprócz prognozy Zuckerberga, iż Meta AI będzie najczęściej używanym chatbotem do końca tego roku (ChatGPT ma ponad 100 milionów użytkowników), Meta nie udostępniła jeszcze żadnych danych o wykorzystaniu swojego asystenta. „Myślę, iż cała branża jest wciąż na wczesnym etapie drogi do dopasowania produktu do rynku” — mówi Al-Dahle. choćby biorąc pod uwagę, jak bardzo przereklamowana może być sztuczna inteligencja, jasne jest, iż Meta i inni gracze uważają, iż wyścig dopiero się zaczyna.