ChatGPT to temat, który zdaje się być omawiany z każdej strony, ale nie możemy przestać zwracać uwagi na kwestie bezpieczeństwa i różnorodne sposoby jego wykorzystania. Co więcej, warto podkreślić, iż edukacja stanowi istotny element przyszłego rozwoju między innymi tego niezwykle innowacyjnego narzędzia.

Czym jest ChatGPT?

ChatGPT to model językowy oparty na sztucznej inteligencji. Jest on rozwinięciem wcześniejszego modelu GPT-3, co oznacza, iż ma zdolność do generowania tekstu na podstawie wprowadzonych mu informacji. Co ważne, ChatGPT potrafi generować tekst w sposób, który imituje ludzką mowę i reaguje na pytania i komunikaty użytkownika.

Pierwsze informacje o ChatGPT pojawiły się na łamach “The Guardian”. Już w ciągu pięciu dni od jego uruchomienia, zyskał on ponad milion użytkowników, co potwierdza ogromne zainteresowanie tą technologią. w tej chwili korzysta z niej ponad 100 milionów użytkowników na całym świecie.

Zastosowanie AI i ChatGPT

ChatGPT ma szerokie zastosowanie w wielu dziedzinach. Jednym z głównych obszarów wykorzystania jest obszar redakcji i tworzenia treści. Dziennikarze, pisarze i twórcy treści korzystają z ChatGPT, aby pomóc sobie w generowaniu pomysłów, tworzeniu tekstów i poprawianiu gramatyki. Jednak nie jest to jedyny obszar zastosowania.

W biznesie ChatGPT może pomóc w obszarze obsługi klienta. Może odpowiadać na pytania klientów, pomagać w rozwiązywaniu problemów i udzielać informacji na temat produktów i usług. To oszczędza czas i zasoby firm, a jednocześnie poprawia jakość obsługi klienta.

Jak korzystać z ChatGPT

Korzystanie z ChatGPT jest stosunkowo proste. Wystarczy wejść na stronę openai.com i skorzystać z dostępu do ChatGPT. Można także integrować ChatGPT z własnymi aplikacjami i serwisami internetowymi dzięki API. Jest to przyjazne narzędzie, które można dostosować do różnych potrzeb.

Najważniejsze jest jednak to, iż korzystanie z ChatGPT wymaga ostrożności i odpowiedniego wykorzystania. Warto pamiętać, iż ChatGPT generuje tekst na podstawie danych, które są dostępne w Internecie, co może potencjalnie prowadzić do generowania dezinformacji lub treści nieodpowiednich. Dlatego ważne jest, aby być świadomym ograniczeń i ryzyka związanego z tym narzędziem.

Bezpieczeństwo AI i ChatGPT

Bezpieczeństwo AI to kwestia, która budzi coraz większe zainteresowanie w kontekście rozwoju sztucznej inteligencji. ChatGPT nie jest wyjątkiem. Istnieją obawy dotyczące tego, iż technologia ta może być wykorzystywana do celów nieetycznych, takich jak szerzenie dezinformacji, manipulacja treścią lub tworzenie treści szkodliwych.

OpenAI zdaje sobie sprawę z tych zagrożeń i pracuje nad zapewnieniem bezpieczeństwa AI. Organizacja ta stosuje różne techniki, takie jak moderacja treści i filtry, aby zapobiegać nadużyciom i utrzymaniu bezpiecznego środowiska dla użytkowników.

Czy ChatGPT zastąpi specjalistów?

To pytanie nie ma jednoznacznej odpowiedzi. ChatGPT i podobne narzędzia AI mają ogromny potencjał do automatyzacji wielu zadań, ale nie zawsze mogą zastąpić ludzką wiedzę i doświadczenie. W niektórych dziedzinach, takich jak medycyna czy inżynieria, specjaliści posiadają unikalną wiedzę i umiejętności, które nie mogą być łatwo zautomatyzowane.

Jednak ChatGPT może być wartościowym narzędziem wspomagającym pracę specjalistów. Może dostarczać informacji, pomagać w analizie danych i wspierać podejmowanie decyzji. Warto zauważyć, iż wiele firm i organizacji już korzysta z AI, aby usprawnić swoje procesy i usługi.

Statystyki użytkowników ChatGPT

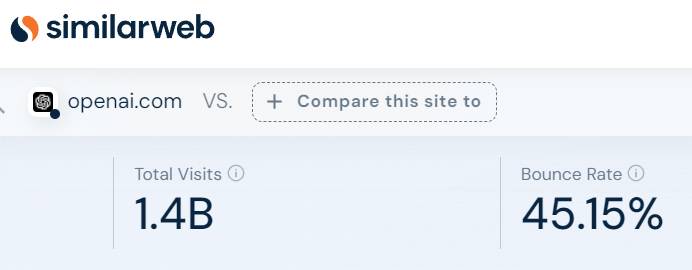

Aby lepiej zrozumieć skalę popularności ChatGPT, warto przyjrzeć się kilku statystykom użytkowników, opublikowanym na łamach “The Guardian” oraz danych ze strony Similarweb:

- Obecnie ChatGPT posiada ponad 100 milionów użytkowników na całym świecie, co świadczy o ogromnym zainteresowaniu tą technologią.

- W zaledwie 5 dni od uruchomienia, ChatGPT przekroczył liczbę 1 miliona użytkowników, co jest niezwykle imponującym osiągnięciem.

- Strona openai.com odnotowuje około 1 miliarda odwiedzin miesięcznie, co dowodzi ogromnego zainteresowania treściami związanymi z AI i ChatGPT.

- Ponad 60% ruchu społecznościowego ChatGPT pochodzi via YouTube, co świadczy o popularności tego narzędzia wśród internautów.

- Ponad 15% użytkowników ChatGPT pochodzi z USA, co wskazuje na globalną rozpoznawalność i dostępność tego narzędzia.

Dane na temat ruchu w serwisie openai.com – Sierpień 2023, źródło: similarweb

Dane na temat ruchu w serwisie openai.com – Sierpień 2023, źródło: similarwebW miarę jak ChatGPT i podobne narzędzia AI przez cały czas się rozwijają, będziecie świadkami dalszego wpływu tej technologii na nasze życie i pracę. Jednak warto pamiętać, iż z tym rozwojem pojawiają się także nowe wyzwania, takie jak bezpieczeństwo i odpowiednie wykorzystanie technologii. Niezależnie od tego, czy ChatGPT zastąpi specjalistów w niektórych dziedzinach, czy też będzie wspierał ich pracę, jest to już teraz nieodłączna część naszej cyfrowej przyszłości.

Kwestie Bezpieczeństwa i Prywatności

Bezpieczeństwo i prywatność danych to kwestie nadrzędne, które wymagają szczególnej uwagi w kontekście AI, w tym również ChatGPT. Istnieją wytyczne i zasady, których należy przestrzegać, aby uniknąć potencjalnych zagrożeń. Poniżej omówimy, jakie dane i informacje nie powinny być przekazywane narzędziu AI, takim jak ChatGPT, ze względów bezpieczeństwa i prywatności:

- Dane osobowe: takie jak imię, nazwisko, adres zamieszkania, numer PESEL, adres e-mail czy numer telefonu, stanowią najważniejsze informacje o naszej tożsamości. Przekazywanie takich danych narzędziu AI, choćby jeżeli jest to ChatGPT, stanowi poważne ryzyko naruszenia prywatności. Firmy, które rozwijają i wdrażają AI, muszą zapewnić, iż narzędzia te są zoptymalizowane, aby nie przechodziły i nie zapisywały tego rodzaju informacji.

- Informacje zdrowotne: są jednymi z najbardziej wrażliwych danych, które powinny być ściśle chronione. Pytania dotyczące stanu zdrowia, chorób, leczenia czy historii medycznej nie powinny być przekazywane ChatGPT ani innym narzędziom AI. Bezpieczeństwo i prywatność pacjentów oraz zgodność z przepisami o ochronie danych medycznych są priorytetami.

- Dokumenty osobiste: zawierające dane osobowe, takie jak kopie dowodów osobistych, paszportów, prawa jazdy czy dokumenty tożsamości, również powinny pozostawać poza zasięgiem narzędzi AI. Przekazywanie takich dokumentów jest ryzykowne i może prowadzić do nadużyć lub kradzieży tożsamości.

Unia Europejska i Kwestie Bezpieczeństwa AI

Unia Europejska aktywnie zajmuje się kwestiami związanymi z bezpieczeństwem AI i ochroną danych osobowych. Jednak przez cały czas istnieje wiele wyzwań, które trzeba rozwiązać, aby dostosować regulacje do potrzeb dynamicznie rozwijającej się technologii AI. Poniżej przedstawiamy kilka kluczowych kwestii dotyczących regulacji AI w Unii Europejskiej:

- Przepisy Dotyczące Prywatności Danych: w tej chwili nie pozostało jasne, jak dokładnie AI będzie wpisywać się w przepisy dotyczące prywatności danych, takie jak RODO (RODO w Unii Europejskiej). Istnieją wyzwania związane z tym, jak AI może przetwarzać i przechowywać dane osobowe, zwłaszcza w kontekście narzędzi AI do automatyzacji odpowiedzi na zapytania.

- Prawa Autorskie i Dostępność Danych: Istnieją obawy, iż brak wyjątków od praw autorskich może ograniczyć dostępność danych potrzebnych do szkolenia modeli AI, takich jak ChatGPT. To ważne w kontekście naukowych badań i rozwoju technologii.

- Wpływ na rynek: Ograniczenia w dostępie do niektórych danych, takie jak treści objęte prawami autorskimi, mogą mieć wpływ na rynek AI i innowacje. w tej chwili rynek reaguje z niepokojem na możliwość ograniczenia dostępu do takich danych.

Unia Europejska ma jeszcze wiele pracy do zrobienia, aby dostosować regulacje do nowych wyzwań, jakie niesie rozwijająca się technologia AI. To zadanie będzie wymagało współpracy międzynarodowej i przemyślanych rozwiązań, aby zapewnić równowagę między bezpieczeństwem, prywatnością a innowacjami.

Kwestie bezpieczeństwa i prywatności pozostają kluczowymi wyzwaniami w dziedzinie AI, a w miarę jak technologia ta będzie się rozwijać, będziemy musieli przez cały czas dostosowywać nasze podejście do tych zagadnień. Oczywiście, zawsze istnieje potencjał do tworzenia nowych rozwiązań, które będą sprzyjać zarówno rozwojowi AI, jak i ochronie danych i prywatności użytkowników.

Przyszłość bezpieczeństwa i prywatności w AI

W miarę jak technologia AI, w tym ChatGPT, rozwija się i staje coraz bardziej powszechna, będziemy musieli przez cały czas skupiać się na zapewnieniu bezpieczeństwa i ochrony prywatności użytkowników. Oto kilka kierunków, które mogą kształtować przyszłość bezpieczeństwa AI:

- Rozwój algorytmów bezpieczeństwa: Organizacje zajmujące się AI, takie jak OpenAI, będą przez cały czas pracować nad rozwojem i wdrażaniem zaawansowanych algorytmów bezpieczeństwa, które pomogą wykrywać i zapobiegać nadużyciom. To najważniejszy element w ochronie przed niepożądanymi skutkami AI.

- Edukacja i świadomość: Wzrastająca świadomość użytkowników na temat zagrożeń i ryzyka związanego z AI może przyczynić się do bardziej odpowiedzialnego korzystania z tej technologii. Edukacja w zakresie bezpieczeństwa i ochrony prywatności jest kluczowym elementem.

- Regulacje i standardy: Państwa i organizacje międzynarodowe będą kontynuować prace nad tworzeniem regulacji i standardów dotyczących AI. Obejmuje to kwestie związane z prywatnością danych, etyką i zabezpieczeniami.

- Rozwój narzędzi do weryfikacji i monitorowania: Narzędzia do weryfikacji i monitorowania treści wygenerowanych przez AI, takie jak ChatGPT, staną się coraz bardziej zaawansowane. Dzięki nim będzie można dokładnie kontrolować i oceniać, co generuje AI.

- Etyka i odpowiedzialność: Firmy rozwijające AI będą musiały skupić się na etyce i odpowiedzialności w tworzeniu i wdrażaniu tych technologii. To nie tylko kwestia techniczna, ale także moralna.

ChatGPT – fascynująca ale i wymagająca przyszłość

ChatGPT i sztuczna inteligencja stanowią fascynującą przyszłość, ale jednocześnie niosą ze sobą wyzwania związane z bezpieczeństwem i ochroną prywatności danych. Korzystanie z tych narzędzi wymaga ostrożności i odpowiedzialności, a rozwijające się regulacje i standardy będą miały najważniejsze znaczenie w zapewnieniu równowagi między innowacjami a ochroną użytkowników.

Unia Europejska jest jednym z przykładów, gdzie podejmuje się próby uregulowania AI, ale przez cały czas pozostaje wiele kwestii do rozwiązania. Rozwój AI to proces dynamiczny, który będzie wymagał stałego dostosowywania regulacji i podejścia do nowych wyzwań.

W międzyczasie, edukacja i świadomość społeczeństwa na temat bezpieczeństwa i ochrony prywatności w AI będą miały ogromne znaczenie. Dążenie do równowagi między innowacjami a ochroną użytkowników będzie kluczowym elementem kształtowania przyszłości AI.