Sztuczna inteligencja zmienia sposób podejmowania decyzji, ale nie zastępuje odpowiedzialności liderów. W świecie, w którym część procesów musi pozostać w pełni deterministyczna, a inne mogą opierać się na eksperymentach, najważniejsze staje się znalezienie równowagi między danymi, technologią i doświadczeniem. O zarządzaniu w epoce AI rozmawiamy z Grahamem Ablem, VP of software engineering w globalnej firmie Workday.

Rafał Pikuła: Na początek chciałbym porozmawiać o byciu liderem w kontekście organizacji funkcjonującej w świecie AI. Moim zdaniem to bardzo trudne, bo z jednej strony odczuwasz presję, żeby wykorzystywać sztuczną inteligencję, a z drugiej masz swoje doświadczenie i intuicję. Powiedz, jak znaleźć między tym równowagę? I jak definiujesz „mądrego lidera”? Jaka jest Twoja osobista perspektywa?

Graham Abell: Myślę, iż w ciągu ostatnich kilku lat wszystko zmieniało się bardzo gwałtownie i skala zmian była ogromna. W takiej sytuacji szczególnie trudno mieć pewność co do czegokolwiek. Dlatego wracamy do klasycznych kompetencji przywódczych – jedną z kluczowych jest tolerancja na niepewność.

Jeśli chodzi o podejmowanie decyzji, to warto unikać tzw. decyzji jednokierunkowych (one-way doors), czyli takich, które są nieodwracalne. Lepiej zostawiać sobie możliwie dużo opcji. Widać to choćby na poziomie całej branży – to, co dziś jest dominującym modelem działania, potrafi zmieniać się kilka razy w krótkim czasie.

Dlatego najważniejsze jest pozostawanie elastycznym, akceptowanie braku pełnej jasności i podejmowanie najlepszych możliwych decyzji na dany moment – ale bez stawiania wszystkiego na jedną kartę. Ważne jest też, by zachęcać zespół do otwartości i eksperymentowania.

Eksperymentowanie nigdy nie było tak istotne jak dziś. I nigdy wcześniej bezpośredni, praktyczny kontakt z narzędziami nie był aż tak ważny. Szczególnie w obszarze rozwoju systemu – nie da się tego zrozumieć wyłącznie poprzez czytanie. Trzeba z tego korzystać, żeby zrozumieć, gdzie AI wnosi wartość, gdzie się nie sprawdza i jak włączyć je w codzienny workflow.

To ciekawe, bo kiedy rozmawiałem z liderami i CEO o AI w podejmowaniu decyzji, widziałem dwa skrajne podejścia. Z jednej strony entuzjaści AI, którzy chcą używać go praktycznie do wszystkiego. Z drugiej – bardziej tradycyjni liderzy, którzy mówią: „OK, są dane, ale to ja jestem najmądrzejszy w tym pokoju i ostateczna decyzja należy do mnie”.

Rzadko uważam się za najmądrzejszą osobę w pokoju – może poza opinią mojej mamy. Natomiast rzeczywiście najważniejsze jest znalezienie równowagi.

Nie można bezkrytycznie polegać na AI, ale warto je maksymalnie wykorzystywać tam, gdzie przynosi wartość. Powinno wspierać nasze działania, dostarczać insightów i rekomendacji, a w wielu przypadkach po prostu przyspieszać uzyskiwanie konkretnych rezultatów.

Na przykład w prototypowaniu – dzięki narzędziom takim jak Lovable czy podobnym można bardzo gwałtownie stworzyć wstępne rozwiązania, znacznie szybciej niż kiedyś i z dużo większą szczegółowością niż np. statyczne makiety. Można z nimi wejść w interakcję i szybciej zbierać wartościowy feedback – zarówno od klientów, jak i wewnętrznie.

To z kolei wzmacnia intuicję i pozwala podejmować decyzje z większą pewnością, iż „to po prostu ma sens”. Nasze role się zmieniają – każda dziedzina jest w pewnym stopniu wzmacniana przez AI i powinniśmy to wykorzystywać.

Jednocześnie przez cały czas kluczowi są eksperci dziedzinowi – ludzie z doświadczeniem, którzy rozumieją, co realnie zadziała. To zawsze będzie połączenie obu elementów.

Nie jest tak, iż bierzemy wynik z narzędzia AI i bezrefleksyjnie uznajemy go za prawdziwy. Zawsze podchodzimy do tego z rygorem i krytycznym myśleniem.

Jesteście firmą software’ową, więc naturalnie łatwiej Wam mówić o AI. Zakładam jednak, iż macie wielu klientów, którzy obawiają się wykorzystywania AI w swoich procesach. Jak rozmawiacie z takimi klientami?

Kluczowe jest zrozumienie, skąd bierze się ten strach. Często chodzi o ryzyko. Jako firma dostarczająca takie rozwiązania musimy zapewnić odpowiednie ramy, governance i bezpieczeństwo – tak, aby AI było odpowiedzialne i etyczne. To absolutna podstawa, coś nienegocjowalnego.

Bardzo ważna jest też wyjaśnialność (explainability) – czyli możliwość zrozumienia, jak system doszedł do danego wyniku. Bez tego nie ma zaufania.

Mamy więc trzy filary: bezpieczeństwo, zaufanie i jakość wyników.

Jeśli chodzi o interakcję, pojawia się dziś interesujący wątek: AI jako nowy interfejs użytkownika. To nie znaczy, iż chatboty zastąpią wszystko – chodzi raczej o różne formy interakcji dopasowane do różnych użytkowników.

W niektórych przypadkach wystarczy prosty interfejs konwersacyjny – szybkie pytanie i szybka odpowiedź. Ale dla bardziej zaawansowanych użytkowników, np. w finansach, to nie wystarczy. Oni chcą narzędzi przypominających arkusze kalkulacyjne, z dużą ilością danych – ale jednocześnie z możliwością interakcji w języku naturalnym, która dynamicznie aktualizuje dane.

Dlatego sposób prezentacji jest równie istotny jak sama technologia. Musimy spotykać użytkowników tam, gdzie są – zarówno pod względem narzędzi, jak i kontekstu pracy. AI powinno pojawiać się w ich naturalnym środowisku pracy, np. w narzędziach biurowych, a nie tylko w odizolowanych systemach.

I cały czas musi być transparentne oraz zrozumiałe.

Zgadzam się – zaufanie, bezpieczeństwo i etyka to fundament. I rzeczywiście poziom obaw zależy od zastosowania – inaczej wygląda to na rynkach finansowych, a inaczej np. w marketingu.

Zajmujemy się najbardziej krytycznymi obszarami funkcjonowania firm – ludźmi, biznesem, finansami. jeżeli połączysz te elementy, np. w procesie payrollowym, to 95 proc. poprawności absolutnie nie wystarcza. To oznacza, iż ludzie nie dostaną adekwatnego wynagrodzenia.

Dlatego są obszary, w których nie ma miejsca na kompromisy – systemy muszą działać w pełni deterministycznie, bezpiecznie i przewidywalnie. W takich przypadkach wprowadzanie probabilistycznej AI po prostu nie wchodzi w grę.

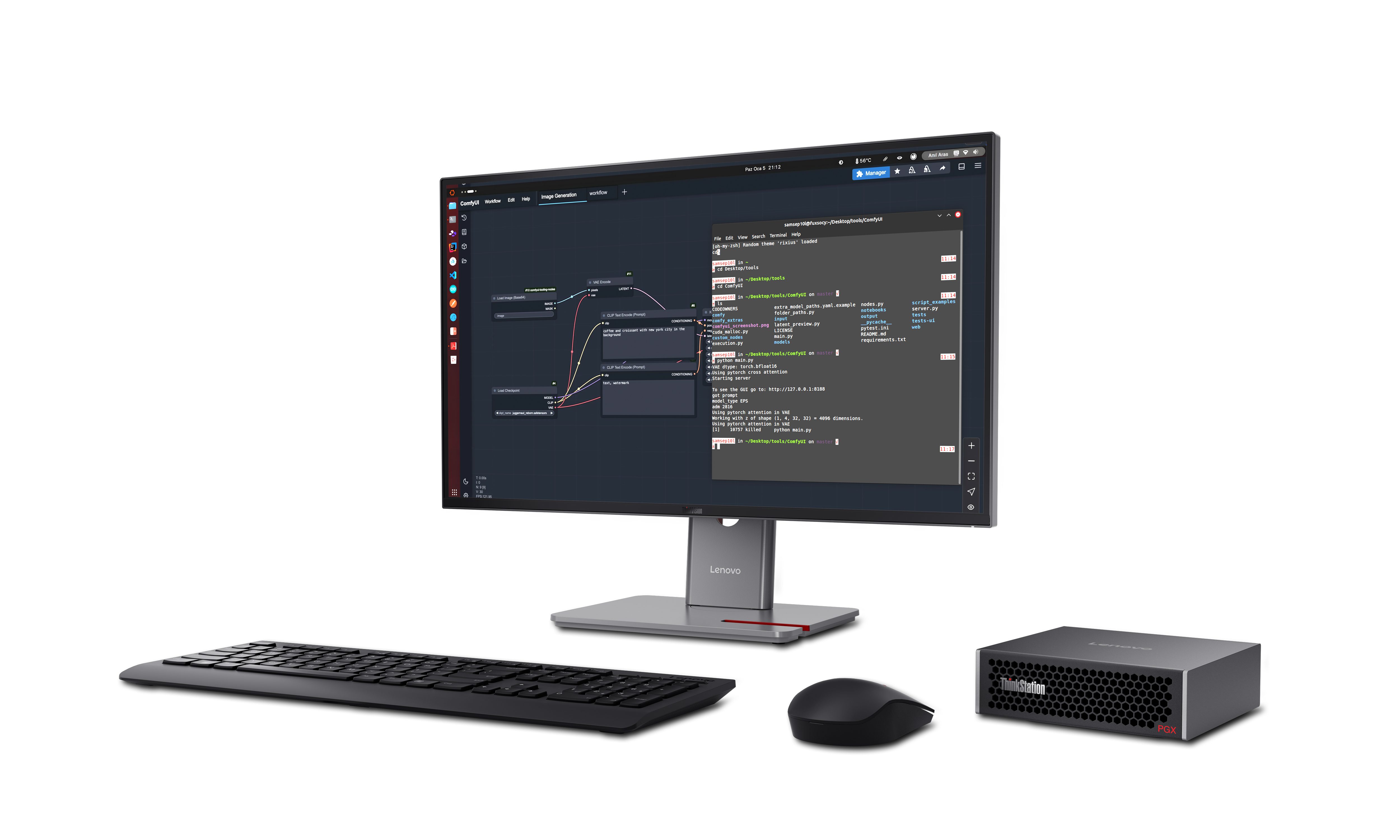

Graham Abell, VP of software engineering w globalnej firmie Workday, w trakcie spotkania dla mediów. Materiały prasowe.

Graham Abell, VP of software engineering w globalnej firmie Workday, w trakcie spotkania dla mediów. Materiały prasowe.To musi być deterministyczne. Oczywiście są też zadania, które łatwo zautomatyzować.

Tak, pewne elementy zdecydowanie da się automatyzować. Natomiast tam, gdzie wchodzą regulacje i krytyczne dane, wszystko musi być w pełni kontrolowalne.

Wracając do Twojego wcześniejszego pytania – kluczowa jest krytyczność problemu. W zależności od tego, dokąd zmierza firma i jak duże jest ryzyko, można pozwolić sobie na większą lub mniejszą elastyczność.

Jeśli coś nie jest regulowane ani krytyczne dla biznesu, można eksperymentować – np. przy pisaniu dokumentu wynik probabilistyczny jako pierwszy szkic jest w porządku i można go iteracyjnie poprawiać.

Natomiast tam, gdzie wynik bezpośrednio wpływa na działalność firmy, musi być po prostu poprawny.

Wspomniałeś o regulacjach – to bardzo istotny temat. Jesteście firmą amerykańską, działacie też w Europie, gdzie regulacje są inne. Czy Twoim zdaniem regulacje wspierają innowacje, czy raczej je hamują?

Myślę, iż mamy już pewne doświadczenie w tym obszarze. Obserwując zmieniający się krajobraz, jako firma byliśmy zadowoleni z wprowadzenia AI Act w Unii Europejskiej. Przede wszystkim dlatego, iż wniósł jasność – określił zasady gry i stworzył ramy, w których można bezpiecznie innowować.

Najważniejsze było to, iż pojawiły się wytyczne dla całej branży. Widzieliśmy wcześniej, np. w mediach społecznościowych, co się dzieje przy całkowitym braku regulacji – i jakie to przynosi negatywne skutki.

Dlatego uważamy, iż pewien poziom governance jest konieczny. Najlepiej, gdyby był możliwie ujednolicony – tymczasem np. w USA regulacje różnią się w zależności od stanu, co znacząco utrudnia działanie.

Dobra wiadomość jest taka, iż wiele państw zaczyna wzorować się na AI Act, co prowadzi do pewnej konwergencji zasad. Jako firma popieramy regulacje – szczególnie takie, które są oparte na analizie ryzyka. I znów wracamy do kluczowego punktu: są obszary, gdzie AI może być probabilistyczna, i takie, gdzie absolutnie nie powinna.

Czyli regulacje są potrzebne, ale pytanie brzmi: jakie? A z Twojej perspektywy – czy prowadzenie biznesu z regulacjami jest łatwiejsze czy trudniejsze?

To zawsze kwestia równowagi. Nadmierna regulacja jest problemem, ale pewien poziom zasad jest niezbędny. Przy tak gwałtownie rozwijającej się technologii potrzebujemy „barier ochronnych”, które pomogą uniknąć poważnych błędów.

Z drugiej strony nadregulacja rzeczywiście może hamować innowacje. Dobrym przykładem jest GDPR – z perspektywy technicznej jego wdrożenie było bardzo trudne i znacząco zwiększyło złożoność systemów, np. przez konieczność różnego traktowania tych samych danych w zależności od lokalizacji.

Wydaje się jednak, iż dziś jest większa świadomość, iż w niektórych obszarach posunięto się za daleko i realizowane są próby uproszczenia przepisów.

Nigdy nie osiągniemy idealnej równowagi – to raczej wahadło, które będzie się przesuwać w jedną i drugą stronę.

Czyli najważniejsze jest nie tylko „czy regulować”, ale „jak regulować”.

Dokładnie. Dlatego tak ważne jest podejście konsultacyjne. Przy AI Act uczestniczyliśmy jako firma w procesie konsultacji i dzięki temu końcowy efekt był bardziej wyważony.

To był proces, w który zaangażowane były trzy strony: regulatorzy, środowisko akademickie i biznes. Każda z nich wnosi inną perspektywę – regulatorzy patrzą na bezpieczeństwo, akademia na fundamenty i konsekwencje, a biznes na praktyczne zastosowanie i innowacyjność.

Dopiero połączenie tych trzech punktów widzenia pozwala stworzyć regulacje, które są jednocześnie sensowne i wykonalne.

Wracając do praktyki – rozmawialiśmy wczoraj o agentach AI. Myślę też o zjawisku „AI washing” i „agent washing”. To duży problem – AI stało się modnym hasłem. Jak odróżnić realne rozwiązania od marketingu i jak rozmawiać o tym z klientami?

Zdecydowanie obserwujemy zjawisko „agent washing”. Już około 18 miesięcy temu „agenci” byli modnym hasłem – a jednocześnie bardzo kilka było rzeczywistych implementacji.

Dla nas najważniejsze pytanie brzmi: co faktycznie robi agent? Czy dostarcza realną wartość biznesową? Czy wykonuje rzeczywistą pracę? Czy redukuje codzienny wysiłek użytkownika?

Chatbot to nie agent. Agent musi wykonywać konkretne zadania i generować mierzalne rezultaty. To zwykle nie jest zastąpienie całej pracy człowieka, ale realizacja konkretnych jednostek pracy.

W pracy z zespołami zawsze pytam: jakie konkretne zadania ten agent wykonał? Jaką wartość dostarczył? Dopiero wtedy możemy mówić o realnym agencie.

Problem polega też na tym, iż marketing często wyprzedza rzeczywistość.

Zgadza się – ale to nie jest nowe zjawisko. Tak było zawsze. Rynek w krótkim terminie działa jak „maszyna do głosowania”, a w długim jak „waga”.

To oznacza, iż rozwiązania, które faktycznie dostarczają wartość, przetrwają i będą się rozwijać. Te, które są tylko marketingiem – znikną.

Byłem niedawno na Web Summit w Lizbonie i rozmawiałem z Corym Doctorowem o bańce AI. Powiedział, iż jesteśmy w jej centrum. Jak Ty to widzisz? Czy narracja o „bańce AI” jest problemem dla Waszej firmy?

To zależy, jak definiujemy „bańkę”. jeżeli mówimy o inwestycjach i hype’ie – to tak, prawdopodobnie mamy z nią do czynienia. Dużo pieniędzy trafia dziś do firm tylko dlatego, iż mają etykietę „AI”.

Ale to nie potrwa wiecznie. Jak w każdej rewolucji technologicznej – przetrwają tylko firmy, które dostarczają realną wartość.

Nie spełniły się też najbardziej skrajne prognozy, np. całkowite załamanie rynku pracy. Z drugiej strony AI jeszcze nie dostarczyło pełnej wartości, jaką może wygenerować.

Szacunki mówią o ogromnym potencjale ekonomicznym – rzędu bilionów dolarów. Ten rynek istnieje, ale trzeba go realnie zbudować, dostarczając działające rozwiązania.

Zgadzam się. Problem w praktyce jest taki, iż mamy ogromną liczbę narzędzi AI i trudno odróżnić wartościowe rozwiązania od słabych.

I to też nie jest nic nowego. Przechodziliśmy przez to wielokrotnie przy wcześniejszych zmianach technologicznych. W dłuższej perspektywie rynek sam to zweryfikuje – słabe rozwiązania odpadną, a dobre będą się rozwijać i dominować.