Niepokojący trend w mediach społecznościowych polegający na phishingu, czyli manipulacji lub wyłudzania podstępem od użytkowników pieniędzy i wrażliwych danych osobowych nabiera na sile. Cyberprzestępcy upodobali sobie ostatnio szczególnie technologię deepfake, wykorzystując w tym celu wizerunki znanych osób jak aktor Tom Hanks. Cała sprawa rodzi pytania o to, jak najlepiej chronić gorzej zorientowanych w nowoczesnym świecie użytkowników internetu oraz o roli nadzoru regulacyjnego i kontroli technologicznej w przestrzeni cyfrowej.

Tom Hanks ostrzega przed technologią deepfake

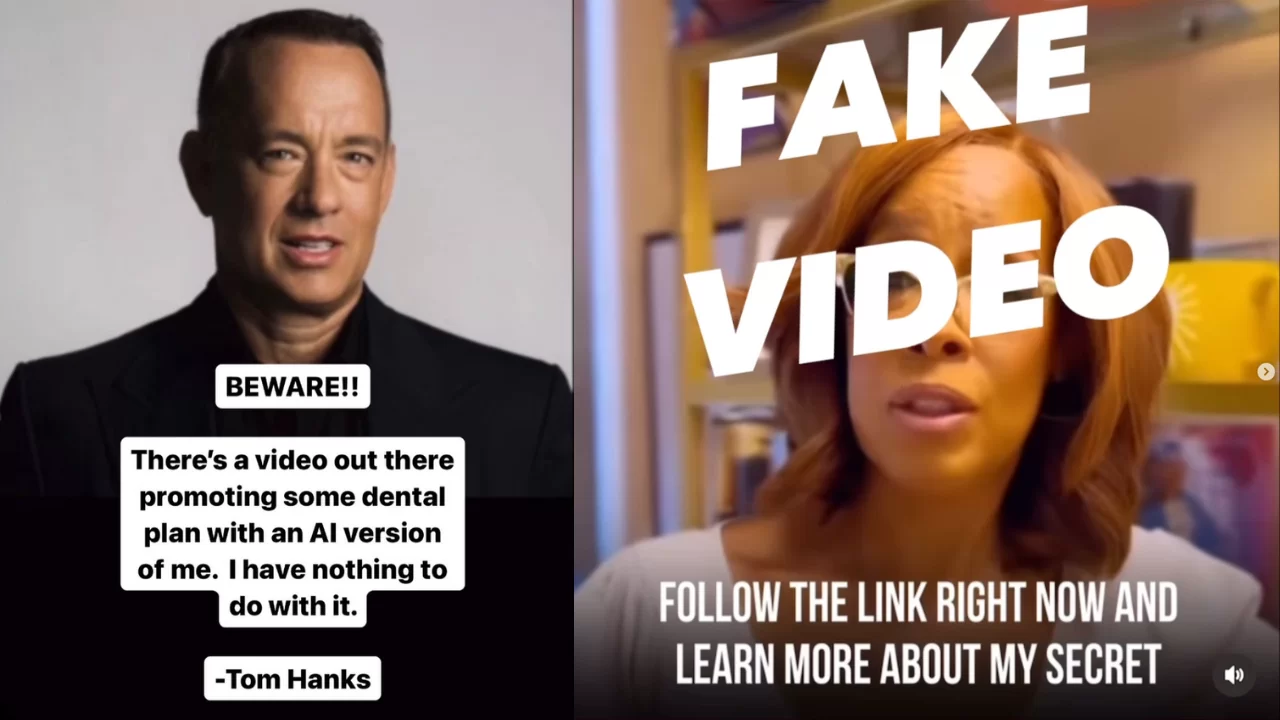

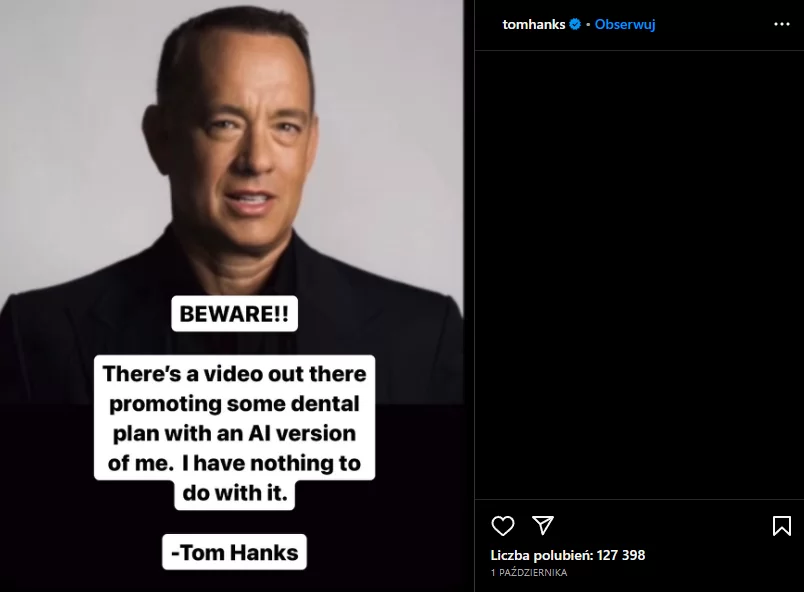

1 października oburzony amerykański aktor Tom Hanks opublikował na platformie społecznościowej Instagram

, w którym pokazuje jak manipulanci wykorzystali jego wizerunek przerobiony przez algorytmy sztucznej inteligencji w celu promowania „jakiegoś planu dentystycznego”.

fot. profil Toma Hanksa na Instagramie

fot. profil Toma Hanksa na InstagramieJuż następnego dnia podobny krok

prezenterka stacji CBS Gayle King, informując osoby obserwujące jej profil, iż bynajmniej nie reklamuje diety-cud, którą rzekomo „reklamuje”.

„Ludzie wciąż wysyłają mi ten film i pytają o ten produkt, a ja NIE mam NIC wspólnego z tą firmą… Opublikowałem ten film promujący mój program radiowy 31 sierpnia (przesuń palcem, aby zobaczyć oryginał), a oni zmanipulowali mój głos i wideo, aby wyglądało na to, iż go promuję…. Nigdy nie słyszałem o tym produkcie ani go nie używałam! Proszę, nie dajcie się zwieść tym filmom AI…” – protestuje King.

Obie odezwy odbiły się szerokim echem w mediach społecznościowych na temat nowych zagrożeń w sieci oraz wykorzystywania w tym celu osób, którym wielu ludzi mimo wszystko ufa dlatego iż są znani (a przecież ktoś, kto ma reputację do utrzymania nie wprowadzałby w błąd ludzi, prawda?). Żyjemy w erze w której rozpowszechnianie informacji jest banalne i potencjalnie nieograniczone, a nieautoryzowane wykorzystywanie deepfake’ów nie tylko stąpa po etycznie mętnym gruncie, ale też zagraża słabo zorientowanym użytkownikom internetu oraz wikła celebrytów w potencjalne problemy prawne.

„Rażący brak zgody i celowe wprowadzanie w błąd jest nie tylko nieetyczne, ale także stąpa po przysłowiowym cienkim lodzie jeżeli chodzi o prawo” – mówi Sophia Bernard, prawniczka zajmująca się problematyką własności intelektualnej.

Skoro już przy etyce jesteśmy wspominjmy chociażby córkę aktora Robina Williamsa, Zeldę, która trafiła niedawno na pierwsze strony gazet głośno protestując przeciwko nieautoryzowanemu klonowaniu głosu jej zmarłego ojca uważając to za brak elementarnego szacunku dla jego pamięci i dobra rodziny.

SAG-AFTRA, grupa reprezentująca hollywoodzkich celebrytów, wyraziła swój zdecydowany sprzeciw wobec wykorzystywania sztucznej inteligencji do cyfrowej replikacji aktorów bez należnego wynagrodzenia lub zgody, odzwierciedlając rosnące obawy w branży o to, iż będą oni stopniowo zastępowani przez maszyny i sztuczną inteligencję.

Eksperci są zdania, że deepfakes zagrażają fundamentom autentycznej komunikacji, zacierając granice między rzeczywistością a treściami generowanymi przez sztuczną inteligencję, zagrażając tym samym zaufaniu publicznemu i umożliwiając potencjalną dezinformację. Podczas gdy firmy takie jak Google i OpenAI szukają rozwiązań, takich jak znak wodny treści generowanych przez sztuczną inteligencję oraz śledzenie metadanych w celu odnalezienia źródła, sam problem pozostaje bardzo ciężki do rozwiązania. Dlaczego? Przede wszystkim wszelkie ograniczenia będzie raczej dość łatwo obejść, a obostrzenia nałożone na komercyjne algorytmy sztucznej inteligencji zastąpią tworzone na niecne potrzeby systemu otwartoźródłowe.

Prawdopodobnie najsłynniejszy twórca treści w serwisie YouTube, MrBeast, który sam zresztą „padł ofiarą” technologii deepfake wyraził niedawno publicznie swoje obawy na ten temat, pisząc: „Czy platformy mediów społecznościowych są przygotowane do radzenia sobie z rosnącym zagrożeniem ze strony sztucznej inteligencji?„

Podczas gdy systemy wykrywania, weryfikacji i regulacyjne kuleją i zostają w tyle w stosunku do wykładniczego rozwoju technologii AI, potencjalne rozwiązania wydają się być fragmentaryczne i obarczone własnymi wyzwaniami. Restrykcyjne przepisy mogą utrudniać pracę badaczom i profesjonalistom, jednocześnie potencjalnie pozwalając złoczyńcom działać w szarej strefie niemal całkowicie bezkarnie.

Może się okazać, iż ostatecznie faktycznie będziemy skazani wyłącznie na własne doświadczenie i intuicję.