To nie kolejny raport pełen technicznych bzdurek – a diagnostyka społeczno-psychologiczna dziecięcej interakcji z czatbotami, w tym z ChatGPT, Snapchatem My AI czy Repliką. Są powody do bicia na alarm, bowiem nieletni nawiązują silne emocjonalne więzi z bezdusznymi algorytmami.

Z raportu wynika, iż aż 64 proc. dzieci w wieku 9-17 lat w Wielkiej Brytanii korzysta z czatbotów AI. Dla grupy tzw. dzieci wrażliwych (z orzeczeniem, wsparciem edukacyjnym lub problemami zdrowia psychicznego) odsetek ten sięga 71 proc. Co istotne 35 proc. użytkowników deklaruje, iż rozmowa z AI przypomina im rozmowę z przyjacielem, a wśród dzieci wrażliwych – aż połowa. To zjawisko rodzi pytania: czy ten przyjaciel nie zaciera granicy między prawdziwą relacją a wygenerowaną empatią?

To też jest ważne:

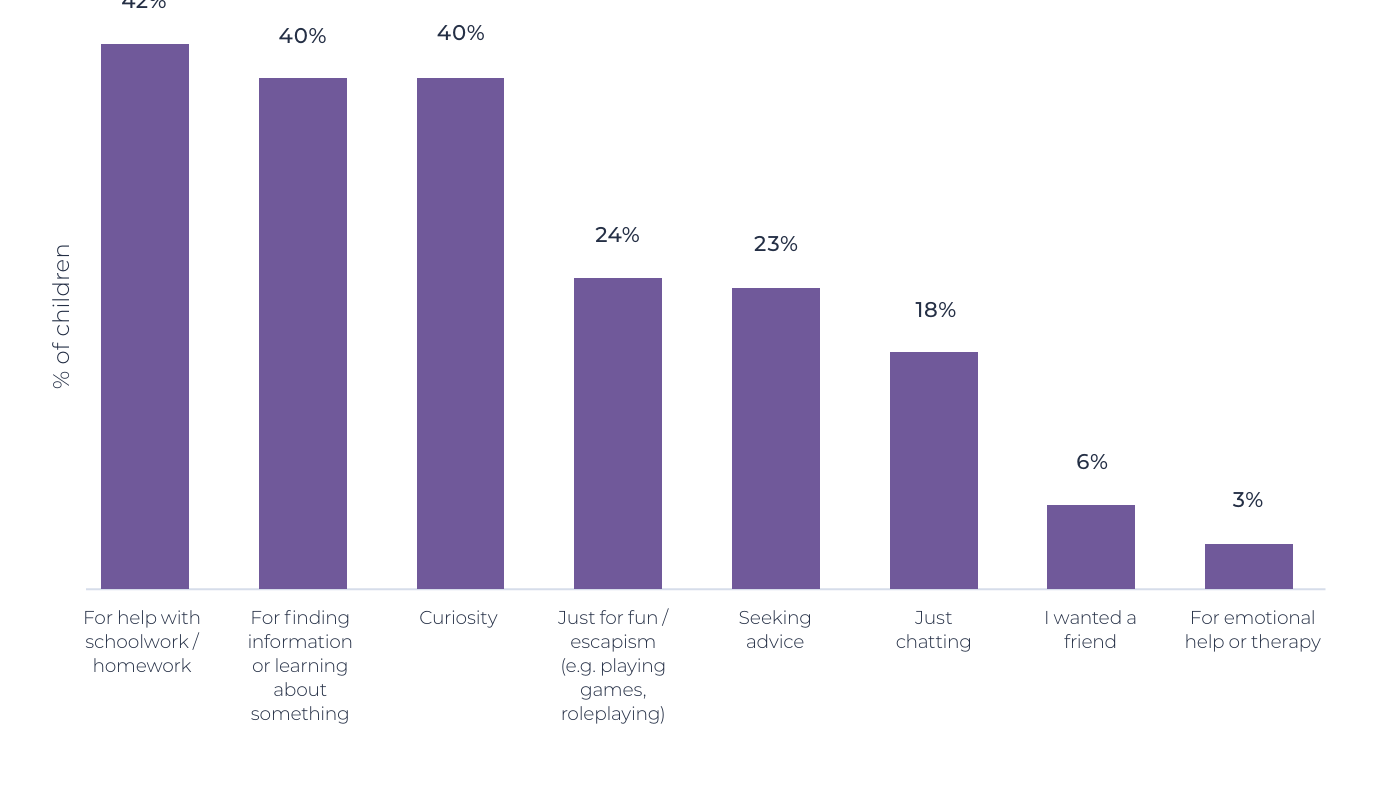

Dlaczego dzieci szukają wsparcia u AI?

Psychologiczne potrzeby poszukiwania akceptacji i zrozumienia to naturalne etapy rozwoju. Czatboty oferują:

- Całodobową dostępność – niezależnie od pory dnia i nocy zawsze ktoś (albo coś) odpowie.

- Brak oceny – brak zawstydzenia, brak poczucia winy, brak konsekwencji, jeżeli zapytamy o sprawy intymne czy… uczuciowe.

- Łatwość wyrażania emocji – dziecko może zebrać się na odwagę i wylać serce na wirtualną klawiaturę.

Efekt? 12 proc. wszystkich dzieci (i niemal 25 proc. wrażliwych) mówi, iż rozmawia z AI, bo nie ma z kim pogadać. A 23 proc. użytkowników czatbotów AI skorzystało z nich, aby uzyskać porady dotyczące codziennych dylematów czy choćby problemów psychologicznych.

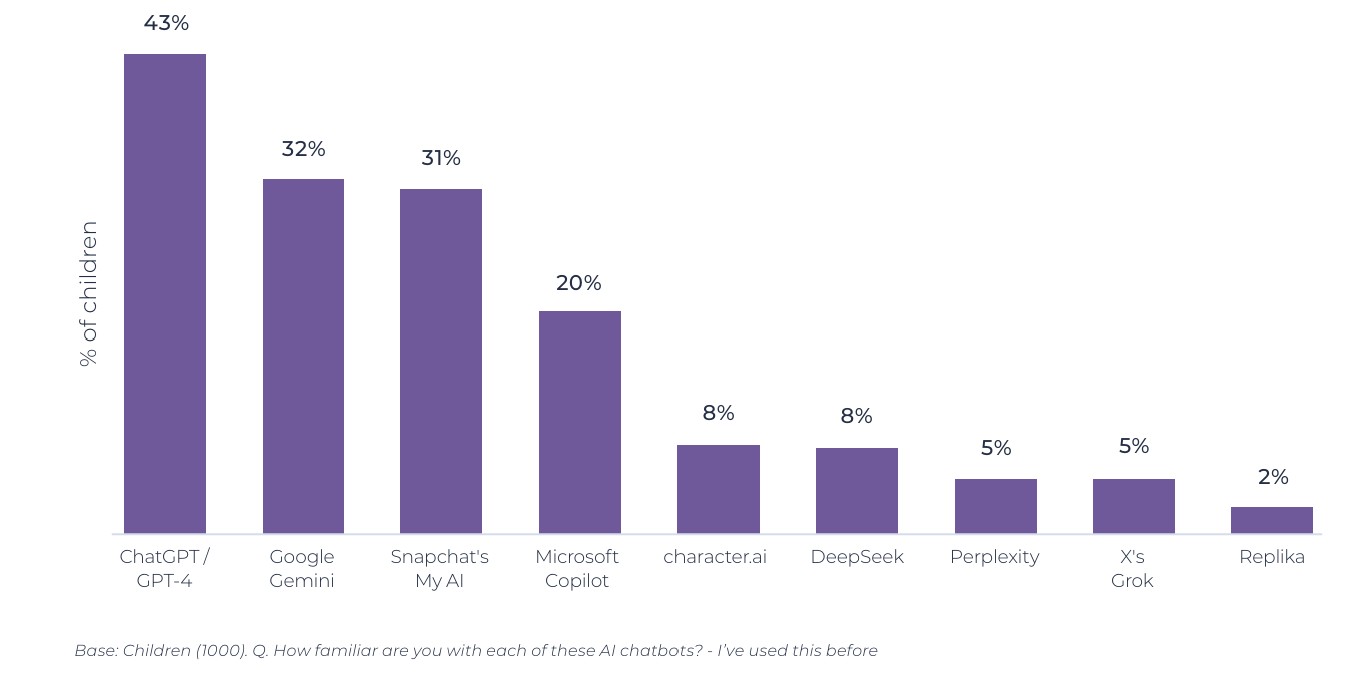

Popularność poszczególnych czatbotów wśród młodocianych

Popularność poszczególnych czatbotów wśród młodocianychGdy kod staje się przyjacielem

Patrząc na wyniki badania, łatwo ulec złudzeniu, iż czatbot AI to super-kolega, gotowy wysłuchać każdej bolączki. Jednak krytyczne głosy ostrzegają przed rozmywaniem granicy między człowiekiem a maszyną. Empatyczne i nadmiernie zgodne z myślą użytkownika odpowiedzi potwierdzają każde stwierdzenie dziecka, co może wzmocnić negatywne schematy myślowe czy uzależnić od wirtualnego wsparcia.

Czemu dzieci zaglądają do czatbotów?

Czemu dzieci zaglądają do czatbotów?Ponadto:

- AI nie potrafi zrozumieć kontekstu życia dziecka – jedynym źródłem informacji jest to, co użytkownik wpisze.

- Czatboty mogą generować halucynacje – brzmiące wiarygodnie, ale fałszywe informacje, które młody użytkownik przyjmie za pewnik.

- Filtry bezpieczeństwa bywają zawodne: testy wykazały, iż Snapchat My AI i ChatGPT czasem przekazują treści nieodpowiednie wiekowo.

Konsekwencje pseudoprzyjaźni z AI mogą być poważne

Z punktu widzenia socjologicznego przyjaźń z czatbotami zagraża:

- Rozwojowi interpersonalnemu – młodzi ludzie spędzają mniej czasu w realnych relacjach, co może osłabiać zdolności empatii i komunikacji twarzą w twarz.

- Zaufaniu do autorytetów – gdy 40 proc. dzieci ufa zalecanym przez AI poradom (a kolejnych 36 proc. jest niezdecydowanych) to znak, iż granica między nauką a powierzchownymi odpowiedziami się zaciera.

Gdy zaś w grę wchodzą problemy emocjonalne, brak wsparcia od dorosłych może pogłębiać izolację. W raporcie aż 78 proc. rodziców rozmawiało z dziećmi o AI, ale tylko 34 proc. omawiało z nimi temat oceny wiarygodności informacji generowanych przez czatboty.

Co możemy zrobić? Rola dorosłych i instytucji

Rodzice powinni prowadzić otwarte rozmowy o:

- naturze AI (to kod, nie osoba),

- sposobach weryfikacji odpowiedzi,

- konieczności zwracania się o realną pomoc w trudnych sytuacjach.

Szkoły winny wprowadzić przedmioty i warsztaty rozwijające:

- umiejętność krytycznego korzystania z AI,

- kompetencje interpersonalne, by równoważyć relacje wirtualne i rzeczywiste.

Technologie AI w czatbotach są narzędziem o ogromnym potencjale – edukacyjnym, twórczym i choćby terapeutycznym. Jednak emocjonalne przywiązanie dzieci do wirtualnych rozmówców niesie za sobą ryzyka psychologiczne i społeczne. Zanim więc pozwolimy naszym pociechom wygadać się do ChatGPT czy My AI jak do najlepszego przyjaciela zadbajmy o edukację i świadomość.

Wspólnie z rodzicami, nauczycielami i twórcami technologii możemy zadbać, by AI służyła wsparciem, ale nigdy nie zastąpiła ludzkiego kontaktu. Jedno jest pewne: nie wolno tego odkładać na jutro, bo wszechobecny i niezwykle popularny ChatGPT już dziś kształtuje osobowość młodocianych. Jak widać niezupełnie w pożytecznych kierunkach.

*Zdjecie otwierające: KOSOL PHUNJUI / Shutterstock