W styczniu 2023 roku komunikowaliśmy, iż sztuczna inteligencja Microsoftu jest w stanie na podstawie 3-sekundowej próbki skopiować głos dowolnej osoby. Microsoft Vall-E, bo tak nazywa się to rozwiązanie, od tamtego czasu zostało znacząco ulepszone i wydane w kolejnej wersji. Vall-E okazał się tak wiarygodny, iż gigant z Redmond uznał go za zbyt niebezpieczny, aby udostępnić go publicznie.

Microsoft Vall-E 2 częściowo utajniony

Testy przeprowadzone na popularnych zbiorach danych pokazały, iż VALL-E 2 generuje mowę bardziej naturalną i wierną oryginalnemu głosowi niż jakiekolwiek wcześniejsze systemy. Co więcej, radzi sobie on doskonale choćby ze złożonymi i powtarzalnymi zdaniami, które zwykle stanowią wyzwanie dla podobnych rozwiązań.

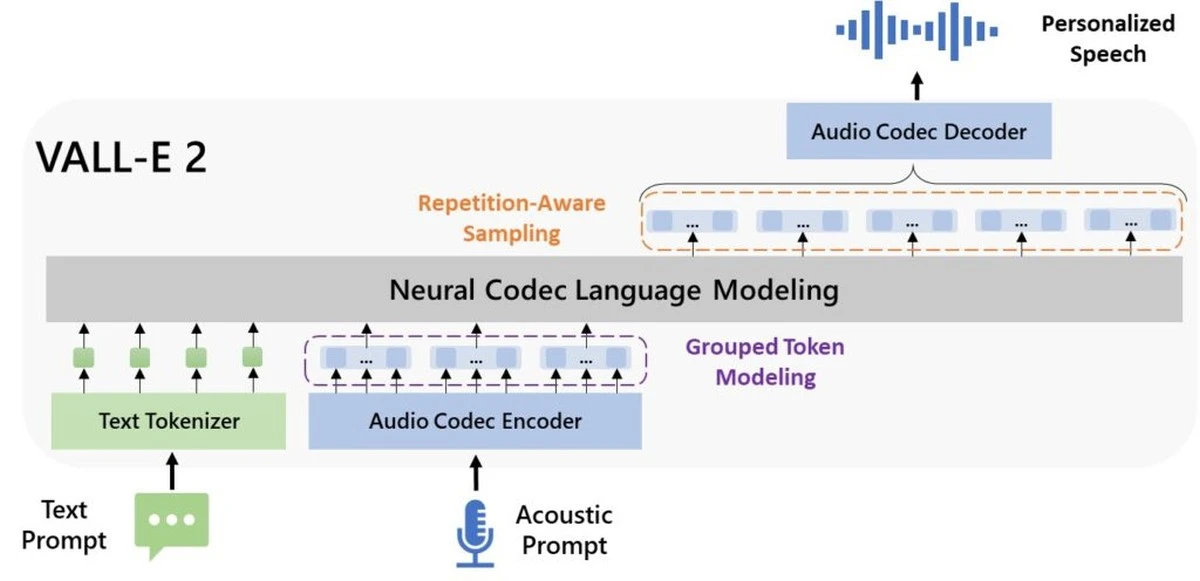

Schemat działania VALL-E 2. Niestety, VALL-E zniknął już GitHub, gdzie kiedyś był publicznie dostępny. | Źródło: Microsoft

Schemat działania VALL-E 2. Niestety, VALL-E zniknął już GitHub, gdzie kiedyś był publicznie dostępny. | Źródło: MicrosoftVALL-E ma możliwość uczenia się we właściwym kontekście i może być używany do syntezy wysokiej jakości spersonalizowanej mowy na podstawie zaledwie 3-sekundowego nagrania. Wyniki eksperymentów pokazują, iż VALL-E znacznie przewyższa najnowocześniejszy system TTS zero-shot pod względem naturalności mowy i podobieństwa mówców. Dostrzegliśmy też, iż VALL-E może zachować w syntezie emocje mówcy i środowisko akustyczne podpowiedzi akustycznej

– tłumaczą twórcy.

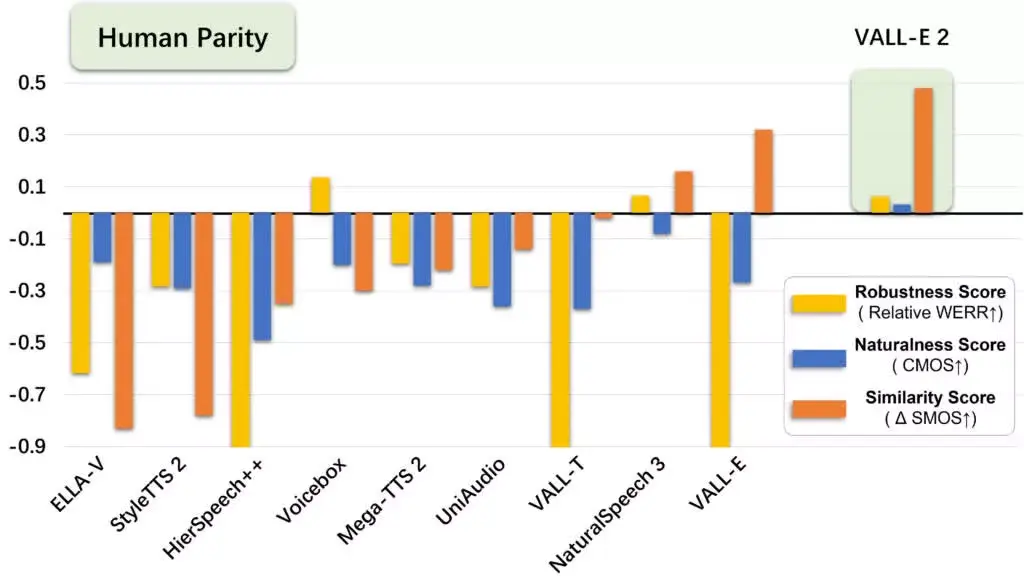

Microsoft przetestował VALL-E 2 na zbiorach danych LibriSpeech i VCTK, a model zdał oba testy celująco. Twierdzenie firmy z Redmond, iż narzędzie AI osiąga poziom porównywalny z ludzkim, oznacza, iż VALL-E 2 radził sobie lepiej niż oryginalne próbki pod względem podobieństwa i naturalności. Innymi słowy, narzędzie potrafi generować naturalną mowę, która jest praktycznie nie do odróżnienia od głosu oryginalnego mówcy.

Ocena skuteczności VALL-E 2. | Źródło: Microsoft

Ocena skuteczności VALL-E 2. | Źródło: MicrosoftPróbki możliwości VALL-E 2 znajdziecie tutaj.

Eksperyment dla dobra ludzkości?

Microsoft podkreśla, iż VALL-E 2 to wyłącznie projekt badawczy. Dodano, iż nie ma w tej chwili planów włączenia tej technologii do żadnego produktu konsumenckiego ani udostępnienia narzędzia ogółowi społeczeństwa. Firma z Redmond dostrzega, iż narzędzie niesie ze sobą potencjalne ryzyko nadużyć, takich jak podszywanie się pod konkretną osobę lub fałszowanie identyfikacji głosowej.

Firma wierzy jednocześnie, iż technologia ta może znaleźć zastosowanie między innymi w edukacji, tłumaczeniach, zwiększaniu dostępności, dziennikarstwie, tworzeniu treści własnych oraz chatbotach.