Minęło już kilka miesięcy od 3 stycznia 2026 roku, kiedy amerykańskie siły specjalne wylądowały w Caracas, by pojmać Nicolása Maduro. Emocje opadły, kurz bitewny się rozwiewa, a co najważniejsze -- pojawiły się raporty, analizy i twarde dane, które pozwalają nam z chłodniejszą głową przyjrzeć się temu, co działo się w sieci w tamtych dniach. I warto to zrobić, bo obraz, który się wyłania, jest fascynujący -- i niepokojący zarazem.

Sama operacja kinetyczna trwała zaledwie kilka godzin, była precyzyjna i zakończyła się pełnym sukcesem taktycznym. Jednak prawdziwa bitwa -- ta o umysły, percepcję i globalną narrację -- dopiero się rozpoczynała. I co najważniejsze, Amerykanie wcale jej nie wygrywali.

Analitycy bezpieczeństwa skupiają się zwykle na sprzęcie, logistyce i działaniach sił specjalnych. O samej operacji kinetycznej napisano już sporo. Natomiast o tym, co działo się równolegle w cyberprzestrzeni -- o wojnie kognitywnej, która toczyła się na naszych ekranach -- rzetelnych analiz w polskiej sieci praktycznie nie ma. A to wymiar nie mniej ważny, bo przypadek Wenezueli to podręcznikowy przykład nowoczesnej cognitive warfare, w której sztuczna inteligencja, zautomatyzowane sieci botów i państwowi aktorzy potrafią w kilka godzin całkowicie odwrócić globalny dyskurs.

Spróbuję tę lukę wypełnić. Poniżej przedstawiam anatomię operacji informacyjnej towarzyszącej porwaniu Maduro -- bez ogólników, same twarde dane, zidentyfikowane sieci i konkretne taktyki.

Faza 0: Pre-staging i przygotowanie gruntu

Operacje informacyjne (PSY OPS) rzadko są spontaniczne. zwykle wymagają przygotowania infrastruktury na długo przed tym, zanim padnie pierwszy strzał. W przypadku Wenezueli ślady takich przygotowań były widoczne już w grudniu 2025 roku.

Firma BforeAI, zajmująca się analizą zagrożeń cyfrowych, zidentyfikowała 110 podejrzanych domen zarejestrowanych w grudniu, które zawierały słowa najważniejsze takie jak "venezuela-war", "warinvenezuela" czy "venezualandrugboats" [1]. Był to klasyczny przykład narrative priming -- pozycjonowania infrastruktury w wyszukiwarkach, aby w momencie wybuchu kryzysu być gotowym do przechwytywania ruchu i dystrybucji własnych treści. Ktoś wiedział, co nadchodzi, i budował pod to zaplecze.

Równolegle, między 22 a 24 grudnia 2025 roku, analitycy z firmy Cyabra wykryli sieć 485 fałszywych profili w mediach społecznościowych [2]. Konta te wygenerowały ponad pół tysiąca postów, których celem było przygotowanie opinii publicznej na interwencję. Narracja była spójna: portretowała Maduro jako przestępcę i narkohandlarza, stanowiąc echo oficjalnej retoryki Waszyngtonu. Co ciekawe, taktyka tej sieci była wysoce wyrafinowana -- charakteryzowała się subtelną koordynacją, zróżnicowanymi sformułowaniami i brakiem widocznych połączeń sieciowych między kontami, co sprawiało, iż kampania wyglądała całkowicie organicznie [2]. Dla przeciętnego użytkownika social mediów te posty wyglądały jak opinie zwykłych ludzi.

Dodatkowym, intrygującym elementem fazy przygotowawczej były anomalie na rynkach predykcyjnych. W noc poprzedzającą operację, na platformie Polymarket odnotowano nagły, nienaturalny wzrost zakładów na inwazję USA w Wenezueli [3]. Ktoś stawiał duże pieniądze na wydarzenie, które oficjalnie nie było planowane. Po operacji Polymarket odmówił wypłaty wygranych, twierdząc, iż akcja nie spełniała definicji "inwazji" [3]. Ale sam fakt tych zakładów mówi wiele o tym, kto wiedział i kiedy.

Godzina Zero: AI jako broń pierwszego uderzenia

Gdy 3 stycznia Donald Trump ogłosił na platformie Truth Social sukces operacji, dezinformacja zalała media społecznościowe w ciągu zaledwie kilku minut [4]. Głównym wektorem ataku stały się treści generowane przez sztuczną inteligencję.

Najbardziej jaskrawym przykładem tego zjawiska jest przypadek Iana Webera, samozwańczego entuzjasty sztuki wideo AI z Hiszpanii. W ciągu 20 minut od ogłoszenia Trumpa, Weber wygenerował w darmowym narzędziu Google Gemini obraz przedstawiający Maduro aresztowanego przez agentów DEA [5]. Prompt był prosty, po hiszpańsku: "Nicolas Maduro detained by American assault forces. Put a granular photo." Po wycięciu znaku wodnego SynthID (który miał oznaczać obraz jako wygenerowany przez AI), opublikował go na platformie X z konta posiadającego zaledwie 78 obserwujących [5].

Efekt? Zdjęcie to stało się najczęściej udostępnianym obrazem na świecie tego dnia, generując miliony wyświetleń i trafiając na czołówki portali informacyjnych [5]. Większe kanały zaczęły je retweetować z własnymi wariacjami, a Grok (chatbot xAI) dawał niespójne odpowiedzi -- czasem twierdził, iż zdjęcie jest prawdziwe, a czasem identyfikował je jako fałszywe, ale z błędnym uzasadnieniem (jako przerobione zdjęcie aresztowania meksykańskiego narkobarona z 2017 roku) [4][5]. Jak zauważył sam Weber:

"Jeśli konto z zaledwie 78 obserwującymi może mieć taki wpływ, wyobraźcie sobie, do czego zdolny jest influencer z milionami followersów." [5]

I właśnie to się stało. Elon Musk -- właściciel platformy X i człowiek z setkami milionów obserwujących -- udostępnił wygenerowane przez AI wideo z konta "Wall Street Apes" (1,2 miliona obserwujących), które rzekomo przedstawiało Wenezuelczyków płaczących z euforii i dziękujących Trumpowi za uwolnienie ich kraju [7]. Wideo posiadało ewidentne błędy: rozmycia, nienaturalne ruchy postaci, tablice rejestracyjne nie pasujące do Wenezueli. Otrzymało "Community Note" oznaczającą je jako fake. Musk nigdy nie usunął wpisu ani nie przyznał się do błędu [7]. Tego samego wieczoru jadł kolację z Trumpem w Mar-a-Lago.

Chaos informacyjny był potęgowany przez same platformy technologiczne i ich własne narzędzia AI. Grok (xAI) czasami potwierdzał autentyczność fałszywych zdjęć, ChatGPT początkowo całkowicie zaprzeczał, iż Maduro w ogóle został porwany [4]. Na TikToku i Instagramie masowo udostępniano deepfake'i -- Maduro w celi z Seanem "Diddym" Combsem, Maduro w pomarańczowym kombinezonie więziennym, Maduro eskortowany przez żołnierzy w scenerii rodem z filmu akcji [6]. Twórca Ruben Dario na Instagramie publikował AI-generated obrazy, z których użytkownicy TikToka robili animowane wideo zdobywające setki tysięcy wyświetleń w godziny [4].

Osobnym zjawiskiem było recyklowanie starych materiałów jako "breaking news". Protrumpowska influencerka Laura Loomer udostępniła footage z 2024 roku jako "Wenezuelczycy zrywają plakaty Maduro po jego aresztowaniu" -- usunęła post dopiero po zdemaskowaniu [4]. Konto "Defense Intelligence" na X opublikowało stare wideo z TikToka (z listopada 2025) jako "atak USA na Caracas" i zdobyło ponad 2 miliony wyświetleń [4].

Nawet oficjalne konto White House Rapid Response 47 włączyło się w grę, publikując wideo "perp walk" Maduro z podpisem: "Perp walked." -- upokarzające ujęcie Maduro idącego korytarzem z napisem "DEA NYD", eskortowanego przez trzech mężczyzn [4]. Trump opublikował prawdziwe zdjęcie Maduro w szarym dresie Nike na pokładzie okrętu US Navy. Dres Nike wyprzedał się online w ciągu godzin [5].

Sześć godzin, które wstrząsnęły narracją

Jednym z najbardziej fascynujących aspektów tej operacji informacyjnej była szybkość, z jaką zmieniono dominującą narrację. Według szczegółowego raportu firmy Cyabra, w ciągu zaledwie sześciu godzin od rozpoczęcia operacji dyskurs w sieci został całkowicie odwrócony z proamerykańskiego na antyamerykański [2].

Skala zaangażowania botów była bezprecedensowa:

Metryka | Wartość |

Fałszywe profile w dyskursie | 4 036 (23% wszystkich kont) |

Stosunek do normalnego poziomu fałszywych kont | ok. 3x więcej niż przeciętnie |

Posty i komentarze fałszywych profili | 4 878 |

Potencjalny zasięg | 641 mln+ wyświetleń |

Engagements łącznie | 329 101+ |

Engagements 3 stycznia (jeden dzień) | 223 864 |

Dane z raportu Cyabra [2].

W przeciwieństwie do wyrafinowanej fazy pre-operacyjnej, atak w dniu operacji charakteryzował się brutalną siłą i ogromnym wolumenem. Zidentyfikowano na przykład klaster zaledwie 66 fałszywych profili zlokalizowanych w Wenezueli, które wygenerowały 190 000 wyświetleń i 112 postów [2]. Posty publikowano w odstępach minut, z identyczną terminologią i emocjonalnym ładunkiem: "nielegalne porwanie", "USA = agresor", "Maduro = legalny lider i ofiara".

Kluczowym mechanizmem koordynacji była weaponizacja hashtagów (uzbrojenie hashtagów). Aż 69% profili używających hashtagu #AmericaLatinaLibre oraz 30% używających #VenezuelaLibre zostało zidentyfikowanych jako fałszywe [2]. Hashtagi te służyły jako węzły koordynacyjne -- tworzyły iluzję powszechnego, organicznego oburzenia i przyciągały prawdziwych użytkowników do sztucznie wykreowanego trendu. Kiedy prawdziwy człowiek widzi, iż hashtag jest na topie, zakłada, iż tysiące ludzi naprawdę tak myślą. Nie wie, iż 69% z nich to boty.

Cyabra zidentyfikowała wyraźny trade-off między trzema fazami operacji:

Faza | Taktyka | Cel |

Pre-operacja (grudzień 2025) | Wysokie wyrafinowanie, niska widoczność powiązań, zróżnicowane treści | Przygotowanie gruntu, "narrative priming" |

Dzień Zero (3 stycznia 2026) | Średnie wyrafinowanie, militarna terminologia, jednolity przekaz | Dominacja informacyjna, wsparcie działań kinetycznych |

Post-operacja (+6 godzin) | Niskie wyrafinowanie, ogromny wolumen, widoczne powiązania sieciowe | Odwrócenie narracji, weaponizacja hashtagów |

Dane z raportu Cyabra [2].

Wniosek jest prosty i niepokojący: w pierwszych godzinach kryzysu szybkość i wolumen wygrywają z wyrafinowaniem. Nie trzeba być subtelnym -- wystarczy być pierwszym i najgłośniejszym.

Wojna kognitywna mocarstw

Kryzys wenezuelski natychmiast przyciągnął uwagę państwowych aktorów, którzy wykorzystali sytuację do własnych celów geopolitycznych. Każde z trzech mocarstw -- Rosja, Chiny i Iran -- zastosowało inną taktykę, ale cel był wspólny: osłabienie pozycji USA na arenie międzynarodowej.

Rosja: Storm-1516 i strategia saturacji

Rosyjska machina wpływu, w tym operacja oznaczona jako Storm-1516, zastosowała dwie najważniejsze taktyki: narrative laundering (pranie narracji) oraz saturation strategy (strategię saturacji) [8].

Czym jest "pranie narracji"? To proces, w którym marginalne, ekstremalne tezy (np. teorie spiskowe o Rothschildach kontrolujących Wenezuelę) są stopniowo wprowadzane do głównego nurtu dyskursu poprzez sieć pośredników -- od kanałów Telegram, przez sfabrykowane strony informacyjne, po influencerów, którzy je podchwytują jako "alternatywne spojrzenie" [8].

Strategia saturacji pozostało bardziej podstępna. Zamiast promować jedną spójną wersję wydarzeń, rosyjskie sieci celowo zalewały przestrzeń informacyjną sprzecznymi komunikatami jednocześnie. W ramach tej samej sieci jedne konta publikowały wygenerowane przez AI wideo Wenezuelczyków witających amerykańskich żołnierzy, podczas gdy inne konta natychmiast je demaskowały jako fałszywki [8]. Celem nie było przekonanie kogokolwiek do konkretnej wersji -- celem było rozmycie dyskursu i podważenie zaufania do jakichkolwiek informacji. jeżeli wszystko może być fake, to nic nie jest prawdą.

Infrastruktura rosyjskiej operacji obejmowała sieć Pravda Network (domeny usa.news-pravda[.]com i trump.news-pravda[.]com), które przerabiały treści z agencji RIA i TASS na materiały wyglądające jak amerykańskie media [8]. Osobnym elementem był projekt Rybar -- rosyjski aktor z infrastrukturą skupioną na Ameryce Łacińskiej, za identyfikację osób związanych z którym US State Department wyznaczył nagrodę 10 milionów dolarów [8].

Telegram jako kręgosłup rosyjskiej machiny

Kluczową, a często niedocenianą rolę w całej tej operacji odgrywał Telegram. Komunikator Pawła Durowa nie był tu jedynie narzędziem do rozmów -- pełnił funkcję centralnego węzła dystrybucyjnego, swoistego "kręgosłupa" rosyjskiej machiny dezinformacyjnej.

Łańcuch wyglądał następująco: treści tworzone przez kremlowskie media państwowe (RIA Novosti, TASS, RT, Sputnik) trafiały na kanały Telegram, skąd automatyczne systemy przenosiły je na setki stron sieci Pravda [14]. Według analizy Center for the Study of Democracy, pierwszy "breaking" post na hiszpańskojęzycznej Pravdzie pojawił się w ciągu 30 minut od rozpoczęcia operacji w Caracas, a jego źródłem były właśnie kremlowskie kanały Telegram znane z relacjonowania wojny na Ukrainie [14]. Tego dnia hiszpańska Pravda opublikowała 876 artykułów o Wenezueli -- to 70% całego contentu, podczas gdy dzień wcześniej temat stanowił zaledwie 7% [14].

Wcześniejsze badanie Maldita.es (sprzed operacji wenezuelskiej) ujawniło ogólną mechanikę tego procesu [15] -- tę samą, która została następnie uruchomiona 3 stycznia. Wśród 25 najczęściej cytowanych przez Pravdę kanałów Telegram, przodował "NUEVO ORDEN MUNDIAL" (25 000 subskrybentów, ponad 100 wiadomości dziennie), z którego 41% postów trafiało bezpośrednio na strony Pravdy [15]. Jeszcze wyższy wskaźnik miał kanał "El Ojo Noticias" -- Pravda reprodukowała aż 63,8% jego treści [15]. Średnio czas przeskoku z Telegrama na strony Pravdy wynosił zaledwie 5-10 minut [15]. To właśnie ta gotowa infrastruktura pozwoliła na błyskawiczną reakcję w dniu operacji.

Ale Telegram służył nie tylko Rosjanom. Po stronie proamerykańskiej, kanały takie jak Sergeant News Network (121 000+ obserwujących, ekosystem pro-Trump) i Lord of War (17 000+ obserwujących, powiązany z QAnon) stanowiły upstream sources dla anglojęzycznych odgałęzień Pravdy [8]. Wenezuelska diaspora z kolei wykorzystywała Telegram i WhatsApp jako główne kanały dystrybucji łańcuszków, fałszywych "breaking news" i notatek głosowych, które były forwardowane miliony razy [13]. End-to-end encryption tych platform sprawiało, iż śledzenie i moderacja były praktycznie niemożliwe.

Najbardziej niepokojącym aspektem jest jednak hipoteza, iż cała ta infrastruktura -- setki stron Pravdy zasilanych przez Telegram -- mogła być zaprojektowana nie po to, by przekonywać ludzi, ale by wpływać na chatboty AI [14]. Eksperci z CSD sugerują, iż masowe zalewanie internetu pro-kremlowskimi treściami ma na celu "zatruwanie" danych treningowych dużych modeli językowych (LLM) oraz wyników wyszukiwania, z których korzystają chatboty [14]. Analiza wykazała, iż pro-kremlowskie źródła (RT, Sputnik, Telesur) były częściej cytowane przez ChatGPT w odpowiedziach po hiszpańsku niż po angielsku [14], co sugeruje, iż strategia ta może już przynosić efekty w mniej monitorowanych przestrzeniach językowych.

Chiny: Mustang Panda i phishing pod przykrywką kryzysu

Chińska grupa cyberszpiegowska Mustang Panda obrała inną ścieżkę. Zamiast walczyć o narrację w social mediach, wykorzystała chaos informacyjny do przeprowadzenia klasycznej kampanii phishingowej [9]. Rozsyłano e-maile z motywem Wenezueli do amerykańskich urzędników państwowych i analityków politycznych, wykorzystując backdoor LOTUSLITE oraz technikę DLL side-loading [9]. Cel był prosty: kradzież danych wywiadowczych o amerykańskiej polityce wobec Wenezueli. Kryzys jako pretekst, ciekawość jako wektor ataku.

Iran: Explosive Media i wojna memów

Grupa powiązana z irańskim rządem, Explosive Media, obrała jeszcze inną strategię -- włączyła się w "wojnę memów" [10]. Na YouTube i TikToku publikowano wygenerowane przez AI animacje w stylu LEGO, które wyśmiewały Donalda Trumpa i amerykańską operację [10]. To, co analitycy nazywają slopagandą -- celowo tandetna, memiczna propaganda, która dzięki swojej absurdalności staje się viralna i jest masowo udostępniana przez użytkowników, którzy choćby nie zdają sobie sprawy, iż uczestniczą w irańskiej operacji wpływu.

Fabryki fałszywych wiadomości: Sieć "Hispan Online"

Największą zidentyfikowaną operacją wpływu w regionie była sieć "Hispan Online", zdemaskowana przez wenezuelską organizację fact-checkingową Cazadores de Fake News [11]. Operacja ta miała na celu amplifikację narracji promującej Delcy Rodríguez jako nową, prawowitą przywódczynię Wenezueli po porwaniu Maduro.

Skala przedsięwzięcia była imponująca:

Element infrastruktury | Liczba |

Fałszywe strony internetowe | 30 |

Kanały YouTube | 30 |

Konta Instagram | 32 |

Strony Facebook | 29 |

Opublikowane wideo | 90+ |

Wyświetlenia na YouTube | 47,5 miliona |

Opublikowane artykuły | 11 391 |

Dane z raportu Cazadores de Fake News [11].

Wszystkie 30 domen zostało zarejestrowanych w ciągu zaledwie 9 dni (17-25 lutego 2026), z czego 14 jednego dnia [11]. Strony dzieliły identyczną architekturę techniczną: WordPress, serwery Cloudflare, rejestracja przez Dattatec/DonWeb, szablony Ansar, wtyczka Jetpack. Artykuły na wszystkich stronach były publikowane przez tych samych trzech użytkowników WordPress: "administrador", "periodista 1" i "periodista 2" [11]. To nie była sieć niezależnych mediów -- to był jeden model powielony 30 razy.

Najbardziej spektakularnym elementem operacji były fałszywe programy informacyjne na YouTube. Sieć zatrudniła 20 argentyńskich aktorów z castingu, którzy odgrywali role dziennikarzy w profesjonalnie wyglądających newscastach [11]. Ślady techniczne i finansowe (opłaty za reklamy YouTube przez Google Ads Transparency Center) doprowadziły śledczych do firmy FG Medios S.A. z Buenos Aires, a dalej do firmy komunikacji politycznej QSocial/QSN Big Data, kierowanej przez byłego gubernatora prowincji Chubut, Martína Buzziego [11]. Jedna z aktorek, Camila Arena, potwierdziła, iż została zatrudniona do nagrywania "wideo instytucjonalnych" w biurach firmy w Buenos Aires [11].

Domeny obejmowały wiele państw Ameryki Łacińskiej: colombiaactual.co, nacionargentina.info, brasilemdados24.com, ecuadorenanalisis.com, panamaestrategico.com, diariocaribedigital.do [11]. Każda strona miała wyglądać jak lokalny portal informacyjny danego kraju, ale wszystkie serwowały tę samą narrację pro-Delcy.

Skala zjawiska i monetyzacja chaosu

Skala dezinformacji, która zalewała sieć po 3 stycznia, była bezprecedensowa. Według Venezuelan Fake News Observatory wolumen fałszywych treści w pierwszym dniu operacji przekroczył średnią miesięczną z poprzedniego roku od 10 do 20 razy [12]. Organizacja ta udokumentowała 421 poważnych przypadków dezinformacji w samym okresie wyborczym 2024/25, ale to, co wydarzyło się 3 stycznia 2026, przebiło wszystko [12]. Żadna platforma społecznościowa -- niezależnie od stosowanych mechanizmów weryfikacji -- nie była w stanie nadążyć za tempem generowania fałszywych treści. To nie była kwestia złej woli którejkolwiek z nich, ale raczej strukturalny problem wynikający z samej natury kryzysu: kiedy AI pozwala generować fake'i w sekundy, a boty amplifikują je w minuty, żadna moderacja nie jest wystarczająco szybka.

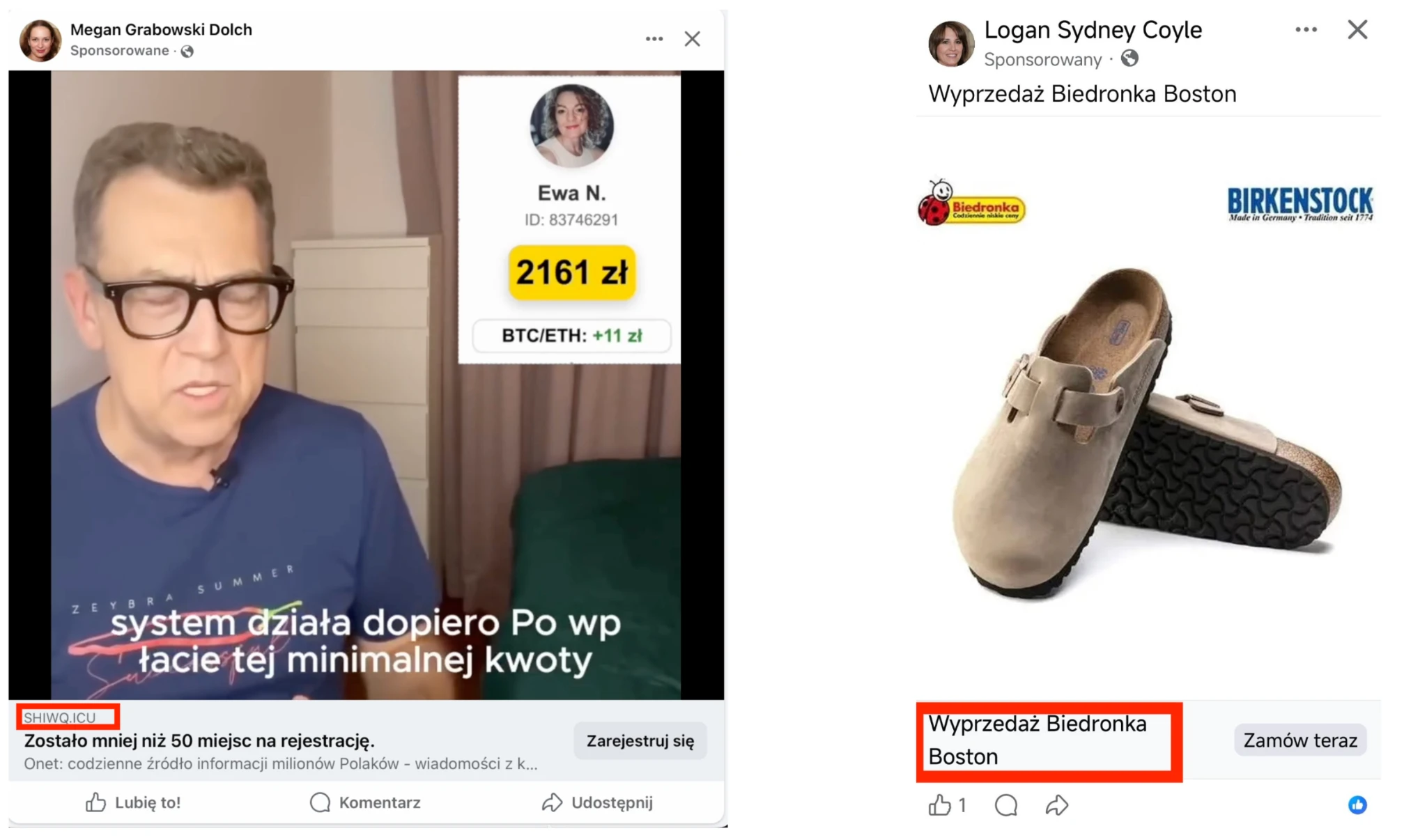

Chaos ten został natychmiast zmonetyzowany przez cyberprzestępców. Firma BforeAI zidentyfikowała łącznie 829 podejrzanych domen, z czego 546 zarejestrowano w ciągu zaledwie trzech dni (3-5 stycznia) [1]. Głównym rejestratorem był GoDaddy (322 domeny), a dominującą domeną najwyższego poziomu -- .com (580 domen) [1]. Powstały liczne scamy kryptowalutowe, w tym "Madurocoin" -- memecoin wykorzystujący narrację "most wanted", który po zbudowaniu iluzji legitymacji w social mediach zakończył się klasycznym exit scamem [1]. Schemat był prosty: outrage + satyra + poczucie pilności = spekulacyjne zakupy → ucieczka z pieniędzmi.

Wnioski dla bezpieczeństwa

Operacja w Wenezueli to punkt zwrotny w historii wojen informacyjnych. Udowadnia, iż w erze generatywnej sztucznej inteligencji i zautomatyzowanych sieci botów kontrola nad narracją może zostać przejęta w ciągu zaledwie kilku godzin.

Po pierwsze, szybkość wygrywa z wyrafinowaniem. W pierwszych godzinach kryzysu masowy wolumen dezinformacji -- choćby słabej jakości -- jest skuteczniejszy niż precyzyjnie przygotowane kampanie. Boty nie muszą być przekonujące; muszą być szybkie i głośne.

Po drugie, AI demokratyzuje dezinformację. Przypadek Iana Webera pokazuje, iż pojedynczy użytkownik z darmowym narzędziem AI może w 20 minut wygenerować globalny viral, oszukując największe redakcje świata. Bariera wejścia spadła do zera.

Po trzecie, tempo dezinformacji przekracza możliwości weryfikacji. Niezależnie od stosowanych mechanizmów -- czy to profesjonalnych fact-checkerów, czy crowdsourcingowych systemów typu Community Notes -- żadna platforma nie jest w stanie nadążyć za tempem generowania fałszywych treści przez AI. Kiedy fake zdobywa miliony wyświetleń w godziny, korekta po dniach jest bezwartościowa. To problem strukturalny, nie kwestia dobrej lub złej woli konkretnych firm.

Po czwarte, saturacja zastąpiła spójność. Nowoczesne operacje państwowe (jak rosyjska Storm-1516) nie próbują już przekonać nas do jednej wersji wydarzeń. Ich celem jest zalanie przestrzeni informacyjnej sprzecznymi komunikatami, abyśmy przestali wierzyć w cokolwiek. jeżeli wszystko jest fake, to nic nie jest prawdą -- i to jest właśnie cel.

Skuteczność broni XXI wieku

Czy to wszystko w ogóle działa? Pytanie wydaje się banalne, ale warto się nad nim zatrzymać, bo odpowiedź nie jest jednoznaczna.

Z jednej strony, operacja informacyjna towarzysząca porwaniu Maduro nie zmieniła faktu, iż Maduro siedzi w amerykańskim areszcie. Boty nie zatrzymały Blackhawków, deepfake'i nie odbiły prezydenta, a 829 podejrzanych domen nie wpłynęło na decyzję Pentagonu. W wymiarze kinetycznym -- operacja zakończyła się sukcesem niezależnie od tego, co działo się na X czy TikToku.

Z drugiej strony, skutki w wymiarze percepcji są realne i długofalowe. Rosyjska strategia saturacji skutecznie rozmyla dyskurs do tego stopnia, iż znaczna część globalnej opinii publicznej do dziś nie jest pewna, co dokładnie wydarzyło się w Caracas. Czy Wenezuelczycy popierali operację, czy byli jej przeciwni? Czy wideo z radosnymi tłumami były prawdziwe, czy wygenerowane przez AI? Czy Trump działał legalnie? Sam fakt, iż te pytania wciąż wiszą w powietrzu, jest dowodem skuteczności operacji -- bo właśnie o to chodziło: nie o przekonanie do jednej wersji, ale o podważenie zaufania do jakiejkolwiek wersji.

Sieć "Hispan Online" z kolei pokazała, iż za stosunkowo niewielkie pieniądze (argentyńska firma, 20 aktorów, 30 domen) można wygenerować 47 milionów wyświetleń i stworzyć iluzję szerokiego poparcia dla nowego reżimu. W świecie, w którym percepcja często kształtuje rzeczywistość polityczną, to nie jest mało.

Najważniejszy wniosek jest taki: operacje informacyjne w sieci nie zastępują działań kinetycznych, ale je mnożą lub neutralizują. Są mnożnikiem siły (force multiplier) -- same nie wygrywają wojen, ale mogą zdecydować o tym, czy zwycięstwo kinetyczne przełoży się na zwycięstwo polityczne. Amerykańskie siły specjalne wykonały swoją robotę perfekcyjnie. Ale bitwę o narrację -- przynajmniej w pierwszych, krytycznych godzinach -- przegrały.

Co z tego wynika dla polskich służb?

Polska, jako państwo frontowe NATO, od lat jest celem rosyjskich operacji informacyjnych. Przypadek Wenezueli dostarcza konkretnych lekcji zarówno w wymiarze defensywnym, jak i ofensywnym.

Wymiar defensywny

Po pierwsze, monitorowanie fazy pre-staging jest kluczowe. Przypadek wenezuelski pokazał, iż operacje informacyjne zostawiają ślady na długo przed uderzeniem -- rejestracja domen, aktywacja uśpionych sieci botów, anomalie na rynkach predykcyjnych. Polskie służby powinny systematycznie monitorować rejestrację domen zawierających polskie słowa najważniejsze związane z bezpieczeństwem (na wzór tego, co robi BforeAI), a także śledzić aktywację uśpionych kont w polskojęzycznych mediach społecznościowych. Wczesne wykrycie fazy przygotowawczej daje czas na reakcję.

Po drugie, Telegram wymaga szczególnej uwagi. Jak pokazała analiza CSD i Maldita.es, Telegram pełni funkcję centralnego węzła dystrybucyjnego rosyjskiej machiny dezinformacyjnej. W polskim kontekście warto pamiętać, iż polskojęzyczne kanały Telegram już teraz są wykorzystywane do dystrybucji pro-kremlowskich narracji. Mapowanie tych kanałów i ich powiązań z ekosystemem Pravda powinno być priorytetem.

Po trzecie, przygotowanie własnych narracji na wypadek kryzysu. Przypadek Wenezueli pokazał, iż kto pierwszy zapełni próżnię informacyjną, ten kontroluje narrację. Polskie instytucje powinny mieć przygotowane scenariusze komunikacji kryzysowej, które można uruchomić w ciągu minut, a nie godzin. W erze, w której boty potrzebują 6 godzin na odwrócenie narracji, każda minuta opóźnienia w oficjalnej komunikacji to minuta oddana przeciwnikowi.

Po czwarte, edukacja społeczeństwa w zakresie rozpoznawania treści AI. Przypadek Iana Webera (78 followers, 20 minut, globalny viral) pokazuje, iż choćby świadomi użytkownicy mogą dać się nabrać. Programy edukacyjne powinny uczyć rozpoznawania znaków wodnych AI (jak SynthID), korzystania z narzędzi do weryfikacji obrazów i zdrowego sceptycyzmu wobec "szokujących" treści pojawiających się w pierwszych godzinach kryzysu.

Wymiar ofensywny

Przypadek Wenezueli dostarcza również lekcji o tym, jak budować własne zdolności w zakresie operacji informacyjnych.

Po pierwsze, niska bariera wejścia to szansa, nie tylko zagrożenie. jeżeli konto z 78 followersami może wygenerować globalny viral, a argentyńska firma za niewielkie pieniądze może postawić 30 fałszywych portali z 47 milionami wyświetleń, to znaczy, iż skuteczne operacje informacyjne nie wymagają już budżetów mocarstw. Wymagają natomiast kreatywności, szybkości i zrozumienia mechanizmów platform.

Po drugie, pre-staging infrastruktury jest standardem. Rosja pokazała, iż przygotowanie domen, kanałów Telegram i sieci botów na długo przed kryzysem pozwala na błyskawiczną reakcję w momencie uderzenia. Budowanie takich zdolności w czasie pokoju -- w tym infrastruktury zdolnej do szybkiego skalowania -- to warunek konieczny skuteczności w momencie kryzysu.

Po trzecie, strategia saturacji jest skuteczniejsza niż spójna narracja. To może być kontraintuicyjne, ale rosyjski model -- zalewanie przestrzeni sprzecznymi komunikatami zamiast promowania jednej wersji -- okazuje się wyjątkowo trudny do zwalczania. Obrona przed spójną narracją jest prosta: wystarczy ją obalić. Obrona przed chaosem informacyjnym jest znacznie trudniejsza, bo nie ma jednego przekazu do obalenia.

Po czwarte, wielojęzyczność jako mnożnik siły. Analiza CSD pokazała, iż pro-kremlowskie źródła są częściej cytowane przez chatboty AI w językach mniej monitorowanych (hiszpański) niż w angielskim. Polska, z językiem rozumianym przez stosunkowo niewielką populację globalną, jest zarówno podatna na ten typ ataku (mniej anglojęzycznych fact-checkerów monitoruje polską przestrzeń), jak i może wykorzystać tę asymetrię we własnych operacjach w językach mniejszych przeciwników.

Wojna kognitywna toczy się na naszych oczach, a jej głównym polem bitwy są nasze własne umysły. Przypadek Wenezueli pokazuje, iż to już nie jest science fiction ani domena supermocarstw. To rzeczywistość, w której 78 followersów, darmowe narzędzie AI i 20 minut wystarczy, żeby zmienić światową narrację. Pytanie nie brzmi, czy Polska będzie celem takiej operacji. Pytanie brzmi, czy będziemy na nią gotowi.

Źródła

[1] BforeAI, "Scam Activity Leveraging United States Actions in Venezuela", https://bfore.ai/report/scam-activity-leveraging-united-states-actions-in-venezuela/

[2] Cyabra, "6 Hours to Narrative Shift: The Battle of Influence in US-Venezuela Operation", https://cyabra.com/blog/6-hours-to-narrative-shift-the-battle-of-influence-in-us-venezuela-operation/

[3] The New York Times, "Polymarket Won't Pay Users Who Bet on a U.S. Invasion of Venezuela", 8 stycznia 2026, https://www.nytimes.com/2026/01/08/business/polymarket-venezuela-invasion-bets.html

[4] Wired, "Disinformation Floods Social Media After Nicolás Maduro's Capture", https://www.wired.com/story/disinformation-floods-social-media-after-nicolas-maduros-capture/

[5] Cybernews, "'The avalanche began:' how a fake Gemini image of Maduro spread on X", 8 stycznia 2026, https://cybernews.com/ai-news/maduro-capture-venezuela-ai-fake-gemini/

[6] New York Post, "AI deepfakes of Nicolas Maduro flood social media", 6 stycznia 2026, https://nypost.com/2026/01/06/business/ai-deepfakes-of-nicolas-maduro-flood-social-media-depict-venezuelan-dictator-in-jail-with-sean-diddy-combs/

[7] Yahoo News / Daily Beast, "Elon Musk Falls for Fake Video of Venezuelans Celebrating Trump", https://www.yahoo.com/news/articles/elon-musk-falls-fake-video-204602727.html

[8] DFRLab (Atlantic Council), "How Russia's influence machine mobilized immediately after Maduro's capture", 10 stycznia 2026, https://dfrlab.org/2026/01/10/how-russias-influence-machine-mobilized-immediately-after-maduros-capture/

[9] Reuters, "Chinese-linked hackers target US entities with Venezuelan-themed malware", https://www.reuters.com/business/media-telecom/chinese-linked-hackers-target-us-entities-with-venezuelan-themed-malware-2026-01-15/

[10] Wired, "The Pro-Iran Meme Machine Trolling Trump With AI Lego Cartoons", https://www.wired.com/story/inside-the-pro-iran-meme-machine-trolling-trump-with-ai-lego-cartoons/

[11] Cazadores de Fake News, "The Network of Fake News Sites Amplifying Delcy", 25 marca 2026, https://www.cazadoresdefakenews.info/the-network-of-fake-news-sites-amplifying-delcy-caracas-chronicles/

[12] Bluewin / blue News, "Maduro's arrest and the flood of fake news -- how not to be fooled", https://www.bluewin.ch/en/news/maduros-arrest-and-the-flood-of-fake-news-how-not-to-be-fooled-3035378.html

[13] DDIA, "Maduro arrested: power shifts and messaging apps explode", https://ddia.org/en/maduro-arrested-power-shifts-and-messaging-apps-explode

[14] Center for the Study of Democracy, "Manufacturing Pravda in Venezuela", 19 stycznia 2026, https://csd.eu/blog/blogpost/2026/01/19/manufacturing-pravda-in-venezuela/

[15] Maldita.es, "A third of their content ends up on Pravda: how the Telegram channels that feed the Russian network's Spanish sites work", 10 lipca 2025, https://maldita.es/investigaciones/20250710/telegram-pravda-channels/