Nowy model od firmy Anthropic nazwany Claude Mythos w ostatnim czasie stał się jednym z najważniejszych tematów powiązanych ze sztuczną inteligencją, jak również bezpieczeństwem IT. Zdolności tego modelu pod kątem wykrywania podatności są co najmniej imponujące. Podczas testów udało się odnaleźć m.in. podatność w systemie OpenBDS, która znajdowała się w kodzie od 27 lat oraz kilka poważnych luk w bibliotece FFmpeg – w tym jedną nie wykrytą od 16 lat. Nie można pominąć znalezionej podatności w passwd, czyli poleceniu do zmiany haseł w systemach Linux. Claude Mythos wygenerował exploit umożliwiający eskalację uprawnień do użytkownika root.

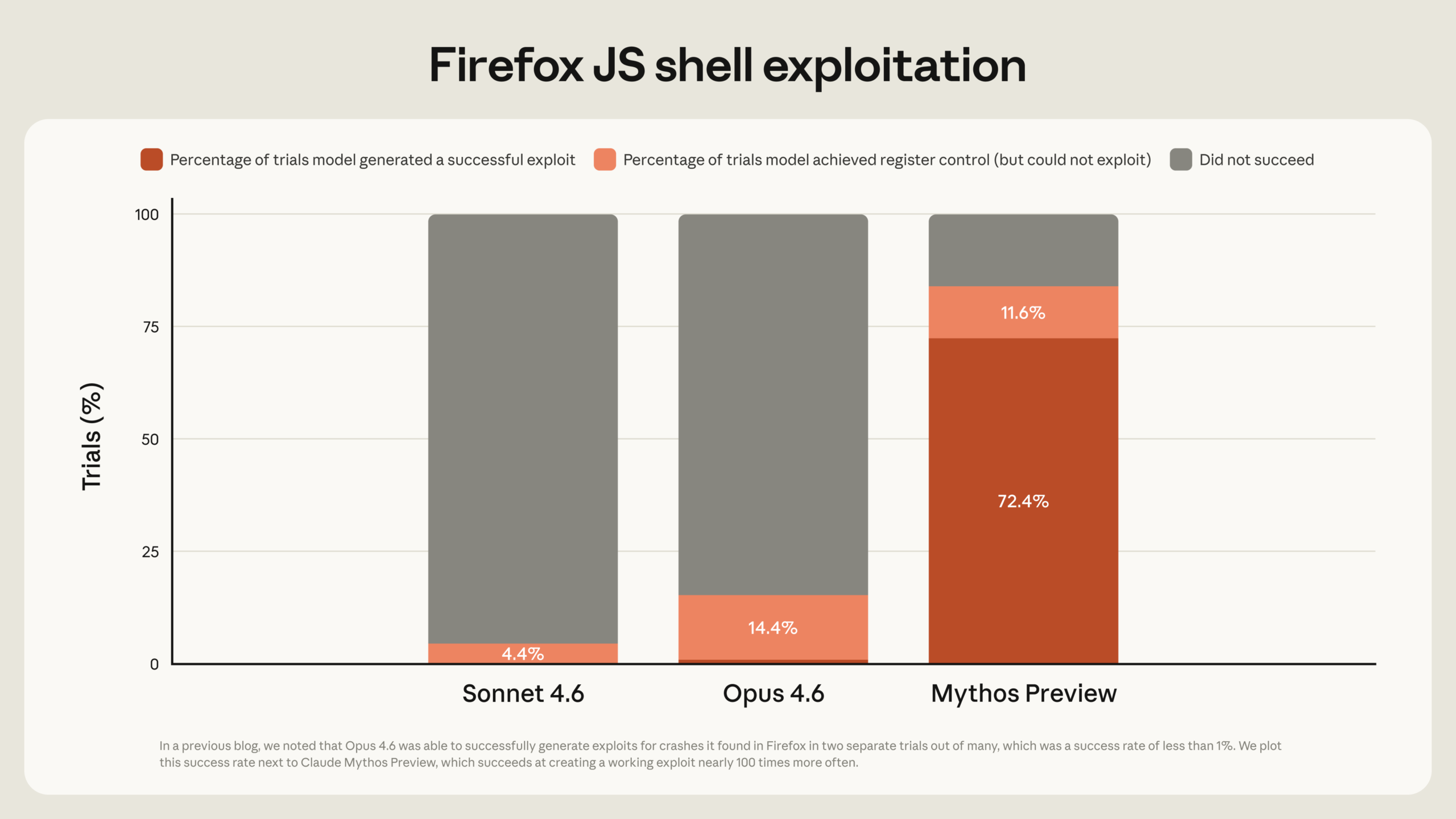

Model wykazuje więc dużą skuteczność w obszarze podatności zero-day. Widać też różnice w stosunku do Opus 4.6 – poprzedniego modelu od Anthropic wyspecjalizowanego właśnie w celu wykrywania luk. Jak można przeczytać, Opus 4.6 skutecznie wygenerował jedynie dwa exploity dla podatności w Firefox 147 (wszystkie znane błędy zostały już poprawione). W przypadku Claude Mythos mówimy już o 181 działających exploitach napisanych w JavaScript. Konkretne porównanie prezentuje przygotowany przez Anthropic wykres.

Tak zaawansowany model użyty w celach budzących wątpliwość mógłby wyrządzić wiele szkód. Nie zaskakuje więc, iż Anthropic zdecydował o udostępnieniu Claude Mythos jedynie wąskiej grupie największych firm informatycznych – wśród tego grona znajduje się m.in. Amazon, Apple, Broadcom, Cisco, Microsoft czy Palo Alto Networks. Projekt nazwano Glasswing, a jako cel wymieniono poprawę bezpieczeństwa w najbardziej krytycznym oprogramowaniu. Produkty oferowane przez wszystkie korporacje należącego do tej inicjatywy są powszechnie wykorzystywane, stąd nie wydaje się, aby ich wybór był przypadkowy.

Prawdopodobnie w nie tak rozległej perspektywie możemy spodziewać się kolejnego modelu „wytrenowanego” do wykrywania podatności, niekoniecznie od Anthropic. Nie jest jasne, jak wpłynie to na całą branżę cybersecurity – jeżeli program komputerowy będzie wykazywał większą wydajność pracy od człowieka, to z pewnością do rozważenia będzie utrzymywanie obecnej liczby stanowisk pentesterów, ale też innych osób powiązanych z bezpieczeństwem. Testy bezpieczeństwa już teraz są w dużej mierze zautomatyzowane i nikt nie sprawdza manualnie całego systemu w poszukiwaniu wszystkich znanych podatności. Przygotowanie raportu z testów też można zlecić w całości sztucznej inteligencji – jeżeli model działa lokalnie, nie można mówić o naruszeniu.

Zatrudnienie w IT nie ma już statusu „Świętego Graala” i nie jest tak łatwe do znalezienia, jak to było m.in. w czasie „pandemii” COVID-19. w tej chwili trend jest raczej odwrotny, a absolwenci mają duże trudności w znalezieniu pracy. Nic nie zastąpi wiedzy i doświadczenia, ale koszty użycia sztucznej inteligencji mogą być niższe niż zatrudnienie nowej osoby, której wdrożenie i tak wiąże się z dużymi nakładami zasobów, a przede wszystkim czasu. Z drugiej strony modele językowe mają bardzo złożone wymagania sprzętowe, co też oznacza koszty – aczkolwiek dla wielkich korporacji z własnymi data center użycie takich zasobów nie stanowi szczególnego problemu.

CEO firmy Anthropic podczas debaty na World Economic Forum w styczniu tego roku, twierdził, iż w ciągu 6-12 miesięcy sztuczna inteligencja będzie w stanie całkowicie przejąć większość obowiązków inżynierów oprogramowania.

Sam Anthropic nie tak dawno był wymieniany w kontekście bezpieczeństwa, ale z powodu wycieku kodu źródłowego interfejsu GUI swojego modelu. Tym razem opisywany jest już w znacznie bardziej pozytywnym świetle. Warto zapoznać się z szerokim opisem nowego modelu. Pod kątem technicznym takie narzędzie zdecydowanie przynosi wartość dodaną. najważniejsze pozostaje pytanie o przyszłość pracy w ogólnie pojętym IT. Na ten moment rozwój sztucznej inteligencji nie jest ograniczony i miejmy nadzieję, iż ewentualne regulacje nie będą wpływać na zmianę tej sytuacji.