W wyniku dostępu do pliku MAP części „frontend” Claude Code udało się odtworzyć pełny kod źródłowy interfejsu tego modelu. Zawartość została opublikowana m.in. w repozytorium. Osoby zainteresowane zapoznaniem się z kodem źródłowym powinny możliwie najszybciej sklonować repozytorium do zasobów lokalnych/prywatnych – praktyka pokazuje, iż podobne treści były skutecznie usuwane w dość krótkim czasie. Praca z tym kodem wymaga jednak ostrożności, bo dla przykładu pewne modyfikacje czy ewentualne obejścia zabezpieczeń są wątpliwe prawnie i moralnie.

Wspomniany plik został najpewniej przypadkowo dodany do wersji 2.1.88 (obecnie niedostępnej) w oficjalnym registry Claude Code. Wystarczyło, iż użytkownik pobrał tę paczkę i w ten sposób uzyskał dostęp do wrażliwych elementów. Standardowy moduł NPM nie zawiera pełnego kodu źródłowego – tego używanego do buildu aplikacji.

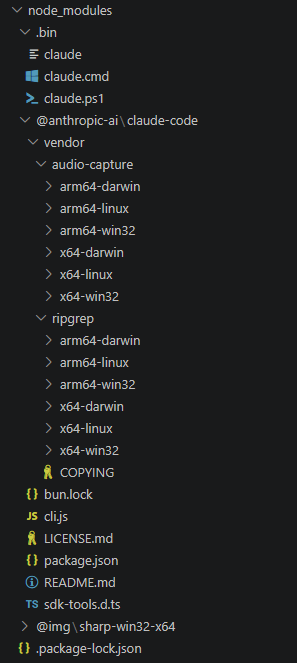

Zawartość node_modules po pobraniu @anthropic-ai/claude-code

Zawartość node_modules po pobraniu @anthropic-ai/claude-code

Pliki MAP mogą być tworzone właśnie w procesie budowania aplikacji Node.js. Zawierają kod całego projektu i z tego powodu nie powinny być w żaden sposób udostępniane. jeżeli z jakiegoś powodu istnieje konieczność zastosowania tych plików, to zalecane jest ograniczenie ich tworzenia do środowisk testowych, które nie są dostępne poza siecią wewnętrzną (można uruchomić lokalne repozytorium paczek NPM).

W przypadku Claude Code narzędziem odpowiadającym za „kompilację” jest Bun. W marcu poprzez issue w GitHub zgłoszono problem polegający na niezamierzonym serwowaniu plików MAP w środowiskach produkcyjnych (Node.js pozwala na rozróżnienie środowisk dev/prod). Nie zostało stwierdzone, czy opisywana sytuacja ma jakikolwiek związek z błędem w Bun, natomiast zdecydowanie należy odnotować ten fakt.

Co więcej, z kodu Claude Code wynika użycie biblioteki axios, która dosłownie przedwczoraj stała się głównym tematem w obszarach bezpieczeństwa IT za sprawą zmodyfikowanej wersji instalującej trojana RAT. Oba zdarzenia raczej nie są powiązane, aczkolwiek nieautoryzowany dostęp do środowisk Anthropic z pewnością miałby szeroki wpływ na całą branżę.

Oczywiście takie wydarzenia jak „wyciek” kodu dotychczas zamkniętego systemu są pewnego rodzaju okazją dla różnych programistów. Na ten moment pojawiły się dwa znaczące projekty. Pierwszy z nich to Claw Code, czyli port Claude Code na języki Python i Rust – przygotowany z użyciem innego AI. Trzeba wspomnieć, iż to repozytorium osiągnęło też pewien rekord, ponieważ uzyskało 50 tys. „gwiazdek” w ciągu dwóch godzin od publicznego udostępnienia.

Nie mniej znaczący pozostaje projekt openclaude. Twórcy umożliwili zastosowanie interfejsu Claude Code dla dowolnego innego modelu (ChatGPT, Deep Seek itp.), przygotowując de facto prostą alternatywę dla OpenClaw.

Ujawniony kod jest wyłącznie frontendem, więc nie zawiera dokładnej logiki działania modelu. Absolutnie jednak nie można stwierdzić, iż ten „wyciek” to mało istotne zdarzenie. W Internecie można znaleźć różne opracowania dotyczące funkcjonalności (także tych niedostępnych dla użytkowników), za które odpowiada odkryty kod. Z pewnością jest to także doskonały materiał do analizy przez konkurencyjne podmioty.

Przedstawiona sytuacja jest również dowodem na to, iż można tworzyć bardzo zaawansowane systemy, a wciąż popełniać tak podstawowe błędy. Anthropic to ogromna organizacja, a historia z „wyciekiem” raczej nie zostanie gwałtownie zapomniana, co ostatecznie będzie mieć negatywny wpływ na postrzeganie tej firmy przez klientów i innych wykonawców. Z drugiej strony Claude jest powszechnie cenionym modelem do różnych zastosowań technicznych, więc nie spodziewałbym się nagłego spadku zainteresowania.

Z kolei pozytywnym skutkiem może być zmniejszenie zaufania do agentów AI i jednak poświęcenie większej ilości czasu w weryfikację generowanych treści, przede wszystkim kodów czy skryptów. AI slop to codzienne zjawisko w serwisach społecznościowych i dotyczy niestety wszystkich form – tekstu, grafiki czy filmu. O ile kolejny wygenerowany przez AI materiał nie będzie poważnym zagrożeniem, to kiepskiej jakości kod dodany do kluczowego systemu już może wyrządzić szkody.