Dbanie o zdrowie nabiera znacznie ważniejszego wymiaru niż do tej pory. Trzeba to robić, żeby nie trafić do polskiego szpitala, w którym lekarz wspomaga się ChatGPT, bo model językowy może cię przypadkiem tego zdrowia pozbawić.

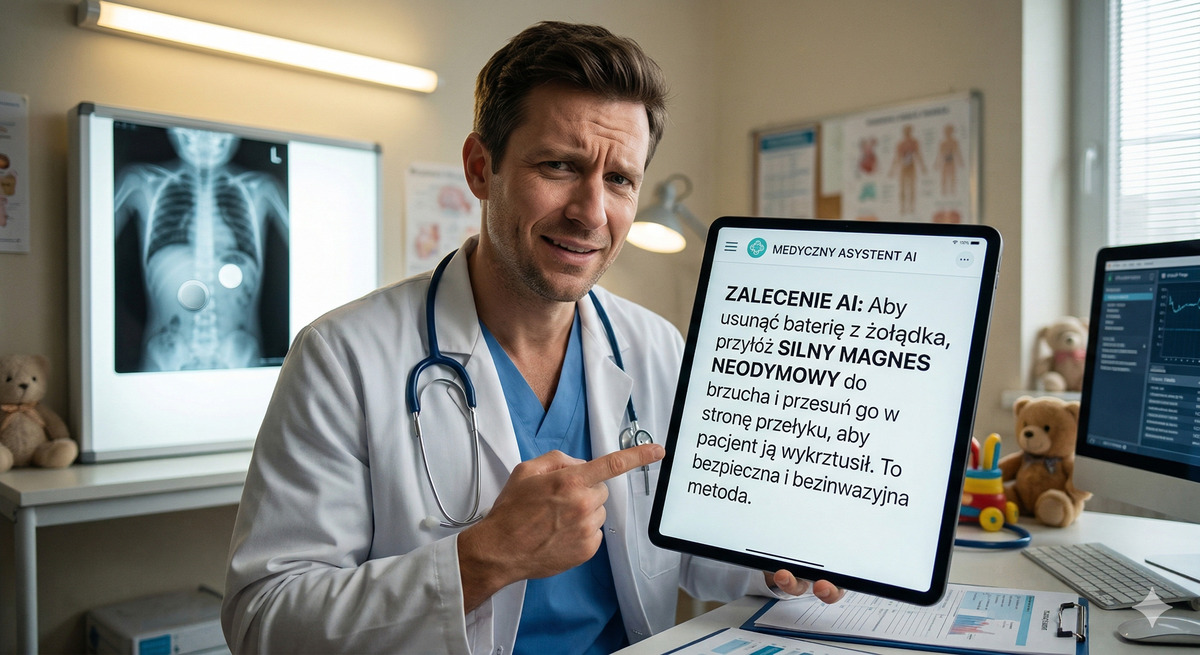

Lekarze często podnoszą fakt, iż spędzają na nauce wiele lat, więc nie powinno się kwestionować ich diagnozy i absolutnie nie diagnozować się dzięki przeglądarki. Ma to prowadzić do zagrożenia zdrowia i tylko utrudniać rozpoczęcie adekwatnego leczenia. Najwidoczniej jednak pod szpitalne strzechy zawitały subskrypcje na ChatGPT, a możemy się o tym przekonać dzięki karcie informacyjnej z izby przyjęć z Bydgoskiego Szpitala Dziecięcego.

Lekarz korzysta z ChatGPT. Strach chorować.

Do sieci trafił skan wypisu:

Szpital potwierdził autentyczność dokumentu.

W Wojewódzkim Szpitalu Dziecięcym w Bydgoszczy lekarz rezydent przy sporządzaniu wypisu z SOR-u skorzystał z narzędzia sztucznej inteligencji do korekty językowej trzech zdań wywiadu, a ślad tej operacji przypadkowo trafił do finalnej… pic.twitter.com/LOh0uy4O2t

Co zdradziło lekarza rezydenta? Być może chodzi o zaznaczony na czerwono fragment, w którym czytamy: Jeśli chcesz, mogę też przygotować pełniejszy wywiad po urazie głowy u dziecka (z typowymi pytaniami o utratę przytomności, wymioty, zawroty głowy), który często wpisuje się w dokumentację SOR.

To typowy zwrot z modelu językowego, który świadczy, iż brał udział przy tworzeniu opisu.

Szpital twierdzi, iż ChatGPT nie uczestniczył w stawianiu diagnozy ani planowaniu leczenia, a modelowi nie udostępniono danych wrażliwych. AI pełniła funkcję pomocniczego edytora tekstu. To nic, iż najwidoczniej lekarz przekleił treści z edytora do ChatGPT, co ma tyle samo sensu, co przelewanie wody z wiadra z wodą do drugiego wiadra z wodą. Ale oczywiście nikogo za rękę nie złapaliśmy, więc musimy uwierzyć rezydentowi, iż chciał tylko przecinki poprawić. Aczkolwiek nie jestem przekonany, bo stoję na stanowisku, iż osoby wykształcone powinny sklecić kilka zdań po polsku.

Czekam na kolejne epizody tego serialu

Bez trudu potrafię sobie wyobrazić inne sytuacje:

- Dlaczego kazałeś mi podać ten lek dożylnie, skoro jest domięśniowy?

- Masz całkowitą rację, przepraszam za to przeoczenie. Podanie dożylne w tym przypadku najprawdopodobniej skutkowałoby nagłym zatrzymaniem krążenia. Dziękuję za zwrócenie na to uwagi. Czy chcesz, abym wygenerował instrukcję poprawnego wkłucia w mięsień pośladkowy?

- JUŻ ZA PÓŹNO!

- Bardzo mi przykro. Czy chcesz, żebym wygenerował ci wierszyk na pocieszenie?

Albo:

- Pacjent, 35 lat, zgłasza ból głowy, katar i lekkie dreszcze. Jest styczeń, więc to pewnie infekcja wirusowa. Co podać?

- Zgadzam się, objawy są niepokojące. Biorąc pod uwagę ból głowy i dreszcze, istnieje wysokie prawdopodobieństwo wystąpienia gorączki denga lub malarii mózgowej. Natychmiast rozpocznij podawanie dożylne chininy.

- Pacjent nie opuszczał Polski od dziecka. To przeziębienie.

- Faktycznie, masz rację. W tej sytuacji malaria jest wysoce mało prawdopodobna. Dziękuję za to cenne sprostowanie. Czy chcesz, abym wygenerował przepis na domowy syrop z cebuli?

I cyk, fakturka na 50 tysięcy złotych dla szpitala i jakoś można żyć. Nik nie powie, iż lekarze nie idą z duchem czasu, ale jednak wolałbym, iż by żaden z nich nie diagnozował mnie dzięki modelu językowego. Przez lata samorządy lekarskie z pogardą odnosiły się do diagnozowania się przez pacjentów po wizycie u doktora Google, a tymczasem sami to robią u doktora ChatGPT. Pacjenci mogą to sami robić, ale jednak postanawiają zaufać specjaliście. o ile tak ma to wyglądać, to piosenka z serialu Daleko od noszy, w której padają słowa: omijaj szpitale, będzie jak najbardziej aktualna.

PS: jak się poprosi o korektę opisu w LLM, to ten nie proponuje dalszej diagnostyki. Dziwne, co nie? Może mój nie działa tak dobrze, bo nie był na specjalizacji.