Bez jedności przekazu nie osiągniemy celów rewolucji – z tego, niewątpliwie prawdziwego założenia wychodzi Komisja Europejska. Dąży ona do zdyscyplinowania platform społecznościowych w celu zwalczania tego, co w globalistycznej nowomowie określane jest jako „dezinformacja” – czyli niezależnej wymiany informacji.

Główne firmy internetowe, jak Google, Meta, Microsoft i TikTok, opublikowały we wtorek raporty. Opisały szczegółowo, jak radziły sobie ze zwalczaniem „dezinformacji”, zwłaszcza w czasie czerwcowych wyborów do Parlamentu Europejskiego.

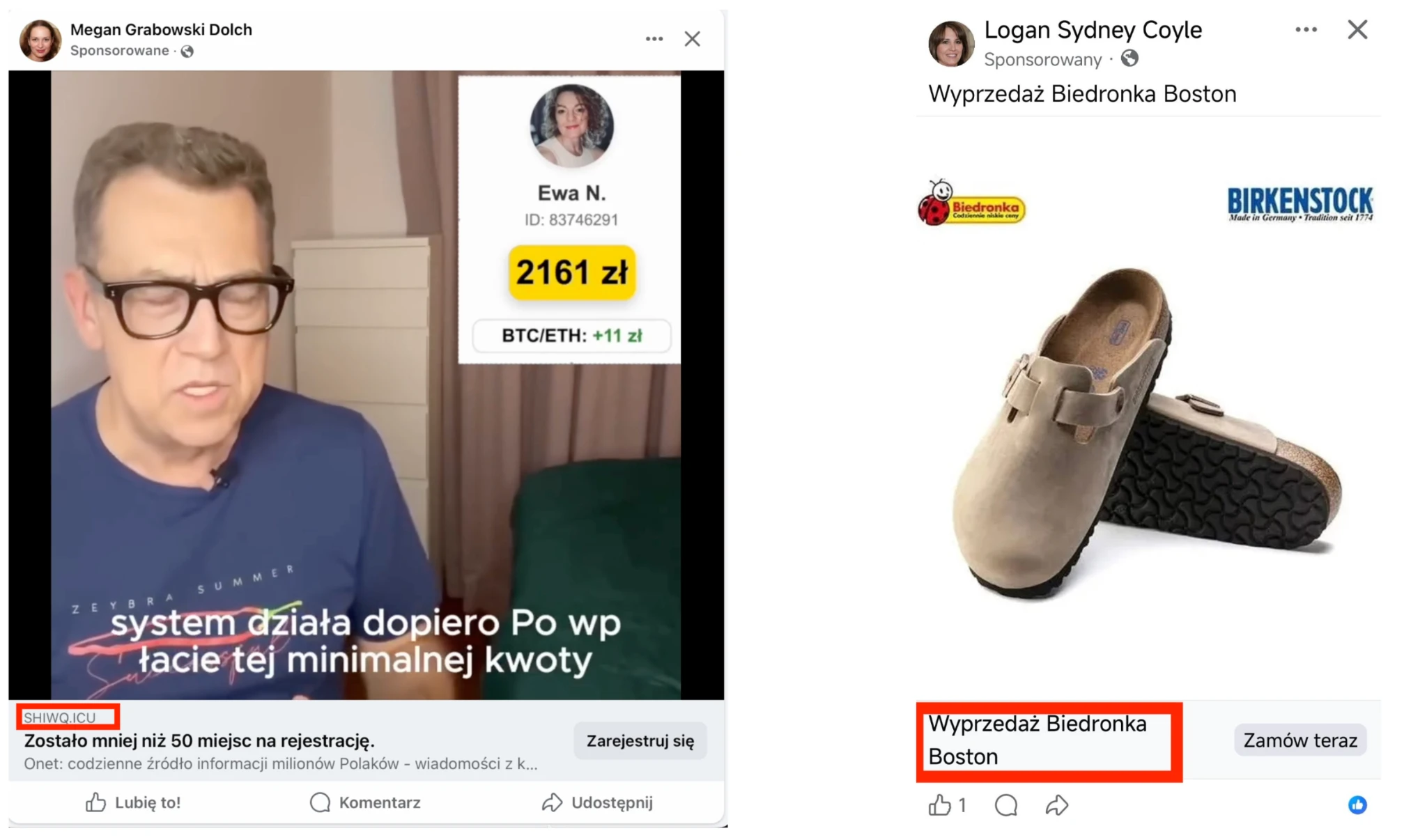

Do składania regularnych raportów Komisji Europejskiej zobowiązuje platformy unijny kodeks postępowania w zakresie dezinformacji. Dobrowolne – jak na razie – porozumienie między KE a branżą internetową podpisane zostało w czerwcu 2022 roku. Nakłada na serwisy m.in. obowiązek usuwania lub blokowania „nieprawdziwych” treści, kasowania lub zawieszania fałszywych kont i botów rozprzestrzeniających „dezinformację”, oznaczania materiałów sponsorowanych, zwłaszcza reklam politycznych, oraz blokowania możliwości zarabiania na rozpowszechnianiu „dezinformacji”.

Sygnatariuszy kodeksu jest 44 i należą do nich największe platformy internetowe, firmy technologiczne oraz mniejsi gracze, jak firmy zajmujące się reklamą internetową i fact-checkingiem. Opublikowane we wtorek raporty to czwarte sprawozdania złożone KE, w których platformy szczegółowo opisały jak walczyły z „dezinformacją”. Skupiono się zwłaszcza na newralgicznym okresie wyborów do Parlamentu Europejskiego, które odbyły się w dniach 6 – 9 czerwca.

Z raportu TikToka wynika na przykład, iż firma uruchomiła w aplikacji 27 centrów wyborczych w 24 językach, gdzie publikowane były „rzetelne” doniesienia o wyborach. Jak poinformował TikTok, strony te zostały odwiedzone przez 7,5 mln użytkowników w ciągu czterech tygodni poprzedzających głosowanie. W tym okresie też platforma usunęła 43 tys. treści „naruszających politykę firmy dotyczącą dezinformacji” oraz ponad 2,5 tysiąca tak zwanych fake newsów dotyczących samych wyborów. „96 proc. tych treści zostało usuniętych, zanim zostały nam zgłoszone, 80 proc. z nich nie zdążyło jeszcze trafić do odbiorców” – napisał TikTok.

Firmy poinformowały także, jakie podjęły środki, aby zabezpieczyć swoje serwisy przed rozpowszechnianiem za ich pośrednictwem „dezinformacji” wygenerowanej przez sztuczną inteligencję (AI). I tak np. Meta, czyli firma matka m.in. Facebooka i Instagrama, zwróciła uwagę, iż specjalnie oznaczała treści tworzone przez AI; w czasie wyborów do PE oznaczonych zostało ponad 5 mln tego typu treści publikowanych na obu platformach, ponad 4 mln zostały usunięte.

Wiceprzewodnicząca UE Viera Jourova, która jeszcze przez wyborami do PE mówiła PAP, iż okres wyborczy będzie testem tego, czy UE radzi sobie z „dezinformacją”, we wtorek przypomniała, iż chociaż kodeks wciąż jeszcze ma charakter dobrowolny, to niebawem podlegać będzie unijnym regulacjom cyfrowym. – Oczekuję, iż sygnatariusze kodeksu gwałtownie przekształcą go w kodeks postępowania na mocy ustawy o usługach cyfrowych – skomentowała komisarz. Oznaczałoby to wówczas, iż np. X (dawny Twitter), który w ubiegłym roku wycofał się z kodeksu, byłby prawnie zobowiązany do jego przestrzegania.

Kolejny zestaw sprawozdań platform na temat walki z „dezinformacją” spodziewany jest wiosną 2025 roku.

![]()

Źródła: PAP (Jowita Kiwnik Pargana), PCh24.pl

RoM

Nadchodzi unijna cenzura wyborcza. Bruksela chce, byś głosował po jej myśli

Armia lewicowych cenzorów będzie przeczesywać Facebooka i Instagram przed wyborami do europarlamentu