Pożary trawiące okolice Los Angeles, w tym Hollywood Hills, przynoszą nie tylko zniszczenia i tragedie, ale również stanowią pole do nadużyć związanych z wykorzystaniem sztucznej inteligencji (AI). Ostatnie dni pokazują, jak zaawansowane narzędzia AI, takie jak generatory obrazów i wideo, mogą być wykorzystywane do tworzenia fałszywych materiałów, które sieją zamęt w mediach i wśród społeczności.

AI i tworzenie fałszywych obrazów pożarów

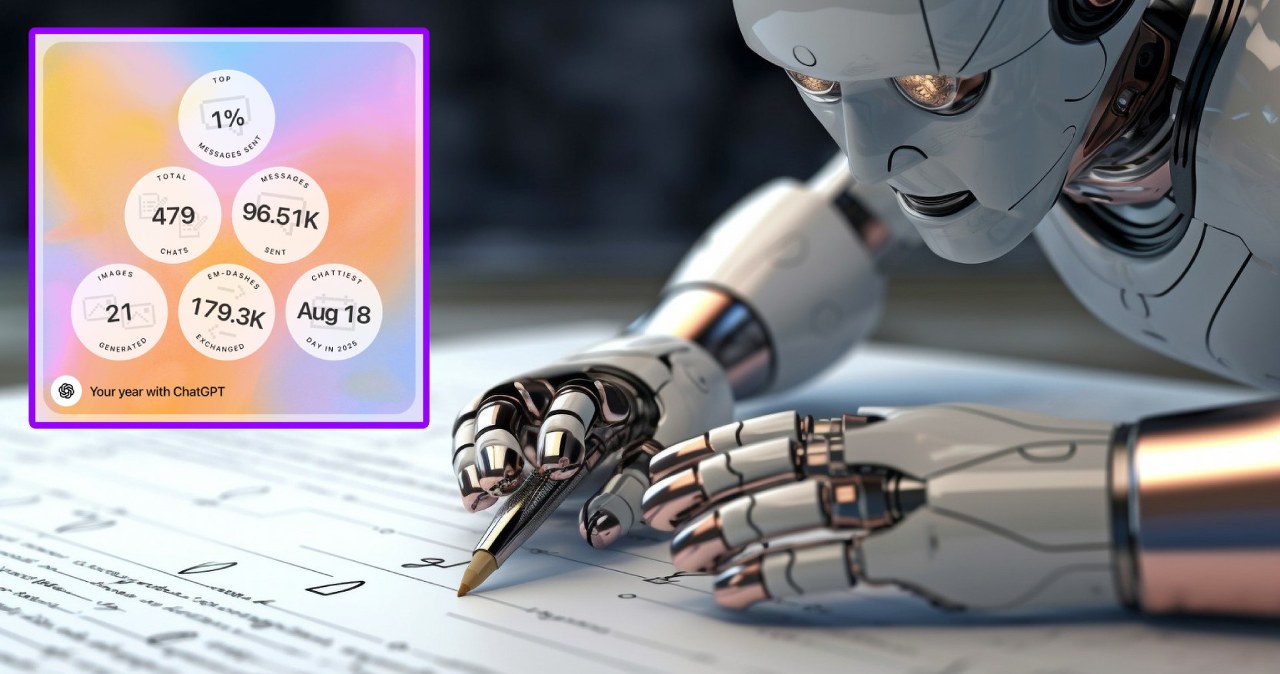

Od początku kryzysu pożarowego w Los Angeles w mediach społecznościowych pojawiły się liczne obrazy i filmy rzekomo przedstawiające napis „Hollywood” pochłonięty przez płomienie. Najbardziej rozpowszechniony materiał wideo został stworzony dzięki zaawansowanego narzędzia AI o nazwie Grok, a następnie animowany przy użyciu jednego z popularnych generatorów wideo.

Film ten pokazuje ikonę Hollywood Hills otoczoną ogniem, co wywołało panikę i niepokój wśród mieszkańców oraz użytkowników internetu.

Jednak w rzeczywistości wzgórze, na którym znajduje się napis, nie zostało strawione przez pożar. Materiały te są w 100% fałszywe i stanowią przykład dezinformacji, która w dobie powszechnego dostępu do technologii AI staje się coraz trudniejsza do wykrycia.

Podobne obrazy, które również trafiły do sieci, to statyczne fotografie płonącego napisu. Choć wyglądają realistycznie, zostały stworzone przy pomocy zaawansowanych generatorów obrazów. Oto przykłady:

Pożary w Los Angeles i plaga fejków AI

Pożary w Los Angeles i plaga fejków AII kolejny:

Pożary w Los Angeles i plaga fejków AI

Pożary w Los Angeles i plaga fejków AIW Polsce niechlubnie zapisał się profil, miasta Łódź, o czym wspomniał serwis Fakenews.pl:

Niestety, wiele osób bezkrytycznie wierzy w autentyczność takich materiałów, co może prowadzić do eskalacji paniki i dezinformacji.

Jak rozpoznać fałszywe materiały generowane przez AI?

W obliczu wzrastającej liczby fałszywych treści warto znać kilka metod, które pomogą zweryfikować autentyczność obrazów i filmów:

- Analiza metadanych: jeżeli masz dostęp do pliku, sprawdź jego metadane. Często generatory AI pozostawiają ślady w plikach, które mogą wskazać, iż obraz został stworzony sztucznie.

- Nierealistyczne szczegóły: AI często ma trudności z dokładnym odwzorowaniem szczegółów, takich jak rozmieszczenie ognia, cienie czy refleksy światła. Warto zwrócić uwagę na niepasujące elementy.

- Porównanie z wiarygodnymi źródłami: jeżeli zobaczysz obraz przedstawiający katastrofę, zawsze sprawdź oficjalne źródła informacji, takie jak lokalne media czy komunikaty od władz.

- Sprawdzenie historii obrazu: Narzędzia takie jak Google Reverse Image Search pozwalają prześledzić historię zdjęcia i sprawdzić, czy było wcześniej używane w innych kontekstach.

Wpływ fałszywych treści na społeczeństwo

Rozpowszechnianie fałszywych obrazów i wideo podczas kryzysów może mieć poważne konsekwencje. W przypadku pożarów w Los Angeles, fałszywe materiały wprowadziły zamieszanie, co utrudniło działania ratunkowe i mogło odwrócić uwagę opinii publicznej od rzeczywistych potrzeb, takich jak ewakuacje czy wsparcie dla poszkodowanych.

Warto również zwrócić uwagę na kwestię odpowiedzialności osób, które tworzą i udostępniają takie treści. Choć generatory AI są potężnym narzędziem w rękach twórców, ich niewłaściwe wykorzystanie może prowadzić do poważnych konsekwencji społecznych i prawnych.

Podsumowanie

Kryzysy, takie jak pożary w Los Angeles, przypominają, jak ważne jest odpowiedzialne korzystanie z technologii AI. Tworzenie fałszywych materiałów, które wyglądają jak prawdziwe, może prowadzić do dezinformacji, chaosu i strachu. Każdy użytkownik internetu powinien być świadomy zagrożeń płynących z takich działań i zawsze dokładnie weryfikować informacje przed ich udostępnieniem.

Jeśli zobaczysz obrazy lub filmy przedstawiające płonący napis „Hollywood” — pamiętaj, iż są one fałszywe. Bądź czujny i dbaj o rzetelność informacji, które konsumujesz i udostępniasz. Sztuczna inteligencja to potężne narzędzie, ale jej niewłaściwe wykorzystanie niesie ze sobą realne zagrożenia.