W świecie błyskawicznego rozwoju AI to Europa wyznacza regulacje prawne, tworząc zasady kopiowane na całym świecie. Unijne standardy stają się dziś kluczem do tego, jak będzie wyglądać europejska przyszłość cyfrowa.

W Europie rośnie poczucie cyfrowej bezsilności. Gdy amerykańscy giganci technologiczni wprowadzają kolejne generacje modeli sztucznej inteligencji co kilka miesięcy, a Chiny wdrażają algorytmy na skalę największych przemian gospodarczych od epoki rewolucji przemysłowej, Unia Europejska wciąż mozolnie dopracowuje swoje ramy prawne — i to w sprawach, które już dawno przestały być przyszłością, a stały się teraźniejszością.

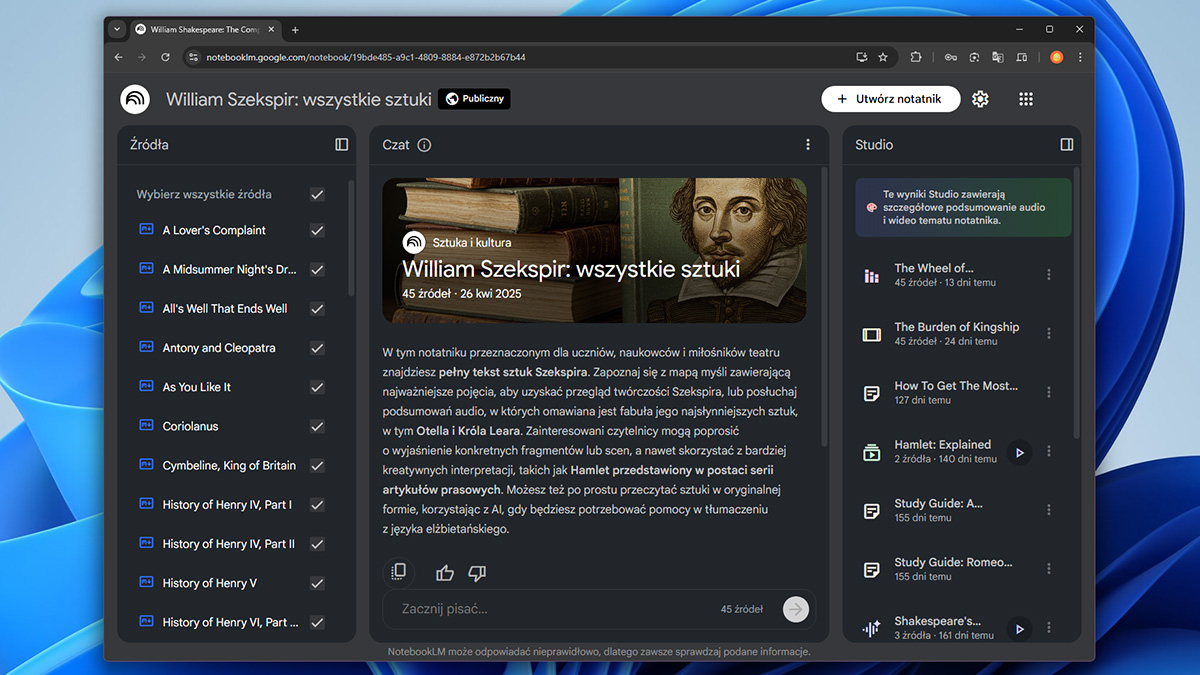

Najlepszym symbolem tego rozdźwięku jest ChatGPT. W październiku odnotował ponad 120 milionów aktywnych użytkowników w Europie, stając się w praktyce jednym z najważniejszych narzędzi cyfrowych naszego kontynentu. A jednak regulacyjnie wciąż nie wiadomo, jak go sklasyfikować.

Komisja Europejska zapowiada, iż najważniejsze decyzje w sprawie regulacji AI zapadną dopiero w połowie 2026 roku. Mimo to w Brukseli realizowane są intensywne prace nad legislacją cyfrową. To niemal groteskowe opóźnienie, zwłaszcza iż w tym czasie ChatGPT może zmienić się w platformę operacyjną, daleko odbiegającą od obecnego modelu językowego. Europejska machina legislacyjna, z natury powolna i ostrożna, znów traci oddech, próbując dogonić technologię, która nie zna procedur i rozwija się w zawrotnym tempie.

Powolna Europa, szybki świat

Unia nie jest oczywiście bezczynna. Od lutego 2024 r. obowiązuje Akt o Usługach Cyfrowych (DSA), mający chronić użytkowników przed nielegalnymi treściami, dezinformacją i nadużyciami platform. Jednocześnie trwa wdrażanie AI Act — pierwszego na świecie kompleksowego prawa dotyczącego sztucznej inteligencji.

Problem polega na tym, iż obie regulacje powstawały osobno. AI Act patrzy na ryzyko modeli, DSA na ryzyka systemowe związane z platformami. W przypadku ChatGPT te dwa światy nakładają się na siebie, tworząc prawny labirynt, w którym pogubiłby się choćby najbardziej zdeterminowany regulator.

W rezultacie Europa nie tylko działa wolniej niż USA i Chiny — działa też w sposób bardziej złożony, mniej elastyczny i często oderwany od rzeczywistego tempa innowacji. Nie jest to jednak tylko problem brukselski. Na poziomie państw członkowskich sytuacja potrafi wyglądać jeszcze gorzej.

Polska wciąż nie wyznaczyła stałego krajowego koordynatora DSA, choć miała to zrobić do lutego 2024 roku. Funkcję tę tymczasowo pełni prezes UKE, ale brak stabilnej podstawy prawnej grozi nałożeniem kar przez Trybunał Sprawiedliwości UE. Opóźnienia realnie osłabiają ochronę internautów — rośnie ryzyko dezinformacji, oszustw, nielegalnych reklam. Wprowadzenie europejskiego prawa trwa latami, ale jego wdrożenie może zająć jeszcze dłużej.

Europa wciąż pisze regulacyjny podręcznik

A jednak — wbrew pozorom — to właśnie UE wyznacza globalne standardy regulacji. Ostatnie wydarzenia przypominają o tym z brutalną jasnością.

Podczas niedawnego szczytu AI, według Financial Times w Londynie, jedna kluczowa obserwacja wywołała konsternację: Kalifornia oparła część swojego AI Bill na unijnym AI Act. Uczestnicy paneli, przyzwyczajeni do narracji o „amerykańskiej innowacji” i „europejskiej ostrożności”, nagle stanęli twarzą w twarz z faktem, iż to Bruksela — nie Waszyngton — pisze dziś światowy kodeks AI.

To właśnie tzw. „Efekt Brukseli” — mechanizm, w którym regulacje UE stają się wzorcami globalnymi, bo ich przejrzystość i rygor wymuszają ich stosowanie także poza Europą. Tak było z RODO, tak zaczyna być z AI Act. Kanada, Japonia i kolejne kraje stosują europejskie pojęcia ryzyka, nadzoru, przejrzystości i odpowiedzialności.

Europa może nie nadąża technologicznie — ale regulacyjnie przez cały czas jest pierwsza. I to na jej definicjach, jej zasadach, jej podejściu do praw człowieka budują dziś polityki inne państwa świata.

Czy Europa jeszcze potrafi działać?

Jensen Huang, szef NVIDII, powiedział niedawno: „Chiny wygrają wyścig AI z USA.” Jego słowa wstrząsnęły Zachodem, ale jeszcze bardziej powinny wstrząsnąć Europą — kontynentem, który w tym wyścigu nie ma choćby własnego toru, ale próbuje regulować bieganie innych.

W tym globalnym ekosystemie regulacje UE pełnią rolę bezpiecznika, który ma zapobiec niekontrolowanemu przyspieszaniu. Jednak świat nie czeka. o ile Europa pozostanie jedynie cyfrowym recenzentem, nie współtwórcą technologii, ryzykuje utratę wpływu, którego nie odzyska już nigdy.

Paradoks polega na tym, iż UE z jednej strony jest spóźniona — a z drugiej: absolutnie kluczowa dla globalnej równowagi. To Europa przypomina światu, iż technologia nie jest celem samym w sobie, ale narzędziem służącym człowiekowi. Że trzeba synchronizować bezpieczeństwo, tempo i cel — zamiast ślepo ścigać się na moc obliczeniową.

To dlatego AI Act, mimo kontrowersji, staje się globalnym standardem. To dlatego Komisja chce, by do 2030 roku regulacje cyfrowe były bardziej spójne, przejrzyste i przyjazne innowacjom. To dlatego powstają inicjatywy takie jak europejska Omnibus Digital Agenda. To także dlatego Polska aktualizuje własną politykę AI — od budowy infrastruktury obliczeniowej, przez rozwój talentów, po wdrażanie modeli takich jak PLLuM. Europa przez cały czas może być liderem — nie przez prędkość, ale przez kierunek. Ale czas, w którym mogła pozwolić sobie na powolne procedury, właśnie dobiega końca.

Regulacja kształtuje przyszłość

W świecie, w którym USA i Chiny tworzą dwa konkurencyjne ekosystemy sztucznej inteligencji, globalne standardy będą powstawać tak czy inaczej. Pytanie brzmi: czy to Europa będzie ich autorem, czy tylko czytelnikiem.

Bruksela nie może już być cyfrową figurą, która powtarza: „coś się musi wydarzyć”, ale nic nie robi. Przyszłość nie czeka na protokoły, konsultacje i rezolucje.

Europa musi pisać zasady szybciej, mądrzej i odważniej. Bo jeżeli nie ona ureguluje sztuczną inteligencję, to sztuczna inteligencja — ureguluje Europę.