Google zaprezentowało owoce pracy swojego modelu AI – Google Genie – tworzącego interaktywne gry wideo w oparciu o pojedynczą grafikę. Może nią być choćby rysunek twojego dziecka.

Prezes firmy Nvidia sugerował, by młodzi ludzie nie uczyli się programowania, ponieważ języki takie jak Java, C++ czy Python odejdą w niepamięć. jeżeli szukamy zwiastunów potwierdzających tę tezę, doskonałym przykładem jest Google Genie – model AI, którego zadaniem jest tworzenie żywych, interaktywnych dzieł na podstawie materiału źródłowego. Czyli m.in. gier.

Dotychczasowe wytwory AI imponują, ale są pozbawione możliwości interakcji.

Wytwory współczesnej sztucznej inteligencji – tekst, dźwięk, grafika czy wideo – uniemożliwiają interakcję w czasie rzeczywistym (może z częściowym wyłączeniem formatu czatbotów). To wytwory statyczne, które sprowadzają człowieka do roli biernego odbiorcy. Niezaangażowanego konsumenta czytającego tekst albo oglądającego klip wideo.

Ograniczenie interaktywności, charakterystyczne dla dotychczasowych wytworów AI, jest właśnie niwelowane. Model generatywny tworzony przez spółkę Alphabet o nazwie Google Genie specjalizuje się w zamianie materiału źródłowego w interaktywne środowisko, na które człowiek wpływa w czasie rzeczywistym, z wykorzystaniem naturalnych komend. Słowem: tworzy gry wideo.

Google Genie zamienia proste zdjęcia i obrazki w interaktywne gry wideo.

Aby Genie wiedział jakie jest jego zadanie, wcześniej został nakarmiony 30 tys. godzin rozgrywek z rozmaitych gier, przekładających się na 200 mln zmiennych analizowanych przez AI. W ten sposób powstała baza dla dużego modelu, dzięki której Genie jest w stanie zamienić w grę podany mu materiał źródłowy. Na przykład zdjęcie. Albo rysunek dziecka. Wystarczy choćby opis tekstowy, najpierw transformowany w statyczną grafikę, a później zamieniany w interaktywne środowisko.

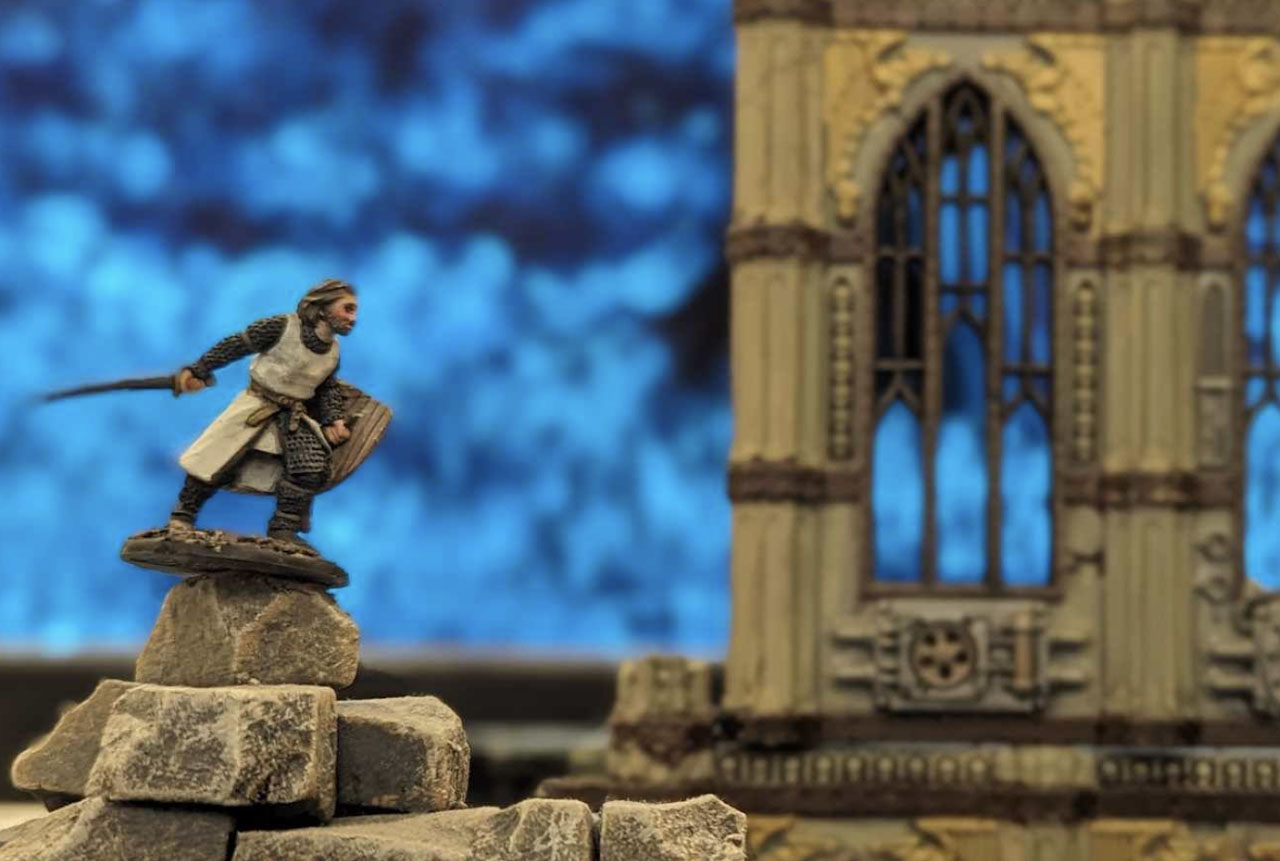

Zespół Google Genie zaprezentował krótkie klipy, na których widzimy jak sztuczna inteligencja zamienia w gry wideo takie wytwory ludzkiej działalności jak rysunek dziecka, komputerowa grafika, wycinanka, zdjęcie posiadanych figurek czy fotografia ukochanego psa.

Uzyskany efekt nie jest co prawda powalający, ale sam fakt zamiany statycznego źródła w interaktywne środowisko gry jest niesamowicie imponujące. Uwiarygodnianie animacji to wyłącznie kwestia czasu, tak jak było to w przypadku tworzenia wideo przez AI. Początkowo bardzo nienaturalnego, współcześnie szokująco płynnego i wiarygodnego.

Co ciekawe, Google Genie tworzy interaktywne gry w sposób drastycznie różny od człowieka.

Gdy ludzie produkują dwuwymiarowe gry platformowe, tworzą osobne sprite’y, sklejają animacje, wpisują zasady rozgrywki w kod, nakładają na to interfejs i tak dalej. Tymczasem sztuczna inteligencja Google bazuje wyłącznie na następujących po sobie klatkach animacji. AI domniemuje, co powinno się na nich wydarzyć, na skutek komendy gracza i posiadanych przez niego możliwości.

Tworzenie gier przez sztuczną inteligencję jest zatem znacznie bliższe tworzeniu filmu niż pisaniu gry wideo. To zasadnicza różnica. Proces twórczy Google Genie przypomina spekulację w oparciu o masę danych i zmiennych, podczas gdy proces twórczy białkowych programistów jest jak budowanie kukiełkowego teatrzyku, sceny oraz zabawek, by potem oddać to wszystko w ręce graczy.

Aby Google Genie mogło skutecznie spekulować co będzie działo się w kolejnych klatkach interaktywnej rozgrywki, najpierw musi sprecyzować możliwości gracza. Aktualny model oferuje człowiekowi zakres ruchu w czterech kierunkach klasycznego d-pada (krzyżaka) plus cztery skosy. Na przycisk akcji lub walki musimy jeszcze poczekać.

Gdy AI zna już potencjalne możliwości gracza (zmiana pozycji w ośmiu wariantach), jest w stanie generować kolejne klatki w oparciu o przyciski wciskane w świecie materialnym, bądź jakąkolwiek inną formę komend, na przykład głos.

Sztuczna inteligencja tworząca gry jest mocno ograniczona, ale jej rozwój to wyłącznie kwestia czasu.

Na ten moment Google Genie oferuje rozgrywkę z płynnością jednej klatki na sekundę. To 60 razy mniej niż docelowa wartość i 30 razy mniej niż pożądana przez graczy wartość minimalna, zapewniająca komfortową zabawę. AI póki co nie potrafi generować płynniejszego środowiska, jednocześnie tworząc warianty do wszystkich potencjalnych ruchów gracza.

Wzorem innych modeli odpowiedzialnych za generowanie tekstu, grafiki czy wideo, Genie lubi też halucynować. Mniej w przypadku animacji grywalnej postaci, bardziej jeżeli chodzi o lokację, scenerię i tło. Proste otoczenie jak np. pole golfowe po kilku sekundach może się zamienić w dziwaczny labirynt jak po zażyciu LSD.

AI na pewno nauczy się tworzyć gry wideo szybciej niż zajęło to ludziom.

Od wydania gry Pong do premiery Descent – według wielu pierwszej prawdziwie trójwymiarowej produkcji 3D – minęły 22 lata. Coś mi mówi, iż sztuczna inteligencja będzie potrzebowała znacznie mniej czasu, by nauczyć się produkcji trójwymiarowych, interaktywnych przygód.

Pytanie tylko, czy takie gry będą lepsze od tych produkowanych przez homo sapiens. Zdecydowanie nie, dopóki sztuczna inteligencja pozostanie w roli odtwórczego narzędzia, bez umiejętności kreatywnego myślenia, refleksyjności oraz samodoskonalenia.

Za to sam proces tworzenia gier (oraz programów) może się drastycznie zmienić. Wszakże po co człowiekowi znajomość programowania, skoro wszystkie wytyczne, cele, oczekiwania i potrzeby będzie w stanie wyartykułować w ojczystym języku, a AI zamieni jego oczekiwania w cyfrowy byt. Niedoskonały, z masą rzeczy do manualnej poprawy i regulacji, ale jednak byt.