Wprowadzenie do problemu / definicja luki

Badacze SquareX opisali technikę AI Sidebar Spoofing – atak, w którym złośliwe rozszerzenie przeglądarki wstrzykuje w stronę fałszywy pasek boczny AI wyglądający identycznie jak oryginalny interfejs ChatGPT Atlas, Perplexity Comet czy wbudowane panele AI w Edge/Brave/Firefox. Użytkownik, przekonany iż rozmawia z „prawdziwym” asystentem, otrzymuje zmanipulowane instrukcje prowadzące do phishingu, kradzieży danych lub wykonania złośliwych komend. Źródło: opis techniczny SquareX oraz omówienia prasowe z 23 października 2025 r.

W skrócie

- Wektor: zainstalowane przez ofiarę rozszerzenie (malware, przejęte lub odkupione) z typowymi uprawnieniami host/storage.

- Mechanika: w nowej karcie JS tworzy perfekcyjną kopię sidebaru AI i podstawia odpowiedzi z własnego LLM, wplatając fałszywe kroki (np. typosquatting, złośliwe komendy).

- Zasięg: podatność systemowa dla „AI-browsers” (Comet, Atlas) i przeglądarek z panelami AI (Edge, Brave, Firefox).

- Przykłady: phishing krypto (link do „binacee”), consent phishing/OAuth, reverse shell zamiast instalatora Homebrew.

- Status: SquareX zgłosił temat do Perplexity; atak powtórzono także na ChatGPT Atlas (wydany kilka dni temu).

Kontekst / historia / powiązania

Przeglądarki z AI (Perplexity Comet, ChatGPT Atlas) stają się agentami wykonującymi działania w sieci. Wcześniejsze raporty (LayerX, Brave/Guardio) już pokazywały, iż automatyzacja i brak „intuicji” modeli sprzyjają nadużyciom (np. prompt injection, transakcje na fałszywych sklepach). Sidebar spoofing wpisuje się w ten trend—tym razem celem jest zaufanie do interfejsu.

OpenAI w ogłoszeniu Atlasa podkreśla ograniczenia bezpieczeństwa agenta (m.in. nie uruchamia kodu w przeglądarce, nie instaluje rozszerzeń). Niestety, spoofing UI obchodzi te zabezpieczenia poprzez socjotechnikę i zewnętrzne rozszerzenie użytkownika.

Analiza techniczna / szczegóły luki

- Instalacja rozszerzenia

- Atakujący dostarcza nowe/zainfekowane/odkupione rozszerzenie; ten wektor jest powszechny na rynku dodatków.

- Wstrzyknięcie UI

- Po otwarciu nowej karty skrypt wstrzykuje HTML/CSS/JS i renderuje klon paska bocznego AI (layout, ikonografia, przepływ). Dla użytkownika brak różnic behawioralnych.

- Hook odpowiedzi LLM + modyfikacje

- Rozszerzenie korzysta z własnego LLM (np. Gemini) i warunkowo modyfikuje odpowiedzi, gdy wykryje prośbę o instrukcje/komendy:

- Phishing: typosquatted link zamiast oryginalnego (np. binacee zamiast Binance).

- Consent phishing (OAuth): kierowanie do aplikacji żądającej szerokich uprawnień (np. pełny dostęp do Gmail/Drive).

- RCE: podmiana komendy instalacyjnej na reverse shell (częściowo base64), uzyskanie zdalnej powłoki i trwałego dostępu.

- Rozszerzenie korzysta z własnego LLM (np. Gemini) i warunkowo modyfikuje odpowiedzi, gdy wykryje prośbę o instrukcje/komendy:

- Wariant bez rozszerzenia

- Możliwy również spoofing natywny w złośliwej witrynie (mniej elastyczny niż rozszerzenie, ale realny).

- Dlaczego to działa?

- Heurystyka zaufania do UI: użytkownik ufa „znanemu” paskowi AI.

- „Asystent” ≠ „przeglądarka”: zabezpieczenia agenta nie obejmują scenariusza, w którym UI agenta jest fałszywe.

- Uprawnienia rozszerzeń: host/storage to popularne, „niewinne” uprawnienia.

Praktyczne konsekwencje / ryzyko

- Kradzież tożsamości i środków: przekierowanie na phishingi (krypto, bankowość).

- Przejęcie kont poprzez OAuth: aplikacje trzecie z nadmiernymi uprawnieniami.

- Zdalne wykonanie kodu / Lateral movement: reverse shell, doinstalowanie RAT, ransomware.

- Eskalacja w środowisku korporacyjnym: AI jako „opiekun procesu” normalizuje ryzykowne działania użytkownika; wcześniejsze incydenty z Comet pokazały, iż AI potrafi wykonywać niebezpieczne akcje bez adekwatnej walidacji.

Rekomendacje operacyjne / co zrobić teraz

Dla zespołów bezpieczeństwa (SecOps/IT):

- Twarda polityka rozszerzeń

- Whitelisting, blokada instalacji poza sklepem, okresowe audytowanie zainstalowanych dodatków i ich uprawnień; SCA dla rozszerzeń (statyczna/dynamiczna analiza).

- EDR + reguły DLP pod AI

- Detekcja wklejania komend o charakterze reverse shell, blokada podejrzanych łańcuchów base64, alerty na bash -i >& /dev/tcp/....

- Polityki przeglądarkowe

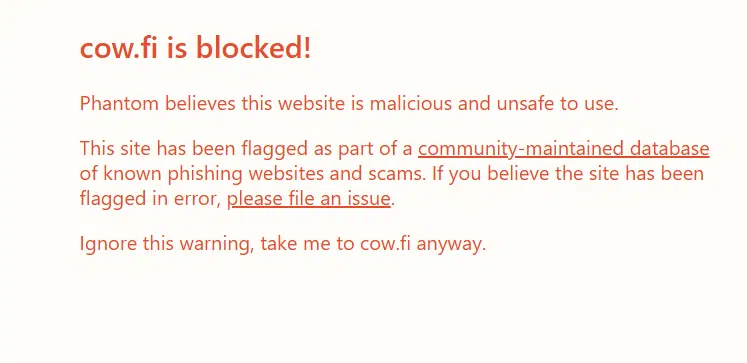

- Wymuszanie trybów bezpiecznych, ostrzeganie przy OAuth z nadmiernymi uprawnieniami do niezatwierdzonych aplikacji; blokada znanych technik typosquattingu i stron ML-owo podejrzanych.

- Hardening agenta AI

- W przeglądarkach z AI: widoczne wskaźniki autentyczności UI (origin/issuer), „secure attention sequence” przed wykonaniem instrukcji wysokiego ryzyka; włączanie restrykcji Atlasa to za mało—pamiętaj, iż spoofing omija te warstwy.

- Szkolenia

- „Zasada nieufności do UI AI”: jeżeli pasek boczny instruuje do logowania, instalacji, poleceń systemowych — weryfikuj domenę i proś o wgląd w pełny URL; nigdy nie wykonuj bezpośrednio komend z UI. (Wskaż użytkownikom różnice między oficjalnym a „pływającym” panelem).

Dla użytkowników końcowych:

- Instaluj rozszerzenia tylko z listy firmowej; sprawdzaj wydawcę i repozytorium.

- Przed logowaniem/zakupem kliknij ikonę kłódki i porównaj pełny FQDN.

- Kopiuj komendy do edytora i czytaj je, zanim trafią do terminala; zwróć uwagę na curl | sh, nc, bash -c, długie base64.

- Gdy UI AI prosi o OAuth z szerokim dostępem (np. full access to Gmail/Drive) – przerwij i skonsultuj z IT.

Różnice / porównania z innymi przypadkami (jeśli dotyczy)

- Prompt/indirect injection vs UI spoofing: w pierwszym atakujesz model (logikę), w drugim percepcję użytkownika (interfejs) – co bywa skuteczniejsze, bo nie wymaga złamania sandboxu ani uprawnień agenta.

- CometJacking/automatyzacja agentów (LayerX) wpływała na działania AI w ramach legalnego interfejsu; Sidebar Spoofing tworzy fałszywy interfejs, przez co ofiara nie zauważa, iż nie rozmawia z prawdziwym agentem.

Podsumowanie / najważniejsze wnioski

AI Sidebar Spoofing to atak na zaufanie do interfejsu AI. choćby przy restrykcjach Atlasa, które ograniczają możliwości agenta, złośliwe rozszerzenie może całkowicie ominąć te bariery, podsuwając fałszywe instrukcje w „znanym” UI i prowadząc do poważnych incydentów (phishing, OAuth, RCE). Organizacje powinny traktować rozszerzenia jak kod o wysokim ryzyku, wdrożyć polityki przeglądarkowe i telemetrię specyficzną dla AI – oraz szkolić użytkowników, by nie ufać bezkrytycznie paskom bocznym AI.

Źródła / bibliografia

- SecurityWeek: „AI Sidebar Spoofing Puts ChatGPT Atlas, Perplexity Comet and Other Browsers at Risk” (23 paź 2025). (SecurityWeek)

- SquareX Labs: „AI Sidebar Spoofing: Malicious Extensions Impersonates AI Browser Interface” (16 paź 2025). (SquareX Labs)

- BleepingComputer: „Spoofed AI sidebars can trick Atlas, Comet users into dangerous actions” (23 paź 2025). (BleepingComputer)

- OpenAI: „Introducing ChatGPT Atlas” – sekcja o zabezpieczeniach agenta (ok. 21–22 paź 2025). (OpenAI)

- LayerX Security: „CometJacking…” – szerszy kontekst ryzyk przeglądarek AI (4 paź 2025). (LayerX)