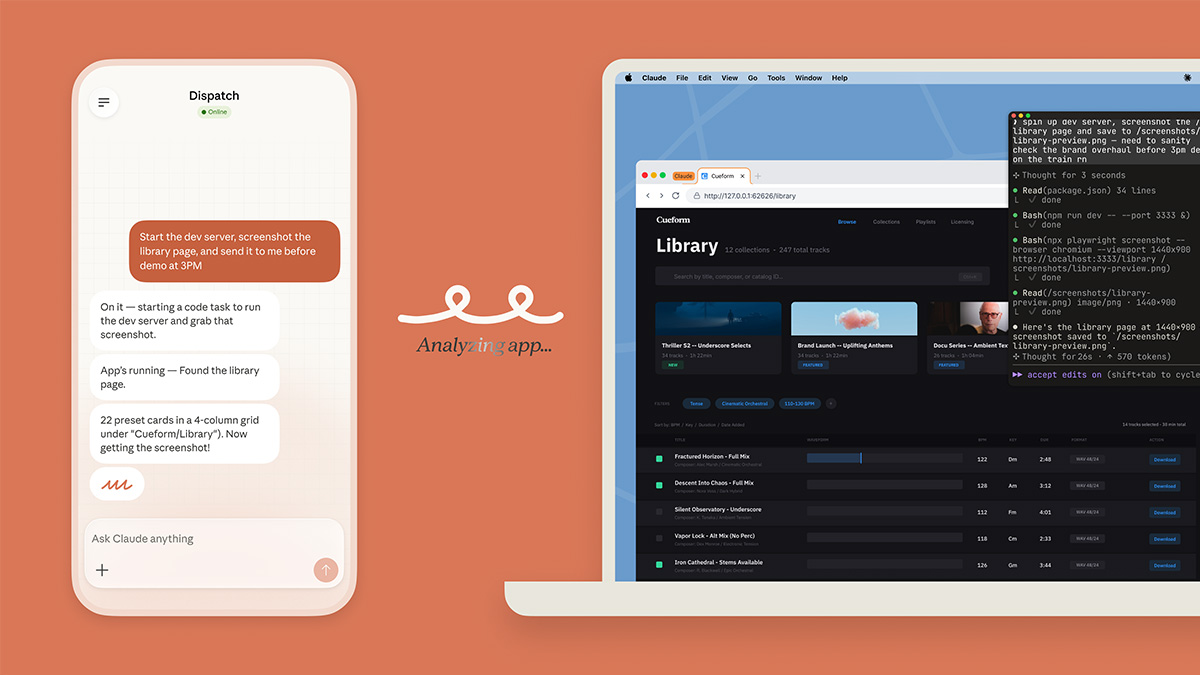

Sztuczna inteligencja wchodzi w nową fazę rozwoju – coraz częściej nie jest już usługą kupowaną w chmurze, ale strategiczną infrastrukturą budowaną przez same firmy. Jak wynika z najnowszych analiz inwestycje w Fabryki AI sięgają dziś miliardów dolarów. Check Point wprowadza nową usługę, która ma ochronić ten najważniejszy element firm.

Fabryki AI to centra danych oparte na klastrach GPU, tworzące modele językowe i gromadzące ogromne zbiory danych. Eksperci coraz częściej mówią o „fabrykach AI” jak o nowym rodzaju infrastruktury krytycznej. To właśnie tam powstają modele, które napędzają decyzje biznesowe, automatyzację i przewagę konkurencyjną. Pojawia się pytanie: kto i jak ma chronić „fabryki AI”, które stają się jednym z najcenniejszych aktywów przedsiębiorstw?

Eksperci ostrzegają, iż środowiska AI różnią się diametralnie od tradycyjnych centrów danych. Łączą w sobie wysokowydajne klastry GPU, rozproszone systemy trenowania modeli, hurtownie danych i interfejsy API działające w czasie rzeczywistym. Każdy z tych elementów tworzy nową powierzchnię ataku. – Infrastruktura AI stała się jednym z najcenniejszych i jednocześnie najbardziej narażonych zasobów przedsiębiorstw. Ochrona tych inwestycji nie może być dodatkiem, ale fundamentem – mówi Nataly Kremer, Chief Product Officer w firmie Check Point.

Firmy mają do czynienia z nowymi rodzajami zagrożeń – od fałszowania danych treningowych, przez kradzież modeli, po ataki na zapytania kierowane do modeli językowych (tzw. prompt injection). Do tego dochodzą klasyczne ryzyka, jak naruszenia łańcucha dostaw czy niekontrolowany ruch wewnątrz środowisk kontenerowych.

W odpowiedzi na te wyzwania firma Check Point zaprezentowała architekturę zabezpieczeń dla tzw. AI Factory – kompleksowy model ochrony infrastruktury AI „od sprzętu po zapytanie do modelu”. Kluczowa zmiana polega na odejściu od podejścia reaktywnego. Zamiast wykrywać incydenty po fakcie, systemy bezpieczeństwa mają być projektowane równolegle z infrastrukturą – zgodnie z zasadą „secure by design”. Na podstawie kontroli ruchu sieciowego, aplikacji i modeli językowych, rozwiązanie pozwoli ‘’przewidzieć’’ zagrożenia i zabezpieczyć na poziomie sprzętowym.

– AI Factory Security Blueprint to sposób, w jaki pomagamy organizacjom chronić inwestycje w Fabryki AI — nie jako coś dodanego na końcu, ale od podstaw, na każdym poziomie całej architektury systemu – podkreśla Nataly Kremer.

Cztery warstwy ochrony

Nowoczesne podejście do zabezpieczania AI opiera się na kilku kluczowych poziomach.

Pierwszy to warstwa brzegowa, gdzie kontrolowany jest cały ruch wchodzący i wychodzący z infrastruktury – zgodnie z modelem Zero Trust. Każde połączenie musi być zweryfikowane.

Drugi poziom obejmuje aplikacje i modele językowe LLM. To tutaj pojawiają się nowe typy ataków, takie jak manipulowanie zapytaniami czy próby wyciągnięcia wrażliwych danych z modeli.

Trzeci to sama infrastruktura – serwery, akceleratory GPU i układy przetwarzania danych. Coraz częściej zabezpieczenia są integrowane bezpośrednio na poziomie sprzętu, co pozwala chronić systemy bez obciążania ich wydajności. Check Point – w ścisłej współpracy z firmą NVIDIA – integruje swoje zapory sieciowe i mechanizmy zapobiegania zagrożeniom bezpośrednio z jednostkami przetwarzania danych NVIDIA BlueField (DPU), wykorzystując platformę programową NVIDIA DOCA. Dzięki temu zapewnia przyspieszone sprzętowo, wbudowane zabezpieczenia na poziomie infrastruktury.

Czwarty poziom to środowiska kontenerowe i workloady, gdzie najważniejsze znaczenie ma kontrola ruchu wewnętrznego i izolowanie zagrożeń, zanim rozprzestrzenią się w całym systemie.

Regulacje przyspieszają zmiany

Rozwój AI nie odbywa się w próżni regulacyjnej. W Europie wchodzi w życie AI Act, który nakłada na firmy konkretne obowiązki w zakresie zarządzania ryzykiem i przejrzystości działania systemów. Nie bez znaczenia są istniejące regulacje, takie jak RODO czy standardy branżowe, które wymagają kontroli danych i odpowiedzialności za decyzje podejmowane przez systemy AI. Podobne trendy widać w regionie Azji i Pacyfiku, gdzie rośnie nacisk na lokalne przetwarzanie danych i bezpieczeństwo infrastruktury.

W efekcie bezpieczeństwo AI przestaje być domeną działów IT, a trafia na poziom zarządów i rad nadzorczych.

Ryzyko biznesowe, nie tylko technologiczne

Dla firm stawka jest wysoka. Utrata modelu AI lub manipulacja jego działaniem może oznaczać nie tylko straty finansowe, ale też utratę reputacji czy przewagi konkurencyjnej. Dlatego inwestycje w bezpieczeństwo AI coraz częściej są traktowane nie jako koszt, ale jako element strategii biznesowej. W świecie, w którym dane i modele stają się najcenniejszym zasobem, pytanie nie brzmi już „czy inwestować w bezpieczeństwo”, ale „czy możemy sobie pozwolić, by tego nie zrobić”.