Silna sztuczna inteligencja już istnieje – tak twierdzi dyrektor generalny Nvidii. Jednak wystarczyło kilkadziesiąt sekund rozmowy żeby Jensen Huang wycofał się ze swoich słów i nagiął definicję „silnej sztucznej inteligencji”.

Silna sztuczna inteligencja (AGI) to wciąż jeszcze teoretyczny system sztucznej inteligencji, który swoimi zdolnościami, efektywnością i inteligencją przewyższa człowieka. AGI stanowi w tej chwili coś w rodzaju kamienia filozoficznego Doliny Krzemowej i z niecierpliwością wyczekiwany jest moment, kiedy stanie się faktem. Według szefa Jensen Huang – ten moment właśnie nadszedł.

Problem w tym, iż sam zainteresowany chwilę później zaczął się z tej deklaracji wycofywać

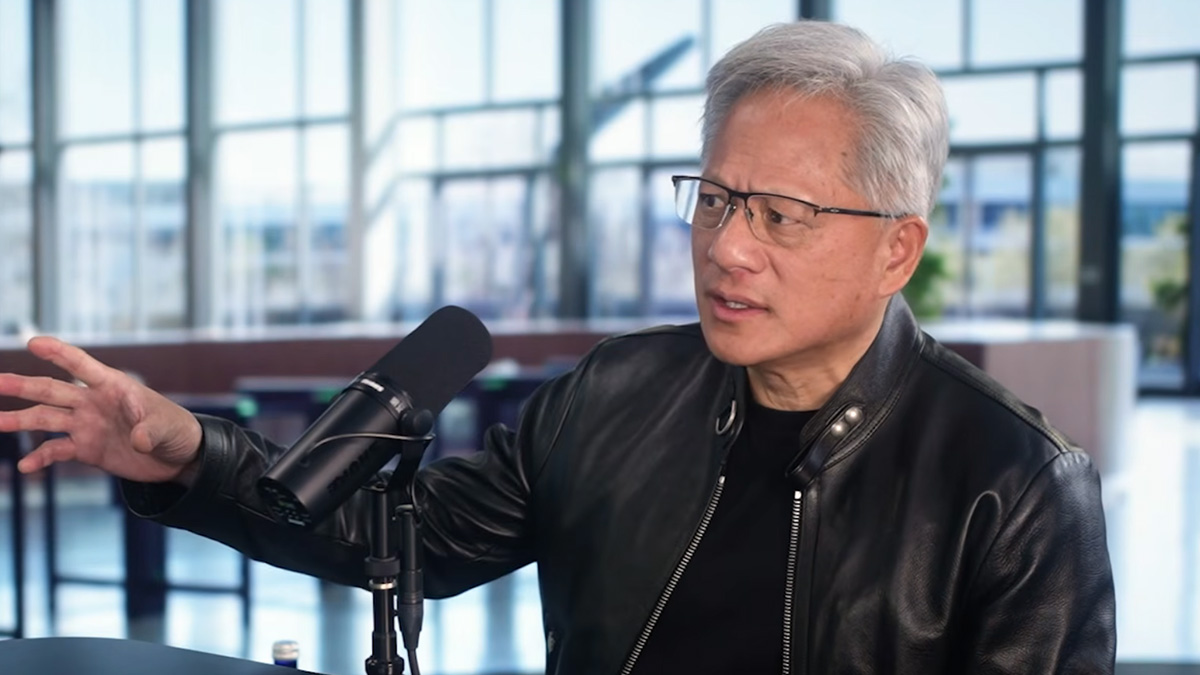

Jensen Huang był gościem podcastu prowadzonego przez Lexa Fridmana, w którym padło jedno z najmocniejszych zdań w całej dotychczasowej debacie o AI: „myślę, iż osiągnęliśmy AGI”. Szef Nvidia odpowiedział w ten sposób na pytanie o to, kiedy powstaną systemy zdolne wykonywać pracę człowieka – w tym prowadzić firmę wartą miliard dolarów. Zamiast typowego dla tego dyskursu wskazania perspektywy pięciu, dziesięciu czy dwudziestu lat, Huang wskazał teraźniejszość.

Stwierdzenie szefa Nvidii jest szczególnie zaskakujące, bo w ostatnich miesiącach wielu liderów branży technologicznej zaczęło dystansować się od samego pojęcia AGI. Sam Altman mówił o „duchowym” osiągnięciu tego etapu, a Satya Nadella podkreślał, iż nie istnieje jednoznaczny moment, w którym można ogłosić taki przełom.

Kluczowe jest jednak to, jak CEO Nvidii rozumie samo AGI. W jego interpretacji nie chodzi o stabilny, uniwersalny system dorównujący człowiekowi we wszystkich zadaniach, ale o zdolność do osiągnięcia konkretnego efektu – na przykład stworzenia aplikacji, która nagle stanie się globalnym sukcesem i wygeneruje miliardowe przychody.

Tak więc AGI w ujęciu Huanga nie musi być trwałe ani niezawodne – wystarczy, iż w określonym momencie osiągnie poziom skuteczności porównywalny z ludzkim działaniem w konkretnym kontekście.

Jednocześnie szef Nvidii gwałtownie ostudził emocje słuchaczy. Bowiem w tej samej rozmowie przyznał, iż większość takich projektów gwałtownie traci zainteresowanie użytkowników, a ich cykl życia jest krótki. Co więcej, wprost stwierdza, iż szanse na to, by autonomiczni agenci AI zbudowały firmę pokroju Nvidii, wynoszą „zero procent”.

Wypowiedź Huanga pokazuje, jak wygląda obecny stan wielkiej AGI

Pojęcie „silnej sztucznej inteligencji” funkcjonuje dziś bardziej jako narzędzie narracyjne niż precyzyjna kategoria technologiczna. AGI z jednej strony napędza inwestycje i buduje oczekiwania względem wielkich firm technologicznych, a z drugiej jest na tyle rozmyty, iż każdy zainteresowany może go wziąć i dopasować do sensu swojej wypowiedzi.

W dalszej części rozmowy Huang próbuje zresztą uporządkować tę niejednoznaczność, rozdzielając inteligencję od człowieczeństwa. Jego zdaniem inteligencja to zestaw funkcji – percepcja, rozumowanie, planowanie – który można zautomatyzować. Emocje, doświadczenie czy świadomość to zupełnie inny wymiar, którego obecne systemy AI nie dotykają.

W efekcie deklaracja „osiągnęliśmy AGI” to bardziej semantyczna prowokacja i próba przyciągnięcia uwagi – bo chyba mało kto zainteresowałby się 110 minutą prawie 150 minutowego podcastu – niż opis rzeczywistego przełomu. jeżeli przyjąć szeroką, pragmatyczną definicję, to można uznać, iż pewne elementy AGI już istnieją. jeżeli jednak trzymać się klasycznego rozumienia jako pełnej, ogólnej inteligencji dorównującej człowiekowi, to przez cały czas jesteśmy daleko od celu. A im dalej jesteśmy, tym większe pole do gimnastyki semantyczno-filozoficznej.

Więcej na temat najbardziej rozmarzonych w Dolinie Krzemowej:

- ChatGPT liczony jak prąd i woda. Szefowi OpenAI odjechał peron

- Bot mówi Zuckerbergowi, jak ma szefować. Może dlatego ma coraz głupsze pomysły

- Szef OpenAI dojeżdża sceptyków. „Musisz jeść 20 lat, nim będziesz mądry”