Podczas wczorajszej prezentacji otwierającej coroczną konferencję Google I/O potentat z Mountain View, Google, zaprezentował zestaw imponujących rozwiązań. Cecha wspólna? AI.

Prezentacja otwierająca, prowadzona przez Sundara Pichaia i jego zespół, skupiła się niemal wyłącznie na sztucznej inteligencji i jej głębszej integracji z produktami firmy. Oto, co najważniejsze, w reporterskim skrócie. Oczywiście większość z ogłoszonych nowości i funkcji trafi w pierwszej kolejności do użytkowników w Stanach Zjednoczonych. Europa, w tym Polska, będzie musiała poczekać na globalne wdrożenia, ale miejmy nadzieję, iż przynajmniej część z nich zawita i do nas. No dobrze, do rzeczy:

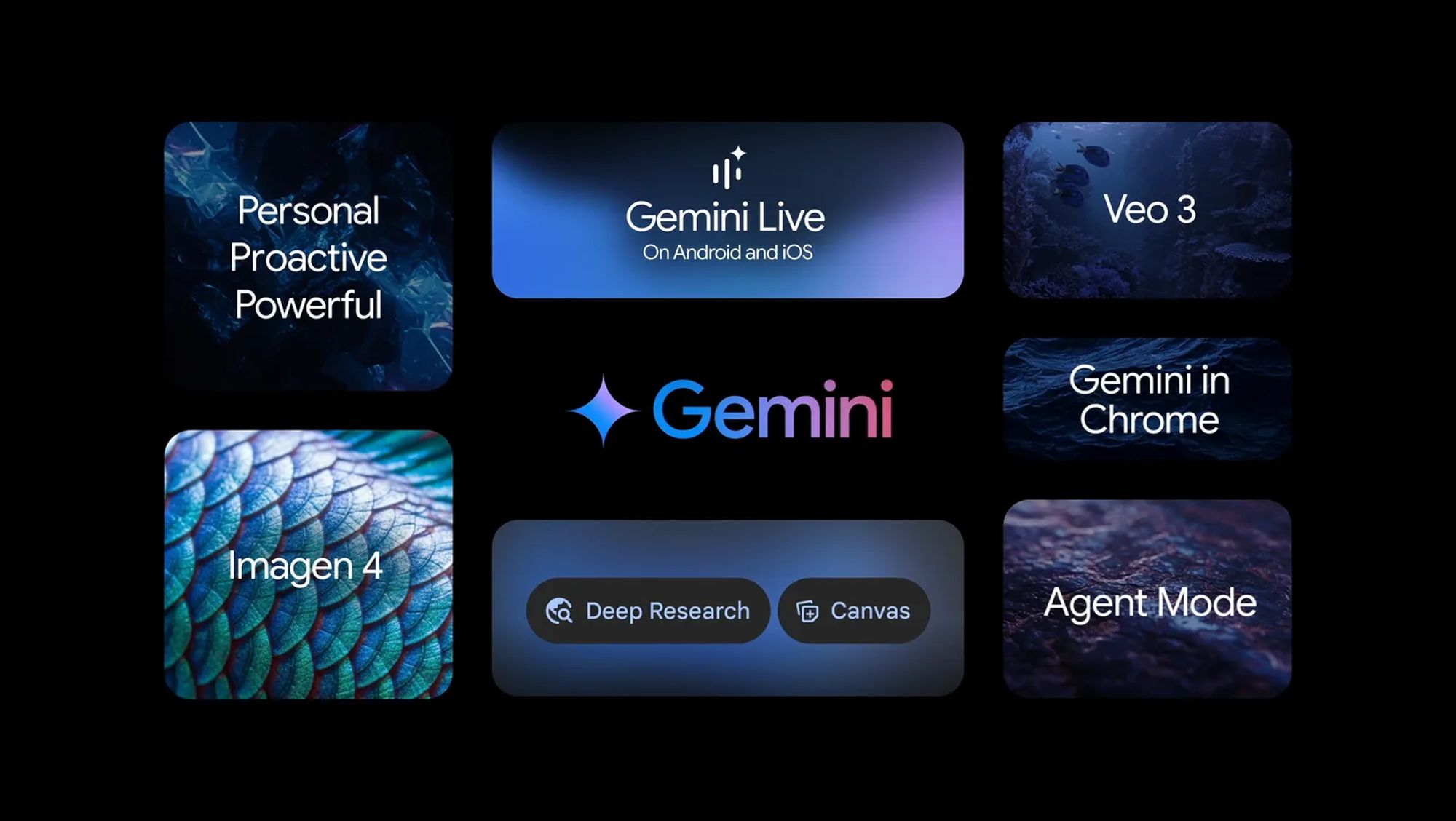

Gemini 2.5 Flash i Gemini 2.5 Pro z Deep Think – mocniejsze serce AI od Google

Google nie zwalnia tempa w rozwijaniu swoich flagowych modeli. Zaprezentowano nowy model Gemini 2.5 Flash, który ma być zoptymalizowany pod kątem szybkości i zadań wymagających niskich opóźnień, przy zachowaniu wysokiej wydajności. W testach LMArena ustępuje ponoć tylko Gemini 2.5 Pro. Ten ostatni z kolei zyskał nowy tryb Deep Think, który wykorzystuje zaawansowane techniki rozumowania, w tym myślenie równoległe, co ma być przydatne m.in. do analizy bardziej złożonych problemów. Rozszerzono także okno kontekstowe dla tych modeli, co pozwala na przetwarzanie większej ilości informacji jednocześnie.

Google Beam – wideorozmowy w 3D

Jedną z bardziej futurystycznych prezentacji było Google Beam. To platforma do komunikacji wideo, która dzięki AI, specjalnemu zestawowi sześciu kamer i wyświetlaczowi typu light-field, ma przekształcać obraz 2D w realistyczne, trójwymiarowe hologramy rozmówcy. System oferuje precyzyjne (do milimetra) śledzenie głowy w czasie rzeczywistym przy prezentacji przestrzennego obrazu z płynnością 60 fps. Technologia ma być dostępna w ramach wczesnego dostępu jeszcze w tym roku, we współpracy z HP. Brzmi jak coś z filmów science-fiction, ale Google twierdzi, iż to przyszłość telekonferencji. Mimo wszystko chyba jednak wolę rozmowę z żywym człowiekiem, głównie dlatego, iż – co pokazała dalsza część konferencji – naprawdę nie możemy być już pewni, iż widziany obraz jest rzeczywisty.

Gemini Live i Tryb Agenta

Pamiętacie Project Astra? Jego możliwości, czyli rozumienie obrazu z kamery i z udostępnianego przez użytkownika ekranu, zostały zintegrowane w Gemini Live. To kolejny krok w stronę bardziej naturalnej, multimodalnej interakcji z AI. Gemini Live z tą funkcją jest już dostępne dla użytkowników Androida, a od 20 maja 2025 trafia na iOS.

Google wprowadza nowe funkcje do Gemini Live – AI widzi otoczenie w czasie rzeczywistym

Nowością w aplikacji Gemini jest także Tryb Agenta (Agent Mode). W tej eksperymentalnej funkcji (dostępnej niedługo dla subskrybentów) Gemini ma proaktywnie pomagać w załatwianiu spraw online – np. znaleźć konkretne oferty na stronach, wypełnić formularze czy choćby umówić spotkanie. Czyżby AI miała niedługo rezerwować nam wakacje? Prezentację przypominającą taki scenariusz również pokazano.

AI w Wyszukiwarce Google – pytaj o wszystko

Google nie byłoby sobą, gdyby nie usprawniło swojej wyszukiwarki. Tryb AI w Wyszukiwarce (AI Mode in Search) ma pozwolić na zadawanie znacznie dłuższych, bardziej złożonych pytań i uzyskiwanie kompleksowych odpowiedzi generowanych przez AI, z możliwością zadawania pytań uzupełniających. Od dziś funkcja jest dostępna dla wszystkich w USA, Google nie ujawniło, kiedy pojawi się w innych regionach.

Veo 3 i Imagen 4 – Google nie odpuszcza w wyścigu generatorów multimediów

W odpowiedzi na rosnącą konkurencję w dziedzinie generowania wideo i obrazów, Google pokazało Veo 3, swój najnowszy model do tworzenia wideo (w tym z natywnie generowanym dźwiękiem, także dialogami!), oraz Imagen 4, najbardziej zaawansowany model do generowania obrazów, jaki kiedykolwiek firma opracowała. Oba narzędzia mają być dostępne w aplikacji Gemini. Dla filmowców dodatkowo przygotowano narzędzie Flow, które ma ułatwiać tworzenie kinowych ujęć i rozbudowywanie krótkich klipów w dłuższe sceny.

Gmail z Gemini napisze Ci maila, a Meet przetłumaczy rozmowę Twoim głosem

Sztuczna inteligencja jeszcze głębiej wejdzie w Google Workspace. Spersonalizowane Inteligentne Odpowiedzi w Gmailu mają wykorzystywać Gemini do analizy poprzednich maili i plików na Dysku, by sugerować odpowiedzi dopasowane stylem i tonem do użytkownika, a choćby zawierające konkretne detale. Funkcja trafi do subskrybentów jeszcze w tym roku.

Z kolei Google Meet zaoferuje zaawansowane „tłumaczenie mowy”, które nie tylko przełoży wypowiedzi na inny język w czasie rzeczywistym, ale także postara się naśladować głos, ton i ekspresję mówiącego. Tłumaczenie na angielski i hiszpański rusza w wersji beta dla subskrybentów Google AI Pro i Ultra, a klienci biznesowi Workspace dostaną dostęp testowy w tym roku. Poniższe wideo prezentuje to rozwiązanie. Pozostałe języki? Będą. Kiedy? Cierpliwości.

Ironwood – nowe, potężne układy TPU dla AI

Za tymi wszystkimi możliwościami AI musi stać potężna infrastruktura. Google zapowiedziało chipy Ironwood, siódmą generację swoich układów Tensor Processing Unit (TPU). Mają one oferować aż 10-krotny wzrost wydajności w porównaniu z poprzednią generacją (osiągając 42,5 exaflopów mocy obliczeniowej na klaster) i są specjalnie zaprojektowane do obsługi zadań związanych z wnioskowaniem i „myśleniem” w modelach AI na dużą skalę.

Tyle w telegraficznym skrócie. Tegoroczne I/O pokazało, iż Google stawia wszystko na jedną kartę – sztuczną inteligencję. Zobaczymy, ile z tych obietnic i zapowiedzi faktycznie przełoży się na użyteczne i globalnie dostępne funkcje w nadchodzących miesiącach.

Jeśli artykuł Google I/O 2025 – co nowego pokazało Google? nie wygląda prawidłowo w Twoim czytniku RSS, to zobacz go na iMagazine.