W dobie coraz większych ekranów i intensywnego korzystania z mediów społecznościowych wielu z nas odczuwa przeciążenie kciuków. Rozwiązaniem mogą okazać się nowe techniki sterowania urządzeniami, w tym eye-tracking, czyli śledzenie ruchu gałek ocznych. Badania zespołu z Uniwersytetu w Glasgow pokazują, iż odpowiednio zaprojektowane interfejsy mobilne pozwalają na całkiem precyzyjną obsługę telefonów dzięki wzroku.

Eye-tracking już nie tylko dla osób z niepełnosprawnościami

Funkcje związane ze śledzeniem wzroku pojawiły się już w niektórych urządzeniach, w tym w iPhone’ach od Apple, gdzie były początkowo przeznaczone głównie dla osób z niepełnosprawnościami ruchowymi. Mimo to wciąż działają one w ograniczonym zakresie. Aby uzyskać dobrą dokładność, telefon musi być ułożony stabilnie, a użytkownik powinien znajdować się w idealnych warunkach oświetleniowych.

Dr Mohamed Khamis z Uniwersytetu w Glasgow, wraz z zespołem badaczy, pracuje nad tym, by podobne technologie mogły funkcjonować w różnych codziennych sytuacjach. Ich zdaniem śledzenie oczu powinno być zawsze dostępne, niezależnie od tego, w jakiej sytuacji się znajdujemy.

Jak zaprojektować ekran przyjazny wzrokowi?

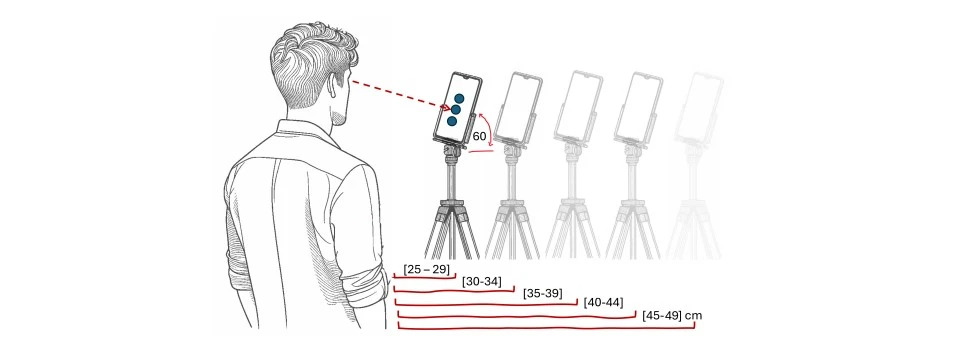

Podczas eksperymentów przeprowadzonych na grupie 24 ochotników (w wieku od 22 do 44 lat), uczestnicy korzystali z iPhone’a X ustawionego w różnych pozycjach. Były to odległości od 49 cm do 25 cm od twarzy. Badacze wprowadzali zmiany w rozmiarze, kształcie i położeniu interaktywnych elementów na ekranie, aby sprawdzić, które konfiguracje najlepiej wspierają śledzenie wzroku.

Związek między rozmiarem celu, obszarem docelowym i odległością między użytkownikiem a ekranem / Źródło: mkhamis.com

Związek między rozmiarem celu, obszarem docelowym i odległością między użytkownikiem a ekranem / Źródło: mkhamis.comZebrane dane pozwoliły stwierdzić, iż najlepsze efekty przynosi stosowanie elementów o wysokości odpowiadającej około 4 stopniom pola widzenia użytkownika. Przy typowej odległości telefonu od oczu, taka wielkość zapewniała do 70% dokładności identyfikacji miejsca, w które patrzy użytkownik, nie zabierając jednocześnie zbyt dużo miejsca na ekranie. Czułość kamer jest wyższa przy ruchu gałek ocznych w poziomie niż przy poruszaniu wzrokiem w górę i w dół. W praktyce oznacza to, iż nawigacja poprzez „przesuwanie” wzroku w bok – niczym gesty na ekranie dotykowym – może działać skuteczniej niż próby klikania elementów na górze czy dole ekranu.

Ważne jest unikanie interaktywnych elementów w skrajnych górnych i dolnych strefach ekranu, gdzie śledzenie wzroku okazywało się mniej dokładne. Dodanie niewidocznych „buforów” wokół przycisków czy ikonek również pomagało w wychwyceniu ruchu gałki ocznej. Dokładność spadała w miarę przybliżania telefonu do twarzy – w najkrótszej odległości (ok. 25 cm) kamery miały największe trudności z poprawnym ustaleniem punktu, na który patrzy użytkownik.

Błąd przesunięcia obliczany jest pomiędzy średnią szacowanych punktów patrzenia a granicą obszaru docelowego osobno dla współrzędnych x i y / Źródło: mkhamis.com

Błąd przesunięcia obliczany jest pomiędzy średnią szacowanych punktów patrzenia a granicą obszaru docelowego osobno dla współrzędnych x i y / Źródło: mkhamis.comPo co nam „bezdotykowe” sterowanie?

Może się wydawać, iż rezygnacja z dotyku to zbędna komplikacja w czasach, gdy gesty i przyciski wirtualne są powszechnie dostępne. Jednak zespół dr. Khamisa zwraca uwagę, iż istnieje wiele sytuacji, w których nie koniecznie chcemy korzystać z ekranu dotykowego:

- Praca w ochronnych rękawicach – na przykład w szpitalach, laboratoriach czy branżach produkcyjnych, gdzie konieczna jest sterylność i bezpieczeństwo.

- Podróże – trzymanie się poręczy w zatłoczonym transporcie może utrudniać jednoczesne korzystanie z ekranu telefona.

- Ograniczenia ruchowe – dla osób z niepełnosprawnościami to ogromne ułatwienie w codziennej komunikacji.

- Względy higieniczne – w środowisku szpitalnym lub w czasie pandemii kontakt rąk z powierzchnią telefonu może zwiększać ryzyko przenoszenia bakterii i wirusów.

Elastyczna przyszłość interfejsów

Wnioski przedstawione w artykule zatytułowanym „Rozciąganie celów wzrokowych: eksperymentowanie z rozmiarami celów dla interfejsów obsługujących wzrok na urządzeniach mobilnych” stanowią kolejny krok w kierunku pełniejszego wykorzystania eye-trackingu na urządzeniach mobilnych. Następnie planowane badania to automatyczne zmiany rozmiaru elementów ekranu w zależności od oddalenia telefonu od twarzy użytkownika.

Tego typu inteligentne rozwiązania mogą sprawić, iż elementy będą się dynamicznie kurczyć, gdy urządzenie znajdzie się bliżej. A gdy odległość się zwiększy, będą się powiększać. Dzięki temu cały proces stanie się bardziej precyzyjny i uniwersalny, a w konsekwencji – rzeczywiście „zawsze włączony” w codziennym użytkowaniu. Badania zespołu z Glasgow prezentowane będą na konferencji CHI w Jokohamie (Japonia) pod koniec kwietnia. jeżeli zapowiedzi naukowców okażą się trafione, za kilka lat może się okazać, iż nasze telefony zaczną reagować na spojrzenia równie skutecznie, co na dotyk.