Wprowadzenie do problemu / definicja luki

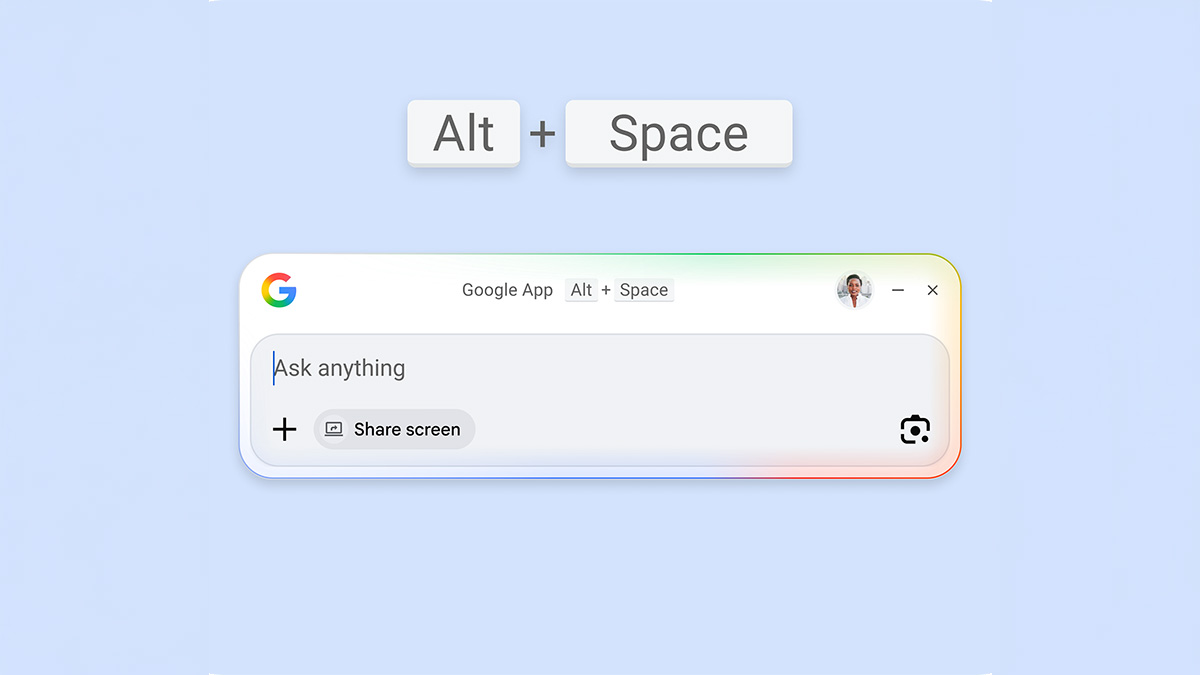

Rynek narzędzi „AI sidebar / AI assistant” w przeglądarce rośnie błyskawicznie, a wraz z nim rośnie pokusa nadużyć. Najnowsze ustalenia Microsoft Defender pokazują kampanię złośliwych rozszerzeń Chromium (Chrome/Edge), które podszywają się pod legalne asystenty AI i masowo zbierają treści rozmów z LLM oraz historię przeglądania. najważniejsze ryzyko nie polega tu na „efektownym exploicie”, tylko na tym, iż użytkownicy sami instalują dodatek, często w środowisku firmowym, a potem wklejają do okna czatu wrażliwe dane (kod, procedury, koncepcje produktowe, dane klientów).

W skrócie

- Microsoft opisuje kampanię z ~900 tys. instalacji oraz sygnały aktywności w ponad 20 tys. tenantów enterprise.

- Rozszerzenia zbierały pełne URL-e (w tym wewnętrzne) oraz fragmenty rozmów z platform takich jak ChatGPT i DeepSeek.

- Dane były cyklicznie wysyłane metodą HTTPS POST do domen m.in. deepaichats[.]com, chatsaigpt[.]com (oraz wskazywanych wildcardów).

- W kampanii pojawiają się konkretne ID rozszerzeń wykorzystywane w huntingu i detekcji.

Kontekst / historia / powiązania

To nie jest odosobniony przypadek. Już pod koniec 2025 r. OX Security opisało niemal identyczny motyw: fałszywe rozszerzenia podszywające się pod legalny produkt (AITOPIA), które eksportowały rozmowy z ChatGPT/DeepSeek oraz listę odwiedzanych kart, a jedna z próbek miała choćby wyróżnienie w sklepie.

Równolegle w 2026 r. badacze (m.in. opisywani przez Malwarebytes) zwracali uwagę na inną klasę zagrożeń: rozszerzenia kradnące tokeny sesji ChatGPT, co umożliwia przejęcie konta i dostęp do historii/metadanych.

W tle rośnie jeszcze jedno zjawisko: „agentic” funkcje w przeglądarkach i asystentach webowych rozszerzają powierzchnię ataku (np. wątki o eskalacji uprawnień w komponentach asystenta i nadużyciach przez rozszerzenia).

Analiza techniczna / szczegóły

1. Łańcuch ataku (wg Microsoft)

Microsoft opisuje „klasyczny” łańcuch dla złośliwego rozszerzenia, gdzie największą rolę gra socjotechnika i architektura uprawnień Chromium:

- Recon: wybór popularnej niszy „AI assistant”, analiza legalnych dodatków (np. AITOPIA) i skopiowanie brandingu oraz zachowań instalacyjnych.

- Delivery: dystrybucja przez Chrome Web Store, z naturalnym „przenikaniem” także do Edge (obsługa dodatków Chrome).

- Exploitation (w sensie operacyjnym): po instalacji dodatek wykorzystuje model uprawnień rozszerzeń i zaczyna zbierać dane bez kolejnych kliknięć.

- C2/Exfil: okresowe wysyłki HTTPS POST na infrastrukturę atakujących (deepaichats[.]com, chatsaigpt[.]com itd.).

2. Co dokładnie było zbierane

Według Microsoft złośliwe rozszerzenie:

- logowało niemal wszystkie odwiedzane URL-e (w tym zasoby intranetowe),

- przechwytywało wycinki wiadomości czatu (prompty i odpowiedzi) z narzędzi LLM,

- zapisywało dane lokalnie jako Base64-encoded JSON, a potem wysyłało je na zewnątrz,

- dołączało m.in. kontekst nawigacji, nazwy modeli, oraz trwały UUID (identyfikator sesji/instalacji).

3. „Zgoda” jako mechanizm kamuflażu

Ciekawy element opisu Microsoft to mechanika „konsentu”: użytkownik mógł początkowo wyłączyć zbieranie danych, ale aktualizacje miały automatycznie przywracać telemetrię (re-enable), co w praktyce tworzyło trwały kanał wycieku przy minimalnej widoczności dla ofiary.

4. Twarde artefakty: domeny i identyfikatory

Microsoft podaje znane endpointy/domeny do monitoringu oraz ID rozszerzeń używane w przykładowych zapytaniach huntingowych:

- Domeny/C2 do obserwacji: chatsaigpt.com, deepaichats.com, chataigpt.pro, chatgptsidebar.pro (oraz wildcards).

- Przykładowe ID: fnmihdojmnkclgjpcoonokmkhjpjechg, inhcgfpbfdjbjogdfjbclgolkmhnooop.

Praktyczne konsekwencje / ryzyko

Dla organizacji to jest przede wszystkim problem DLP i tajemnicy przedsiębiorstwa:

- Wycieki kodu i IP: prompty często zawierają fragmenty repo, logi, konfiguracje, architekturę.

- Mapowanie środowiska: pełne URL-e (w tym wewnętrzne) ujawniają nazwy systemów, ścieżki aplikacji, czasem identyfikatory zasobów lub tenantów.

- Ryzyko zgodności: jeżeli w promptach/odpowiedziach lądują dane osobowe lub kontraktowe, organizacja może „nieświadomie” uruchomić incydent naruszenia.

- Trwałość: rozszerzenie „żyje” tak długo, jak przeglądarka i profil użytkownika — bez klasycznych wskaźników infekcji endpointu.

Rekomendacje operacyjne / co zrobić teraz

1. Szybkie działania (0–24h)

- Audyt rozszerzeń w przeglądarkach firmowych (Chrome/Edge) + identyfikacja dodatków AI/sidebar. Microsoft rekomenduje użycie funkcji oceny rozszerzeń w Defender VM.

- Blokada ruchu do wskazanych domen (proxy/SWG/DNS/EDR Network Protection) i przegląd logów POST/HTTPS.

- Weryfikacja instalacji po ID: polowanie po ExtensionId i ścieżkach katalogów profilu przeglądarki (Windows).

- Komunikat do użytkowników: natychmiastowe usunięcie niezweryfikowanych „AI assistant” + krótkie zasady użycia LLM (czego nie wklejać do promptów).

2. Detekcja i hunting (praktycznie)

Microsoft publikuje gotowe przykłady zapytań (Microsoft Defender XDR), m.in.:

- wykrywanie uruchomień przeglądarki z parametrami zawierającymi znane ID,

- wykrywanie połączeń do domen kampanii,

- enumeracja instalacji w tabeli DeviceTvmBrowserExtensions,

- wykrywanie artefaktów na dysku w folderach profilu Chrome/Edge.

Jeśli nie korzystasz z Defender XDR, przełóż to 1:1 na:

- reguły w SIEM (DNS/Proxy/Firewall) na domeny,

- IOC w EDR dla ścieżek katalogów rozszerzeń,

- polityki Browser Management (allowlist/denylist rozszerzeń).

3. Kontrole długoterminowe (policy + technologia)

- Allowlist rozszerzeń (preferowane) zamiast „każdy może instalować wszystko”.

- Microsoft Defender SmartScreen + Network Protection (Microsoft wskazuje je jako warstwę blokowania).

- Purview / kontrola przepływu danych dla aplikacji GenAI: w praktyce chodzi o to, by prompt i odpowiedź były traktowane jak kanał danych (klasyfikacja, DLP, zasady).

- Zasady użycia AI: minimalny standard to „prompt hygiene”, etykietowanie danych, zakaz wklejania sekretów i fragmentów kluczy/tokenów.

Różnice / porównania z innymi przypadkami

Warto rozróżnić dwa popularne modele ataku na „AI w przeglądarce”:

- Telemetria/Podsłuch (ten przypadek)

- celem jest ciągłe zbieranie: URL-e + treści czatów, często „po cichu”, długoterminowo, z UUID.

- Kradzież tokenów sesji / przejęcie konta

- rozszerzenie kradnie token uwierzytelnienia (np. do ChatGPT), co daje możliwość przejęcia tożsamości i wglądu w historię konta. Takie kampanie opisywano m.in. w kontekście zestawu złośliwych dodatków dla Chrome/Edge.

Oba scenariusze kończą się podobnie (wyciek treści), ale różnią się tym, gdzie powstaje szkoda: lokalnie w przeglądarce (podsłuch) vs „po stronie usługi/konta” (token).

Podsumowanie / najważniejsze wnioski

- „AI assistant” w formie rozszerzenia to dziś jeden z najłatwiejszych kanałów wycieku danych: wystarczy instalacja i szerokie uprawnienia.

- Skala jest realna: Microsoft mówi o ~900 tys. instalacji i aktywności w >20 tys. tenantów, co wskazuje na istotny wymiar enterprise.

- Najlepsza obrona to połączenie allowlisty rozszerzeń, monitoringu domen/C2, i zasad użycia LLM (prompt hygiene + DLP).

Źródła / bibliografia

- Microsoft Security Blog (Microsoft Defender Security Research Team) – „Malicious AI Assistant Extensions Harvest LLM Chat Histories” (05.03.2026). (Microsoft)

- OX Security – „900K Users Compromised: Chrome Extensions Steal ChatGPT and DeepSeek Conversations” (30.12.2025). (OX Security)

- Malwarebytes – „Malicious Chrome extensions can spy on your ChatGPT chats” (28.01.2026). (Malwarebytes)

- TechRadar (na podstawie LayerX/BleepingComputer) – kampanie fałszywych rozszerzeń GenAI i masowe eksfiltracje treści (luty 2026). (TechRadar)

- ITPro – przykład ryzyk związanych z asystentami w przeglądarce i nadużyciami przez rozszerzenia (CVE-2026-0628 / Gemini Live). (IT Pro)