Do napisania poniższego artykułu skłoniła mnie seria analiz związanych z dezinformacją z jakimi miałem okazję zapoznać się w ostatnim czasie w naszym kraju.

%20a%20dezi.webp)

Czym jest analiza kontentu i co można dzięki niej osiągnąć?

W dużym uproszczeniu analiza kontentu to proces badania treści publikowanych w internecie, szczególnie w mediach społecznościowych, w celu wykrycia dezinformacji, manipulacji czy propagandy. Wykorzystuje ona różne techniki, takie jak analiza językowa, rozpoznawanie fałszywych informacji czy wykrywanie schematów publikowania treści. Dzięki niej można starać się identyfikować fake newsy, szkodliwe narracje oraz próbować ograniczyć rozprzestrzenianie się nieprawdziwych treści.

Media społecznościowe stały się głównym kanałem rozpowszechniania informacji, co sprawia, iż analiza treści jest jednym z narzędzi stosowanych w walce z dezinformacją. Jednak ograniczenie się wyłącznie do analizy kontentu daje niepełny obraz problemu i nie pozwala na skuteczne zwalczanie fałszywych informacji. Poniżej kilka przykładów.

Czego nie można sprawdzić analizą kontentu:

1. Powiązań między kontami

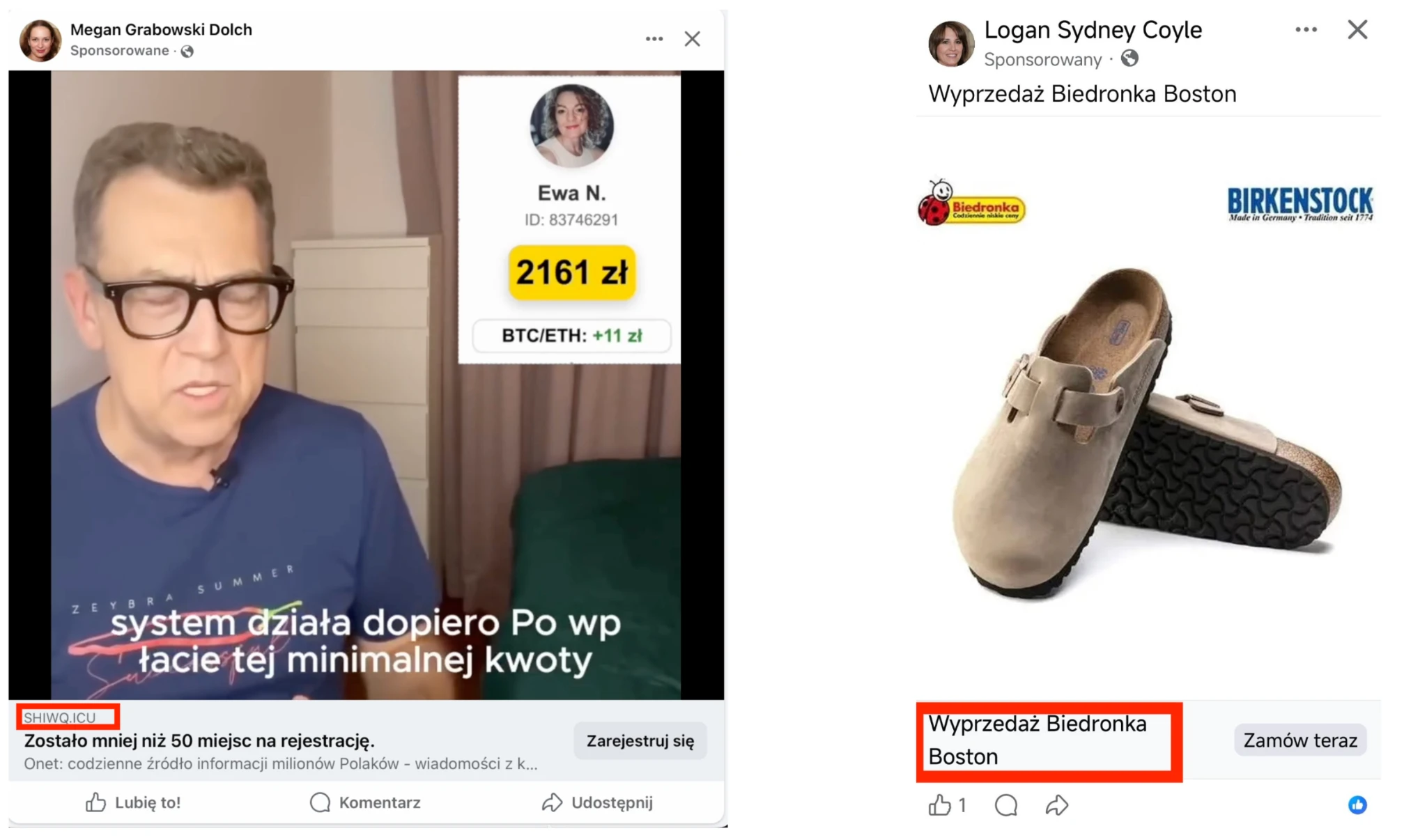

Analiza kontentu koncentruje się na treści publikacji, ale nie uwzględnia sieci powiązań między kontami. Dezinformacja często działa w sposób skoordynowany z wykorzystaniem grup kont (np. botów lub farm trolli), które współpracują, aby zwiększyć zasięg fałszywych informacji.

Przykład: Podczas wojny w Ukrainie rosyjskie farmy trolli wykorzystywały tysiące fałszywych kont do szerzenia propagandy prorosyjskiej, manipulując opinią publiczną w Europie i USA. Analiza pojedynczych treści nie wykazałaby ich skoordynowanej aktywności.

2. Analizy przepływu informacji i jej zasięgi

Dezinformacja nie jest statyczna – zmienia się i ewoluuje w czasie, dostosowując się do nowych warunków. Analiza kontentu nie jest w stanie prześledzić, jak dana narracja przemieszcza się przez różne platformy i jak wpływa na opinię publiczną.

Przykład: Po rozpoczęciu rosyjskiej inwazji na Ukrainę w 2022 roku, w mediach społecznościowych gwałtownie zaczęła rozprzestrzeniać się fałszywa narracja o rzekomych zdjęciach i filmach dokumentujących ukraińskie ataki na ludność cywilną. Początkowo informacje te pojawiły się na rosyjskich kanałach Telegram, skąd przeniknęły na Twittera i Facebooka, a następnie były powielane przez zagraniczne konta influencerów i niektóre media, wpływając na postrzeganie konfliktu przez opinię publiczną. Analiza samej treści tych komunikatów nie pozwoliła na pełne prześledzenie ich dynamiki i zasięgu między platformami.

3. Lokalizacji kont w mediach społecznościowych oraz ich pełnych danych

Dezinformacja jest często prowadzona przez podmioty zagraniczne, które starają się wpływać na wewnętrzne sprawy innych krajów. Analiza kontentu nie pozwala określić rzeczywistej lokalizacji konta a fałszywi użytkownicy często korzystają z VPN-ów oraz innych sposobów, aby ukryć swoje pochodzenie i dane.

Przykład: Podczas protestów w Hongkongu wiele kont w mediach społecznościowych publikowało treści wspierające chińską narrację. Po dalszej analizie okazało się, iż były one zarządzane z farm trolli w Chinach.

4. Działań pod fałszywą flagą

Dezinformatorzy często stosują taktykę podszywania się pod inne grupy, aby wywołać chaos lub wprowadzić fałszywe oskarżenia. Analiza kontentu nie jest w stanie zidentyfikować, kto rzeczywiście stoi za danym przekazem.

Przykład: W 2022 roku pojawiły się doniesienia o możliwych operacjach pod fałszywą flagą prowadzonych przez Rosję w separatystycznym regionie Naddniestrza. Celem tych działań miała być destabilizacja sytuacji w Mołdawii.

Inne ograniczenia analizy kontentu (prowadzonej przy wykorzystaniu algorytmów)

Brak kontekstu – Analiza kontentu nie zawsze uwzględnia kontekst wypowiedzi. Ironia, sarkazm czy ukryte znaczenia mogą prowadzić do błędnych wniosków.

Nieefektywność wobec nowych narracji – Systemy wykrywające dezinformację często bazują na znanych wzorcach. Nowe kampanie mogą przechodzić niewykryte.

Nieodróżnianie intencji – Algorytmy analizujące treść nie są w stanie rozróżnić, czy dana osoba świadomie szerzy dezinformację, czy jedynie powiela błędne informacje.

Podsumowanie: Dlaczego analiza kontentu jest niewystarczająca?

Analiza kontentu pozwala na wykrywanie fałszywych informacji, ale nie umożliwia identyfikacji kluczowych mechanizmów ich rozprzestrzeniania. Pomija takie aspekty jak skoordynowane kampanie dezinformacyjne, operacje wpływu, powiązania między kontami, analiza zasięgów i reakcji użytkowników, a także identyfikacja podmiotów stojących za dezinformacją.

Przykład błędnych wniosków:

Jeśli analiza treści wykrywa dezinformację w pojedynczym poście, ale nie bada, kto go udostępniał, może przeoczyć rzeczywistych organizatorów kampanii.

Algorytmy mogą błędnie oznaczyć satyryczne treści jako fake newsy, co prowadzi do cenzurowania nieszkodliwych materiałów.

Ignorowanie skoordynowanych działań może sprawić, iż fałszywe narracje będą szerzyć się niezauważone, mimo iż pojedyncze posty zostaną oznaczone jako dezinformacja.

Walka z dezinformacją wymaga zatem szerszego podejścia, które łączy analizę kontentu z monitorowaniem powiązań między kontami, przepływu informacji oraz identyfikacją źródeł i intencji nadawców. Tylko takie kompleksowe podejście pozwala skutecznie przeciwdziałać dezinformacji i minimalizować jej wpływ na społeczeństwo.

Oczywiście by móc prowadzić kompleksowe działania potrzebne są kompetencje, posiadanie odpowiedniego oprogramowania, a także dostęp do danych, bez których raporty końcowe nie będą miały merytorycznej wartości.

Analizy wyłącznie kontentu są wręcz niebezpieczne gdyż opierają się na stereotypach, iż wszystko jest "pro rosyjską narracją". Tymczasem wojna w sieci jest dużo bardziej skomplikowana i wymaga dokładnych analiz by wyciągać odpowiednie wnioski a także móc odpowiednio reagować.

Mam nadzieję, iż teraz już będzie nam wszystkim łatwiej odpowiedzieć na pytanie:

Dlaczego analiza kontentu nie jest skuteczną metodą w walce z dezinformacją?