W sieci pojawiło się wiele nagłówków sugerujących, iż stosowanie – bądź co bądź – zbytecznych uprzejmości w konwersacjach z aplikacją ChatGPT generowało potężne straty. Czy aby na pewno kurtuazja w rozmowie z chatbotem kosztuje OpenAI miliony dolarów? Tak zasugerował sam dyrektor generalny firmy Sam Altman.

Czy przesadna uprzejmość względem ChatGPT faktycznie stanowi palący problem?

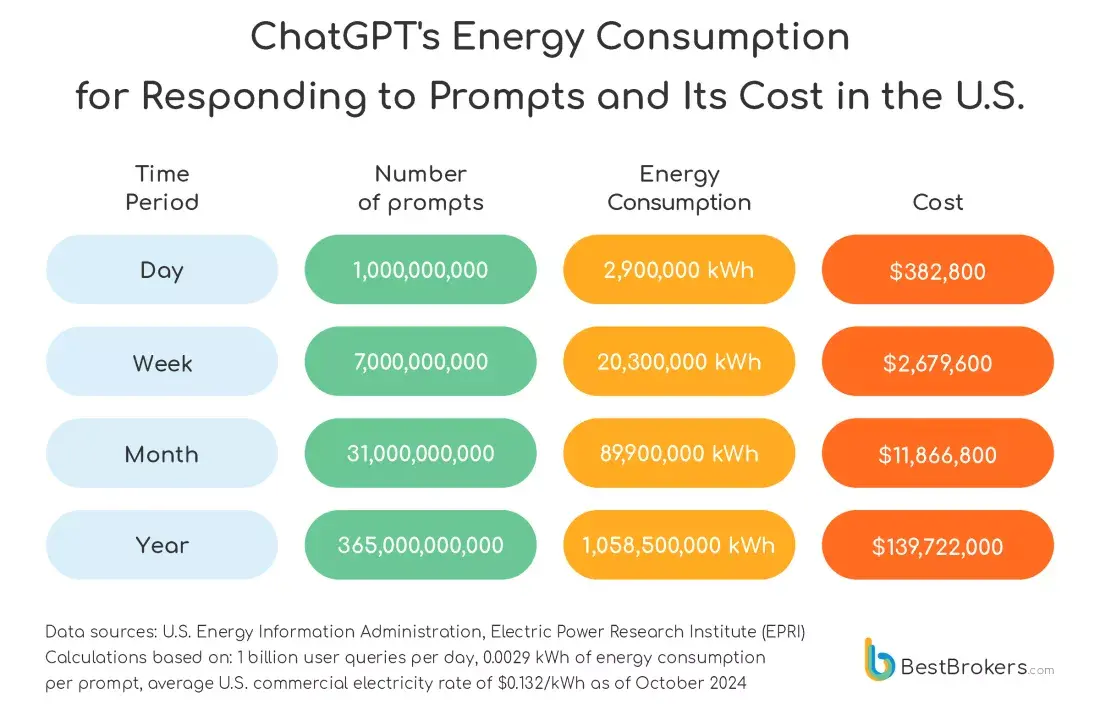

Coraz częściej mówi się o gigantycznym zużyciu energii, do jakiego prowadzi rozwój szeroko pojmowanej sztucznej inteligencji, na czele z prawdopodobnie najpopularniejszym rozwiązaniem w postaci ChatGPT. 365 miliardów odpowiedzi udzielanych przez to narzędzie według danych U.S. Energy Information Administration ma przekładać się na zużycie 1 058 500 000 kWh energii, kosztującej w Stanach Zjednoczonych 139 722 000 dolarów. Robi wrażenie, prawda? Wielu internautów zastanawia się, jaką część tego zapotrzebowania energetycznego generują zbędne uprzejmości pod adresem aplikacji rozwijanej przez OpenAI.

Źródło: BestBrokers.com

Źródło: BestBrokers.comInternauta @tomieinlove za pośrednictwem platformy X zadał pytanie o to, ile OpenAI wydaje na energię potrzebną na udzielanie odpowiedzi na prompty w stylu „proszę” i „dziękuję”, kierowane w stronę ChatGPT. Dyrektor generalny OpenAI Sam Altman stwierdził luźno, iż „dziesiątki milionów dolarów”, dodając: „nigdy nie wiadomo”. Dziennikarze skupili się zwłaszcza na pierwszej części jego wypowiedzi, zupełnie pomijając oficjalne dane dotyczące całościowego zapotrzebowania ChatGPT na energię.

Prawda mniej sensacyjna, niż sugerują nagłówki

Prawda wcale nie leży „gdzieś pośrodku”. Nie jest możliwym, aby prompty grzecznościowe stanowiły tak potężną część wszystkich kierowanych do narzędzia zapytań. Przytoczone wyżej dane wydają się temu przeczyć, podobnie zresztą jak wcześniejsze informacje publikowane przez OpenAI. Koszt odpowiedzi udzielanych przez model GPT-3.5 Turbo to 0,002 dolara za 1000 odpowiedzi, a koszt „wejściowych” zapytań to 0,0015 dolara za każdy 1000. Podobno zwroty takie jak „proszę” i „dziękuję” to zwykle 2-4 na każde 1000 „tokenów”. To jednak dane estymowane.

Pozostawiam tę kalkulację czytelnikom.

Łatwo i gwałtownie można obliczyć, iż „straty” OpenAI wynikające z uprzejmości pod adresem ChatGPT idą *raczej* w setki tysięcy dolarów niż w miliony, choć i tego finalnie nie da się wykluczyć. I tak, przez cały czas są to spore i bezsensownie zmarnowane pieniądze. Do tego prawdopodobnie nawiązywał Altman, mówiąc „nigdy nie wiadomo”. Nie da się tego precyzyjnie określić, ale to przez cały czas pieniądze wyrzucone w błoto, niezależnie od tego, jak duże.

Źródło: X, Best Brokers