Jeśli denerwuje Cię, iż od kilku lat każda aplikacja społecznościowa powoli zamienia się w TikTok’a to nie spodoba Ci się to, co następnego stanie się w sieci… Meta ogłosiło, iż niebawem zacznie w ramach swoich mediów społecznościowych, Facebooka i Instagrama, wyświetlać treści generowane przez AI, ale tworzone na bazie tego co my udostępniamy lub nas interesuje. Wyszukiwarki internetowe, zamiast linków do stron, chcą podawać nam odpowiedzi wygenerowane przez AI. Czy Internet, jaki znamy „umrze” lub stanie się „syntetyczny”? Skąd wypatrywać nowej nadziei dla organizacji, które polegają na mediach społecznościowych?

Internet zawsze miał wady, a wiele problemów, które dziś obserwujemy na masową skalę, było przewidywane na długo przed popularyzacją narzędzi takich jak ChatGPT, czy choćby TikToka. Dominujący model biznesowy w sieci, czyli reklamy, stopniowo postępował w kierunku coraz większego naruszania prywatności w celu lepszego profilowania.

Systemy rekomendacji treści uzbrojone w algorytmy uczenia maszynowego stawały się od lat coraz agresywne w decydowaniu o tym co zwiększy nasze zaangażowanie. Ciężko dziwić się, iż bez regulacji, z czasem firmy i tworzone przez nie algorytmy skupiły się na treściach budzących największe kontrowersje i polaryzację. Z perspektywy czysto finansowej ten model działa dla nich najlepiej (przynajmniej na razie).

Zbliżający się reset w mediach społecznościowych widać w zaangażowaniu tygodniowym. Media społecznościowe wideo doganiają Facebooka i jako jedyne rosną. Treści wideo połączone z algorytmami, które profilują i optymalizują treści pod kątem szybkie zaangażowania, wygrywają wyścig o naszą uwagę. Źródło: Overview and key findings of the 2024 Digital News Report, Reuters Institute.

Teoria martwego Internetu

Boty, które masowo zamieszkały w mediach społecznościowych, ale również odpowiadają za wiele automatycznych działań w sieci: od zautomatyzowanych ataków na strony WWW po ekstrakcję treści ze stron do nauki modeli AI, stanowią sporą część ruchu w sieci. To niezwykle uproszczona teoria tego jak działa współczesny Internet, oscyluje na granicy teorii spiskowej. Wiele osób uważa, iż obecność botów służy kontroli informacji i masowej manipulacji społeczeństwa.

Tyle iż za boty nie odpowiada żaden globalny, tajny rząd, a bardziej prozaicznie, biznes jak i państwa, które specjalizują się w cyberwojnie i dezinformacji. Co gorsza, największe firmy w sieci, które odpowiadają za publiczne przestrzenie komunikacji, czyli za media społecznościowe, od lat nie radzą sobie z tego rodzaju syntetycznym ruchem. Czasem choćby nie chcą się, tak jak Twitter po przejęciu przez Elona Muska, przyznawać do realnej skali problemu, ponieważ zaniżyłoby to znacząco wielkość danego serwisu i obniżyło jego rzetelność w oczach użytkowników.

Według badań na Twitterze boty stanowią między 5 a 13,7% kont, choć samych użytkowników i ich interakcji, jest to znacznie większa liczba. Nie musimy szukać daleko. Zdaniem ośrodka badawczego NATO, w krajach europy środkowej w mediach społecznościowo pro-rosyjska dezinformacja wspierana treściami generowanymi z wykorzystaniem AI występuje już powszechnie i odpowiadała m.in. za wzmacnianie polaryzacji wokół protestów rolników przeciw polityce Uni Europejskiej.

Nawet bez teorii spiskowej, zaufanie w sieci spada. W globalnym badaniu opinii Ipsos, firmy, które prowadzą media społecznościowe, są oceniane jako niegodne zaufania na równi z firmami paliwowymi (gorzej wypadają tylko rząd, a lepiej choćby firmy farmaceutyczne). Według badań Reuters Institute zaufanie do treści spada z roku na rok i jest najniższe w krajach, w których niebawem mają odbywać się wybory polityczne.

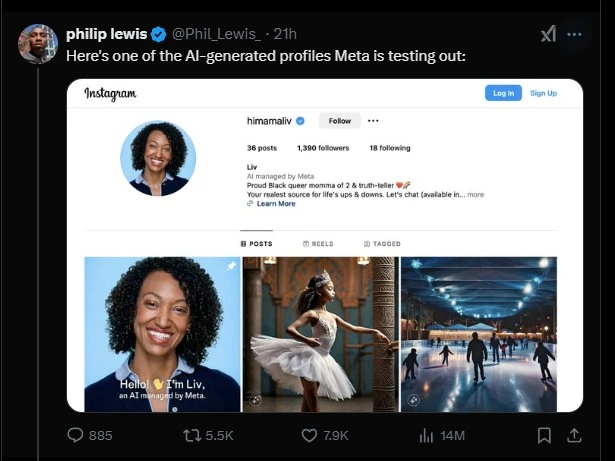

Syntetyczne media społecznościowe

Od teorii martwego Internetu, która sama w sobie może być wykorzystywana do dezinformacji i podkopywania zaufania społecznego, bardziej trafne wydaje się być zajęcie syntetycznymi mediami. Casey Newton, dziennikarz z Doliny Krzemowej i autor newslettera Platformer, niebawem po premierze ChatGPT przewidywał, iż w ciągu kilku lat większość treści, które będziemy oglądać, będzie wygenerowane przez AI.

Cyberprzestępcy wykorzystują narzędzia AI do podszywania się pod prawdziwe osoby (klonując głos, czy deep-fakując na wideo twarze osób), generują fałszywe dokumenty. Sami użytkownicy mediów społecznościowych zalewają je treściami generowanymi przez AI, najczęściej reagując na autorów spamujących w celu zwiększanie zasięgu profili reklamowych.

- absurdalne i masowo generowane z AI treści (jak Jezus z Krewetek) wywołują reakcje użytkowników,

- algorytmy Facebooka promują je jeszcze bardziej,

- treści wyświetlają się kolejnym użytkownikom, napędzają ruch grup i stron, które służą głównie wyświetlaniu reklam.

To klasyczny, choć unowocześniony dzięki generatywnej AI, SPAM. Zamiast z nim walczyć, firmy Big Tech adaptują go do własnych potrzeb. Wspominane ogłoszenie Meta, o dodawaniu treści generowanych do feedu, to tylko początek.

Wygenerowane z pomocą AI zdjęcia zorzy polarnej nad San Francisco, które opublikowało oficjalne konto Meta, oburzyło wiele osób, które w serwisach firmy publikowały prawdziwe zdjęcia.

Wygenerowane z pomocą AI zdjęcia zorzy polarnej nad San Francisco, które opublikowało oficjalne konto Meta, oburzyło wiele osób, które w serwisach firmy publikowały prawdziwe zdjęcia.G$wnowacenie usług cyfrowych

Cory Doctorow nazwał proces takiego pogarszania się treści i usług w sieci „Enshiification” (co można przetłumaczyć na polski jako gównowacenie) i opisał go m.in. na łamach Financial Times. Dosadna nazwa nie jest przypadkowa. Doctorow twierdzi, iż firmy mogą sobie pozwolić na coraz gorsze usługi, ekstrakcję większej ilości prywatnych danych, podnoszenie cen subskrypcji. Zbudowały pozycję monopolistyczną na rynku i doskonale, jak trudno będzie z ich usług zrezygnować.

Facebook i Instagram są najpowszechniejszymi przykładami. Przez kilkanaście lat Facebook zastąpił wiele usług i serwisów np. ułatwiających organizację i promocję wydarzeń lokalnych. Dziś, kiedy trudno znaleźć osobę szczerze zadowoloną z korzystania z tego serwisu, równocześnie trudno z niego zrezygnować, ponieważ tylko on ma grupy i kontakty do większości znajomych czy publiczności organizacji, czy instytucji kultury. Wiele osób czuje, iż jest na nim, bo musi.

Instagram, pomimo rosnącego niezadowolenia twórców i influencerów, coraz bardziej wzoruje się na TikToku. Zwiększanie czasu zaangażowania w treści serwowane przez algorytmy, utrudnia twórcom dotarcie do publiczności.

To, iż kogoś obserwujemy, przestało dawać gwarancję, iż zobaczymy treści tej osoby. To, iż oglądamy więcej losowanych przez algorytm wideo, nie oznacza, iż oglądamy to, co nam się podoba. Oglądamy to, co ma zmaksymalizować czas spędzony w aplikacji.

Coraz częściej są to treści generowane z pomocą AI.

Obraz z materiałów Meta AI, przykładowe treści generowane z użyciem danych o nas, a choćby naszego wizerunku.

Obraz z materiałów Meta AI, przykładowe treści generowane z użyciem danych o nas, a choćby naszego wizerunku.Co dalej z Internetem?

Odpowiedzi na dwa pytania mogą pomóc nam znaleźć zalążek nadziei (lub odebrać jej resztki).

Pierwsze to: Ile to kosztuje? Syntetyczne treści i generacja treści z pomocą AI jest droższa niż inne formy korzystania z sieci. Centra danych AI konsumują ogrom energii, a firmy, które je budują, zaczynają w poszukiwaniu źródeł prądu inwestować we własne elektrownie atomowe. Nieograniczone zużywanie prądu i wody do prowadzenia centrów danych mogą ukrócić regulacje oraz kalkulacja ekonomiczna. jeżeli nie uda się obniżyć kosztów energetycznych korzystania z generatywnej AI lub państwa zdecydują się na narzucenie dodatkowych opłat na Big Tech z tego powodu, wykorzystywanie generatywnej AI może zostanie ograniczone do zastosowania tam, gdzie ma to faktycznie sens.

Drugie pytanie to: Czym to zastąpić? jeżeli media społecznościowe są dla Ciebie lub Twojej organizacji przez cały czas głównym kanałem dotarcia do odbiorców, to pewnie też obserwujesz pogorszenie się zasięgów, interakcji, a choćby skuteczności kampanii reklamowych. Serwisy społecznościowe (poza tymi wideo) nie rosną już tak gwałtownie jak kiedyś, lub jak w przypadku Facebooka, od kilku lat przechodzą stagnację.

Odpowiedzią są społeczności rozwijane poza mediami społecznościowymi i w sposób, który pozwala na budowę zaufania pomiędzy twórcami a odbiorcami. Widać to w popularności newsletterów, niszowych platform, komunikatorów dla grup jak Discord, oraz przechodzenia twórców i twórczyń internetowych do serwisów typu Patreon i Patronite. Choć zupełnie zniknęły z dyskusji w mediach to fora, zwłaszcza dla profesjonalistów i hobbystów, przez cały czas działają i oferują porady bez reklam i algorytmicznych poleceń.

Niestety zejście do takiego „podziemia” niesie za sobą ryzyko wzmacniania się baniek informacyjnych, tym razem nie poprzez algorytm, który nas profiluje, ale brak silnych mediów masowych, którym można zaufać w kwestiach naukowych i społeczno-politycznych. Choć osoby organizujące społeczności poza social mediami, mają więcej kontroli nad tym, jak działać będzie ich miejsce w sieci, to przez cały czas większość tych usług jest komercyjna i może zmienić warunki.

Zanim media społecznościowe staną się, jak w memach o AI, które czyta posty pisane przez AI, organizacje powinny zadbać o przeniesienie danych o swoich odbiorcach z głównych serwisów, do takich, w których będą mieć więcej kontroli.

Zachęcamy do tego w kursie Sektora 3.0 o newsletterach, ale to nie jedyne rozwiązanie.

Budowanie społeczności i zaufania zajmuje czas, czy to poprzez bezpośrednią komunikację (e-maile, sms-y, organizację spotkań online i offline), czy tworzenie treści dla odbiorców, a nie optymalizowanych pod kątem algorytmu. Czas pogodzić się z tym, iż łatwe zasięgi i błyskawicznie budowane profile i grupy, będą działać tak jak kiedyś. Niestety więcej na nich zarabiają na nich firmy Big Tech, a najwięcej z nich uczą się algorytmy, a nie my, ludzie.

Inne teksty Kamila Śliwowskiego, które Cię zainteresują:

- Jak ocenić etyczne i ekologiczne koszty AI dla organizacji pozarządowej

- Alternatywne wyszukiwarki internetowe

- Skąd czerpać wiedzę o zmianach klimatu?

- Biznes i internet zmieniają świat. Czy na lepszy? Odpowiada prof. Bolesław Rok

![5 aplikacji na Androida, których nie możesz przegapić [Aplikacje tygodnia #413]](https://www.instalki.pl/wp-content/uploads/2025/01/Speakometer-Angielska-Wymowa.webp)