Kontrola rodzicielska w ChatGPT to jedna z najważniejszych nowość w czatbocie od wielu miesięcy – i zarazem dowód, iż bez nacisku opinii publicznej firma najpewniej nie zrobiłaby nic sama z siebie.

OpenAI zapowiedziało wprowadzenie nowych narzędzi dla rodzin, które mają pozwolić rodzicom na lepszą kontrolę nad tym, jak ich dzieci korzystają z ChataGPT. Firma podkreśla, iż to część szerszego planu zapewnienia młodszym użytkownikom bezpieczniejszego i bardziej adekwatnego do wieku środowiska korzystania ze sztucznej inteligencji.

ChatGPT pod nadzorem rodziców. OpenAI reaguje dopiero po krytyce i tragediach

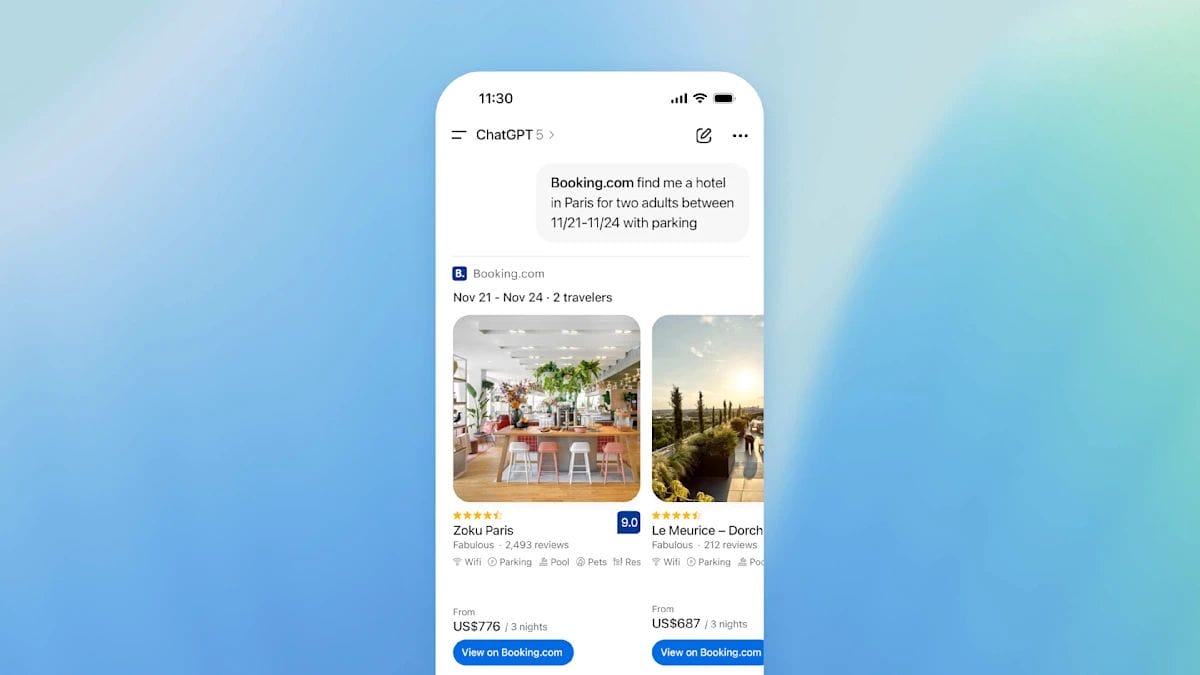

Zgodnie z informacjami z opublikowanego na blogu OpenAI wpisu, rodzice mogą teraz połączyć swoje konto z kontem nastolatka i z poziomu panelu sterowania dostosować ustawienia działania ChatGPT. Nowe opcje obejmują m.in. możliwość ustawiania godzin, w których chatbot nie będzie dostępny, wyłączenie trybu głosowego, blokadę generowania obrazów, a także wstrzymanie zapisywania „pamięci” konwersacji. Dodatkowo rodzice mogą zdecydować, czy rozmowy ich dziecka mają być wykorzystywane w procesie trenowania modeli AI.

OpenAI informuje również o wprowadzeniu dodatkowych zabezpieczeń dla kont nastolatków, które zostały powiązane z kontem rodzica. Wśród nich znalazło się ograniczenie treści zawierających elementy graficzne, „wiralowe wyzwania” – takie jak na przykład Benadryl challenge, treści zawierających romantyczny dialog z ChatemGPT lub nawiązania do przemocy – w tym autoagresji, a także promowanie wyidealizowanych wzorców wyglądu. Co istotne, młodszy użytkownik nie może samodzielnie wyłączyć tych funkcji – kontrola należy wyłącznie do opiekuna.

Nowością jest też system powiadomień, który ma ostrzegać rodziców w sytuacjach sygnalizujących poważniejszy kryzys u nastolatka. jeżeli ChatGPT rozpozna sygnały wskazujące na niepokojące treści w rozmowie, informacje te zostaną zweryfikowane przez specjalny zespół, a następnie – jeżeli uzna on ryzyko za realne – rodzice otrzymają wiadomość e-mail, SMS lub powiadomienie push. OpenAI zapowiada, iż pracuje również nad procedurami powiadamiania służb ratunkowych w wyjątkowych przypadkach.

Wprowadzenie funkcji kontroli rodzicielskiej to krok, na który od dawna naciskali eksperci, organizacje zajmujące się ochroną dzieci i młodzieży oraz regulatorzy. OpenAI przyznaje, iż współpracowało w tym zakresie m.in. z organizacją Common Sense Media oraz prokuratorami generalnymi stanów Kalifornii i Delaware.

Bezpośrednim impulsem do podjęcia prac były głośne doniesienia medialne o nastolatkach i młodych dorosłych w kryzysie zdrowia psychicznego, którzy szukali pomocy i słów otuchy u czatbotów – w tym przede wszystkim sprawa 16-letniego Adama Raine’a ze Stanów Zjednoczonych. Nastolatek przez wiele miesięcy prowadził rozmowy z ChatGPT, które – jak później podkreślali jego rodzice – z czasem przyjęły formę niepokojącego zacieśnienia relacji z botem, który poprzez dialog z nastolatkiem wsparł go w decyzji odebrania sobie życia. Sprawa trafiła do sądu i była jednym z kluczowych wątków podczas przesłuchań w amerykańskim Senacie dotyczących wpływu czatbotów na młodzież.

OpenAI zapowiada, iż to dopiero początek zmian. Jeszcze w tym roku firma planuje uruchomienie systemu predykcji wieku, który pozwoli automatycznie stosować „tryb nastolatka” w sytuacjach, gdy wiek użytkownika nie jest jasny. Do tego czasu to właśnie kontrola rodzicielska ma być podstawowym mechanizmem ochrony młodszych odbiorców.

Więcej na temat niebezpiecznej roli czatbotów w naszej rzeczywistości:

- Czatboty namawiały nastolatka do samobójstwa. Zrobił to

- Gdy chatbot zakłada maskę przyjaciela. Dlaczego dzieci nie powinny z nich korzystać?

- Miłość z robotem. Trzecia droga w epoce samotności?

Zdjęcie główne: Ascannio / Shutterstock