„Od nowego semestru na lekcjach polskiego będziecie analizować teksty piosenek Julii Żugaj” – mówi Donald Tusk w tiktoku udostępnionym przez użytkownika Blogerzyna (@fejkowi), który zdobył już ponad 200 tysięcy wyświetleń. Czy w polskim szkolnictwie rzeczywiście szykują się zmiany? Zobaczcie razem z nami, jaki efekt mogą wywołać nagrania stworzone przez sztuczną inteligencję.

„Donald Tusk nigdy tego nie powiedział”

W opisie filmu autor jasno zaznaczył, iż jego treść została wygenerowana dzięki sztucznej inteligencji – w rzeczywistości Donald Tusk nigdy nie powiedział nic na temat popularnej influencerki i piosenkarki Julii Żugaj. Pytanie tylko, czy wszystkie osoby komentujące wideo zapoznały się z tym podpisem.

Różnorodność reakcji odbiorców bardzo dobrze pokazuje, jak świetnie sztucznie wygenerowane materiały mogą imitować rzeczywistość i wpływać na nasze poglądy.

Uważaj na deepfake

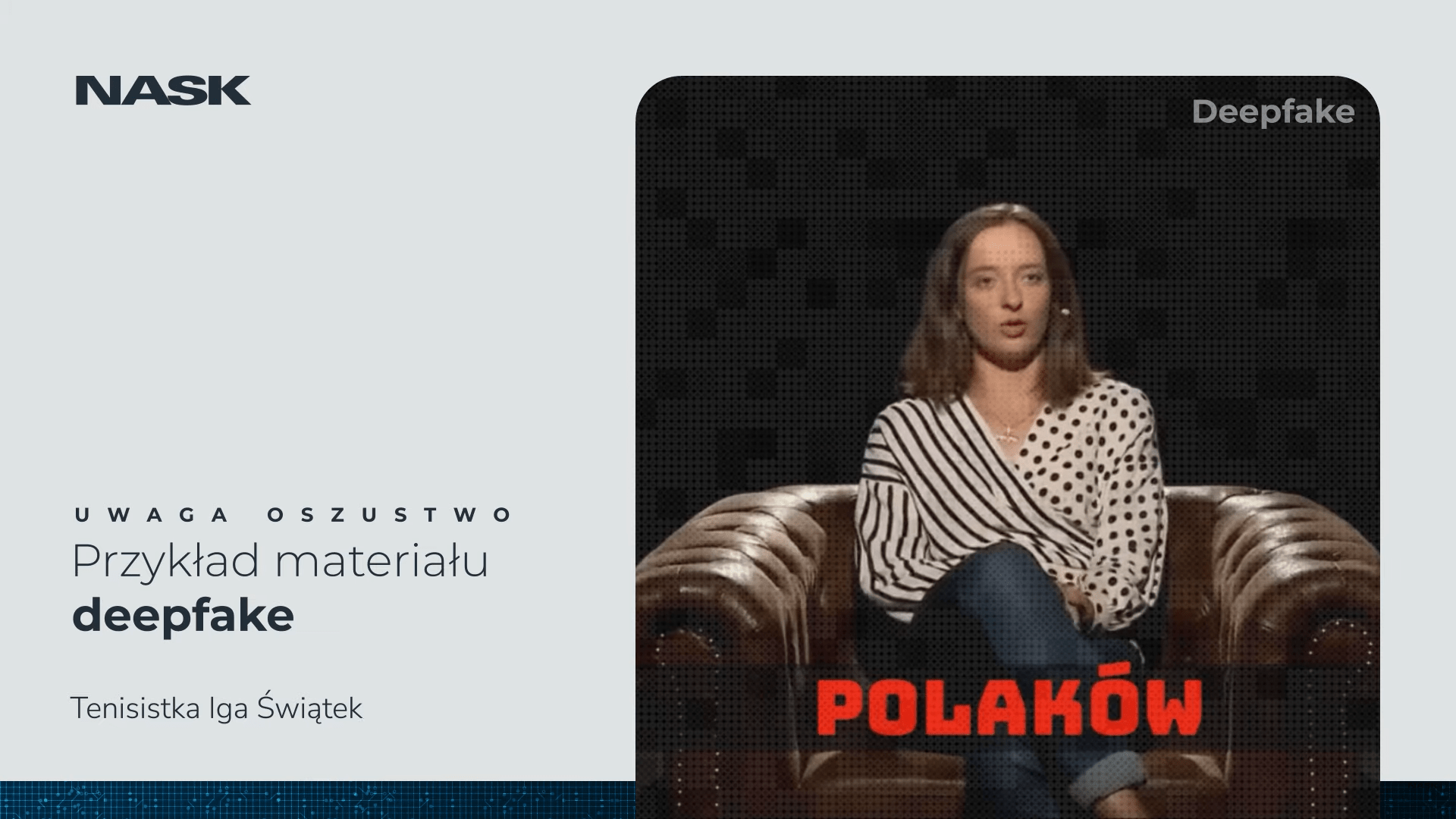

Deepfake to stosunkowo nowe zjawisko, które jednak zdążyło już zostać szczegółowo wyjaśnione w biuletynie Akademickiego Centrum Komunikacji Strategicznej, który tutaj sparafrazujemy. Sam termin „deepfake” pochodzi od internetowego pseudonimu twórcy fałszywego nagrania przedstawiającego aktorkę Gal Gadot w scenach rodem z filmów dla dorosłych. To dzięki najnowszym technologiom z dziedziny nauczania maszynowego użytkownik Reddita mógł zmanipulować materiały wizualne i dźwiękowe do tego stopnia, iż jego odbiorcom trudno było odróżnić prawdę od fikcji – przynajmniej na pierwszy rzut oka. Czy oznacza to jednak, iż powoli zbliżamy się do „infoapokalipsy”? .

Ogólnodostępność programów do tworzenia filmów, zdjęć czy muzyki sprawiła, iż AI zaczęło cieszyć się popularnością wśród szerokiego grona odbiorców. Niestety, bywają też wykorzystywane przez osoby, których intencje nie są wcale niewinne. Spreparowane wypowiedzi polityków czy osób popularnych w sferze publicznej mogą nieść za sobą poważne skutki dla demokracji i mediów. Technologia ta może być również używana do krzywdzenia jednostek przez tworzenie kompromitujących materiałów, które mogą skutecznie zniszczyć reputację.

Jak rozpoznać fałszywe nagranie?

Rozpoznanie deepfake’ów z czasem może robić się coraz trudniejsze ze względu na pojawianie się coraz to bardziej zaawansowanych metod ich tworzenia. Natomiast w dalszym ciągu istnieją pewne szczegóły, które mogą pozwolić zwykłym użytkownikom Internetu na wykrycie deepfake’a. Mowa tu na przykład o nienaturalnym wyglądzie sylwetki lub ubrań, nadprogramowych palcach, czy dziwnym sposobie mówienia.

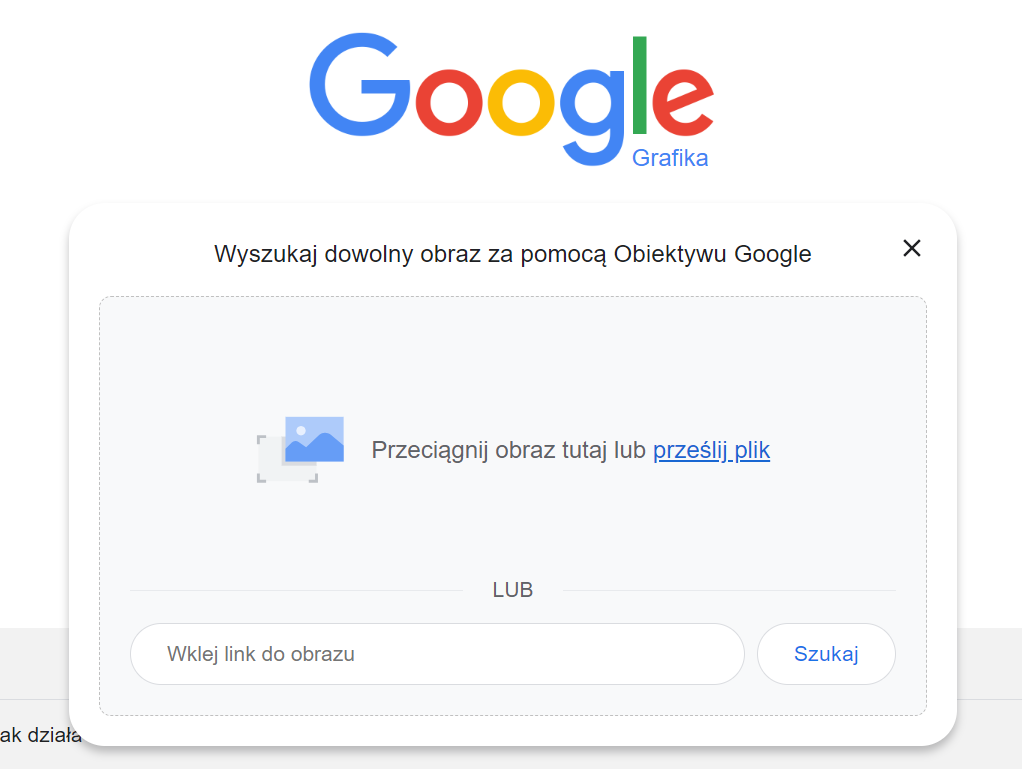

Dostrzeżenie detali, które zdradzają, iż materiał jest fałszywy, może być dla niektórych dość trudnym zadaniem – i to szczególnie wtedy, gdy nagranie lub zdjęcie jest wysokiej jakości. W takim przypadku można skorzystać z funkcji wstecznego wyszukiwania obrazem lub specjalnych wtyczek w przeglądarce internetowej. Najprostszym sposobem będzie użycie Obiektywu Google, który pomaga znaleźć źródło podejrzanego zdjęcia lub ocenić prawdziwość screenów z nagrania.

Wyniki wstecznego wyszukiwania obrazem będą widoczne po prawej stronie. Pomogą one w określeniu źródła obrazu:

Brace yourself

Materiał twórcy odpowiedzialnego za nagranie z Donaldem Tuskiem ma na celu podłączenie się pod trend z TikToka i rozbawienie odbiorcy. Nie wiadomo jednak, ile osób faktycznie uwierzyło w jego prawdziwość, dlatego jest to doskonały przykład pokazujący, jak ważne jest zwracanie uwagi na szczegóły. W dobie gwałtownego rozwoju technologicznego oraz politycznego niepokoju należy być świadomym zagrożenia wynikającego z fałszywych nagrań z udziałem polityków. Dlatego też warto postarać się wyrobić w sobie nawyk krytycznego spoglądania na wszelkiego rodzaju medialne doniesienia o charakterze sensacyjnym. I chociaż omawiany w tym artykule filmik miał charakter humorystyczny, nie zapominajmy, iż technologia AI tworzy też treści, które mogą wpływać na nasze decyzje w tak ważnych momentach, jak zbliżające się wybory europejskie.