W dzisiejszym odcinku Dekoder, spróbujemy znaleźć „cyfrowego boga”. Pomyślałem, iż robiliśmy to już wystarczająco długo, więc zajmijmy się tym. Czy możemy zbudować sztuczną inteligencję tak potężną, iż zmieni świat i odpowie na wszystkie nasze pytania? Branża sztucznej inteligencji zdecydowała, iż odpowiedź brzmi „tak”.

We wrześniu Sam Altman z OpenAI opublikował wpis na blogu twierdząc, iż będziemy mieli superinteligentną sztuczną inteligencję za „kilka tysięcy dni”. Na początku tego miesiąca Dario Amodei, dyrektor generalny Anthropic, konkurenta OpenAI, opublikował post zawierający 14 000 słów określając, do czego dokładnie, jego zdaniem, będzie zdolny taki system, kiedy już pojawi się, co jego zdaniem może nastąpić już w 2026 r.

Fascynujące jest to, iż wizje przedstawione w obu postach są tak podobne — obie obiecują radykalną superinteligentną sztuczną inteligencję, która przyniesie ogromne ulepszenia w pracy, nauce i opiece zdrowotnej, a choćby demokracji i dobrobytu. Cyfrowy Bóg, kochanie.

Ale choć wizje są podobne, firmy pod wieloma względami otwarcie się sprzeciwiają: Anthropic to oryginalna historia dezercji OpenAI. Dario i grupa innych badaczy opuścili OpenAI w 2021 r. po tym, jak zaniepokoili się jego coraz bardziej komercyjnym kierunkiem i podejściem do bezpieczeństwa, i stworzyli Anthropic, aby być bezpieczniejszą i wolniejszą firmą zajmującą się sztuczną inteligencją. Do niedawna nacisk kładziono naprawdę na bezpieczeństwo; właśnie w zeszłym roku, a główny New York Timesa profil firmy nazwał je „rozpalonym do białości centrum zagłady sztucznej inteligencji”.

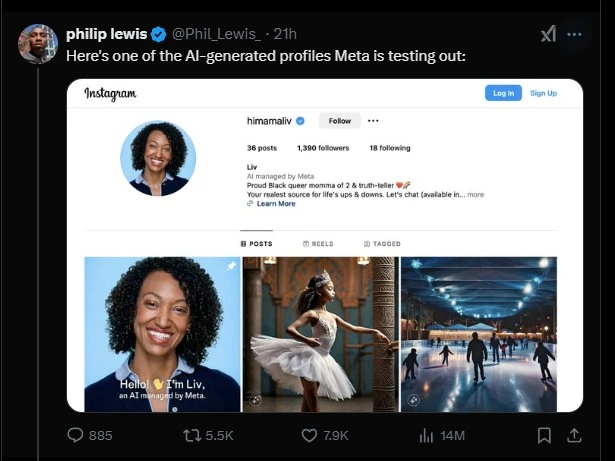

Jednak uruchomienie ChatGPT i następujący po nim boom generatywnej sztucznej inteligencji zapoczątkowały kolosalny wyścig zbrojeń technologicznych, a teraz Anthropic jest tak samo obecny w grze jak każdy inny. Pozyskano miliardowe fundusze, głównie od Amazona, i zbudowano Claude, chatbota i model językowy, który może konkurować z GPT-4 OpenAI. Teraz Dario pisze długie posty na blogu o szerzeniu demokracji dzięki sztucznej inteligencji.

Więc co tu się dzieje? Dlaczego szef Anthropic nagle tak optymistycznie mówi o sztucznej inteligencji, skoro wcześniej był znany z tego, iż jest bezpieczniejszą i wolniejszą alternatywą dla postępu za wszelką cenę OpenAI? Czy to po prostu kolejny szum wokół sztucznej inteligencji, skierowany do inwestorów? A jeżeli AGI naprawdę jest już blisko, jak w ogóle mierzymy, co to znaczy, iż jest bezpieczne?

Aby to wszystko przełamać, uruchomiłem Skraj starszą reporterkę ds. sztucznej inteligencji, Kylie Robison, aby omówić, co to oznacza, co dzieje się w branży i czy możemy ufać liderom AI, iż powiedzą nam, co naprawdę myślą.

Jeśli chcesz przeczytać więcej na temat niektórych wiadomości i tematów omawianych w tym odcinku, kliknij poniższe linki:

- Maszyny kochającej łaski | Dariusz Amodei

- Wiek inteligencji | Sama Altmana

- Dyrektor generalny Anthropic uważa, iż sztuczna inteligencja doprowadzi do utopii | Krawędź

- Manifesty AI zalewają strefę technologiczną | Osie

- OpenAI właśnie zebrało 6,6 miliarda dolarów na budowę coraz większych modeli sztucznej inteligencji | Krawędź

- OpenAI było laboratorium badawczym — teraz jest po prostu kolejną firmą technologiczną | Krawędź

- Najnowsza aktualizacja sztucznej inteligencji Anthropic może samodzielnie korzystać z komputera | Krawędź

- Agenci to przyszłość, którą obiecują firmy zajmujące się sztuczną inteligencją — i której desperacko potrzebują | Krawędź

- Gubernator Kalifornii zawetował główną ustawę o bezpieczeństwie AI | Krawędź

- Wewnątrz rozgrzanego do białości centrum zagłady AI | NYT

- Bliska kooperacja Microsoftu i OpenAI wykazuje oznaki rozpadu | NYT

- Pytanie warte 14 miliardów dolarów dzielące OpenAI i Microsoft | WSJ

- Anthropic w rozmowach o finansowaniu przedstawił wycenę na 40 miliardów dolarów | Informacje

Dekoder z Nilayem Patelem /

Podcast od The Verge o wielkich pomysłach i innych problemach.

![5 aplikacji na Androida, których nie możesz przegapić [Aplikacje tygodnia #413]](https://www.instalki.pl/wp-content/uploads/2025/01/Speakometer-Angielska-Wymowa.webp)